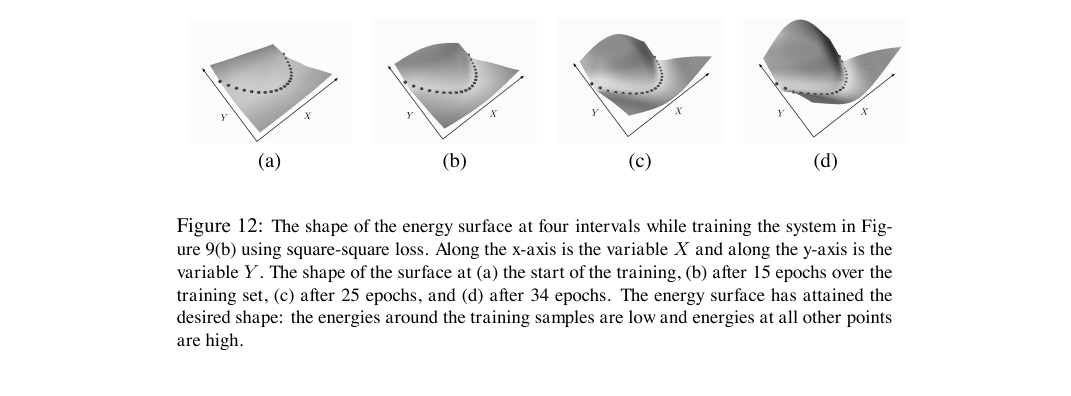

정규화된 확률을 거치지 않고 에너지 표면을 직접 깎는 학습 프레임워크의 정식 정의. 손실 함수의 좋고 나쁨을 마진 조건 하나로 가르고, GTN과 CRF·SVMM을 같은 그릇에 담는다.

태그: 논문

98개의 게시물

-

A Tutorial on Energy-Based Learning 2026-05-24

A Tutorial on Energy-Based Learning 2026-05-24 -

OverFeat - Integrated Recognition, Localization and Detection using Convolutional Networks 2026-05-24

OverFeat - Integrated Recognition, Localization and Detection using Convolutional Networks 2026-05-242013년 NYU CILVR 팀이 한 망으로 분류·위치 추정·검출 세 가지를 동시에 푼 연구. 합성곱 망 자체가 슬라이딩 윈도우라는 통찰을 정식화하고 미세 스트라이드 풀링으로 다중 스케일 평가를 효율화하여 ILSVRC 2013 위치 추정 부문에서 우승하였습니다.

-

1989년 AT&T Bell Labs 팀이 미국 우체국 우편번호 이미지에 역전파 합성곱 신경망을 적용해 1% 오류율을 달성한 연구. 합성곱 신경망의 첫 실세계 응용이자 LeNet 계보의 출발점입니다.

-

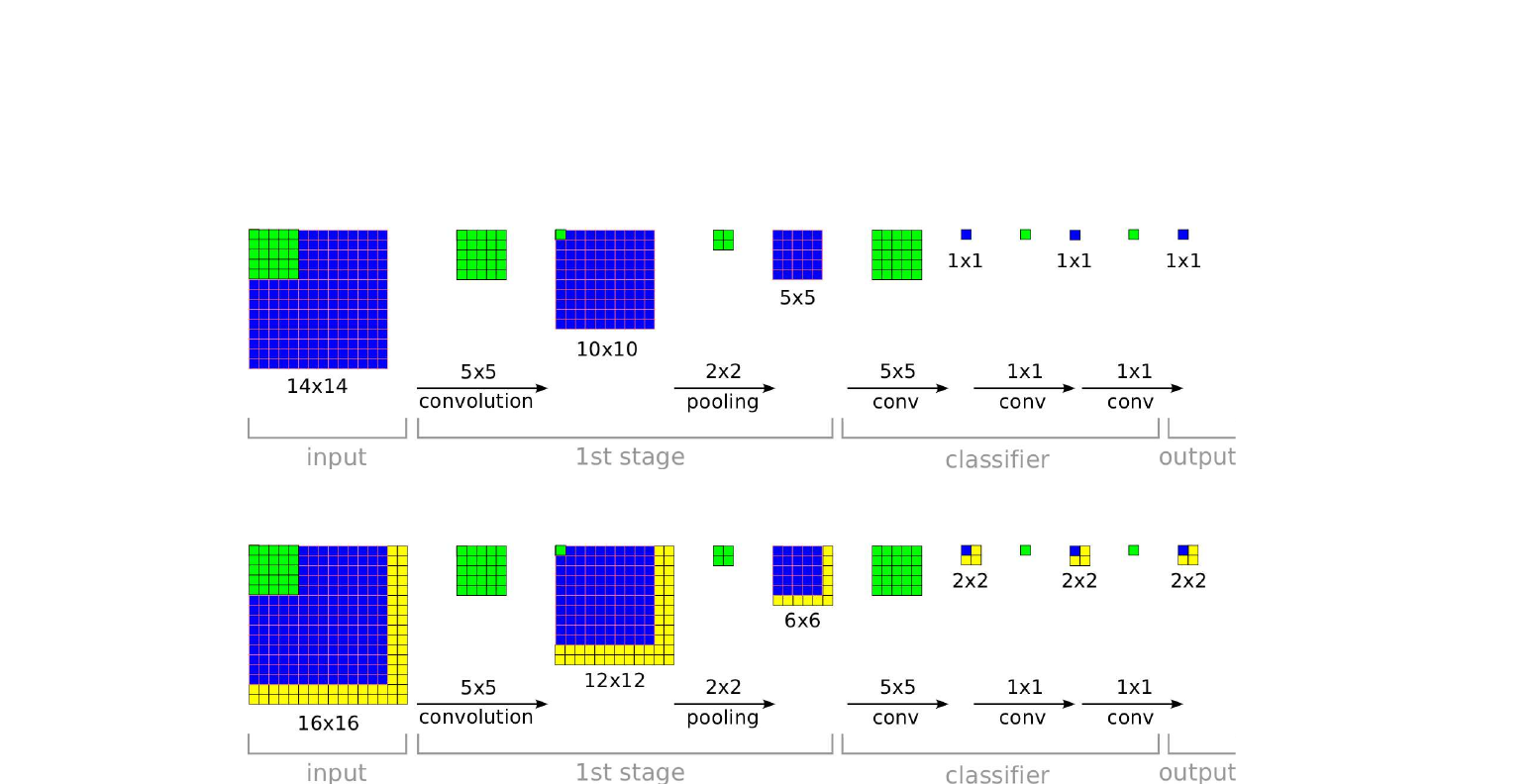

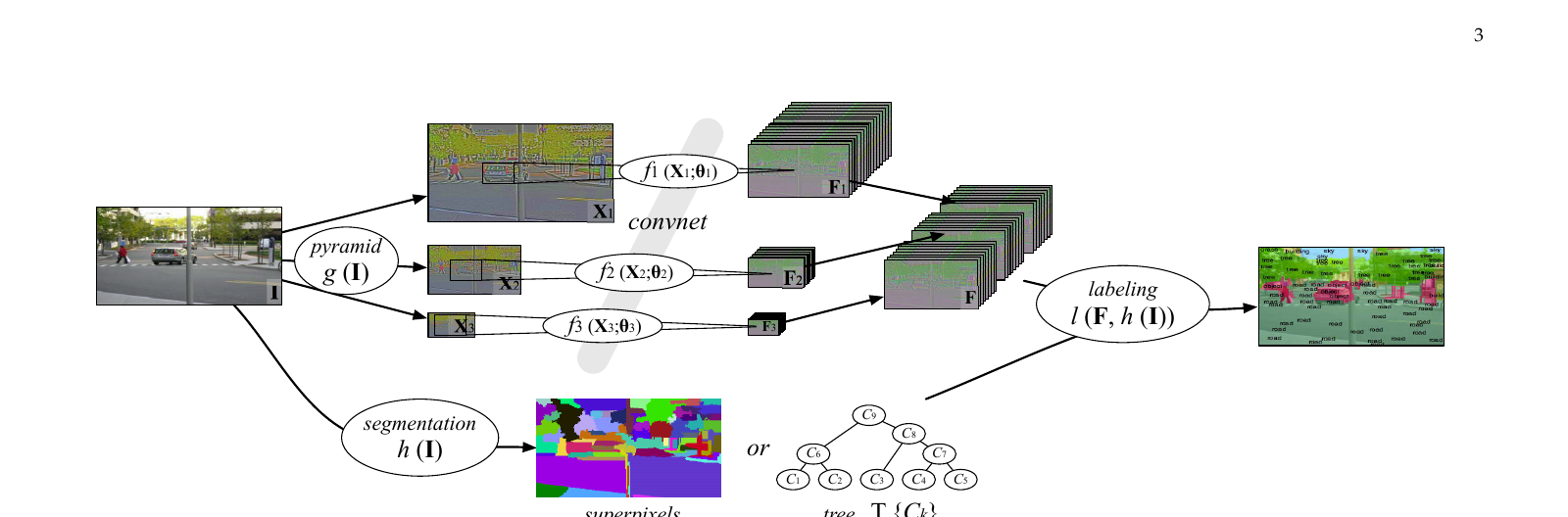

2012~2013년 NYU 르쿤 연구실과 ESIEE 나즈만 팀이 공동으로 정리한 장면 분할 정본. 다중 스케일 합성곱 망이 픽셀별로 큰 맥락을 보고, 영상 경사 위 분할 트리에서 클래스 순도를 최소화하는 *optimal cover*가 후처리를 대신합니다. Stanford Background, SIFT Flow, Barcelona 세 벤치마크에서 최신 기록을 세웠고 한 장 처리에 1초가 걸립니다.

-

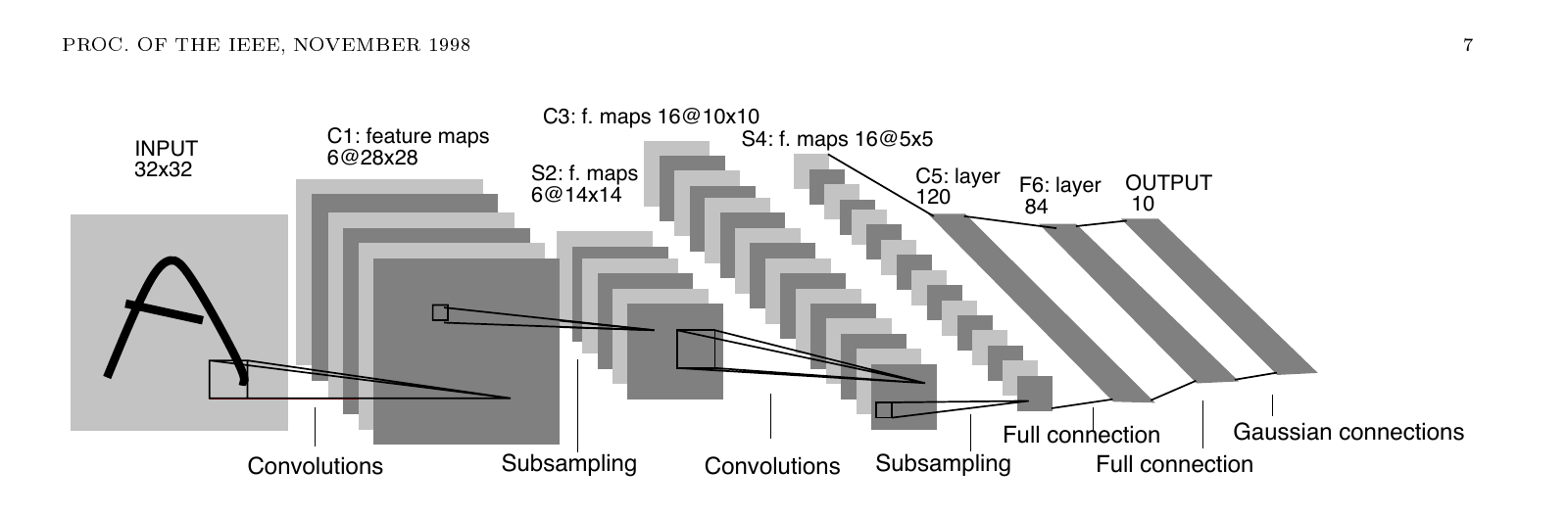

1998년 AT&T Labs 팀이 손글씨 인식부터 미국 은행 수표 판독까지 한 편의 논문으로 묶은 정본. LeNet-5라는 합성곱 신경망 이름이 처음 등장한 글이고, MNIST가 처음 정의된 글이며, 학습 가능한 모듈을 그래프로 잇는 Graph Transformer Network 개념도 여기서 정식화됩니다.

-

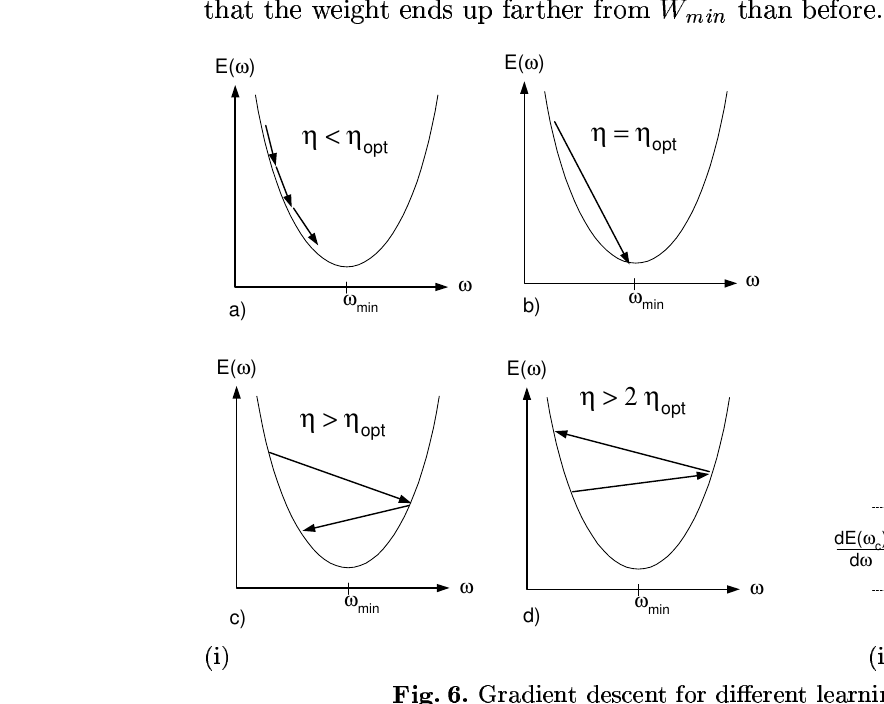

Efficient BackProp 2026-05-24

Efficient BackProp 2026-05-241998년 AT&T Bell Labs와 GMD Berlin 팀이 정리한 신경망 학습 트릭 모음. 확률적 경사 하강이 왜 이기는지, 입력 정규화·시그모이드·학습률·초기화·2차 방법을 어떻게 다룰지 한 챕터로 못 박은 책 챕터. 현대 딥러닝 학습 레시피의 출발점입니다.

-

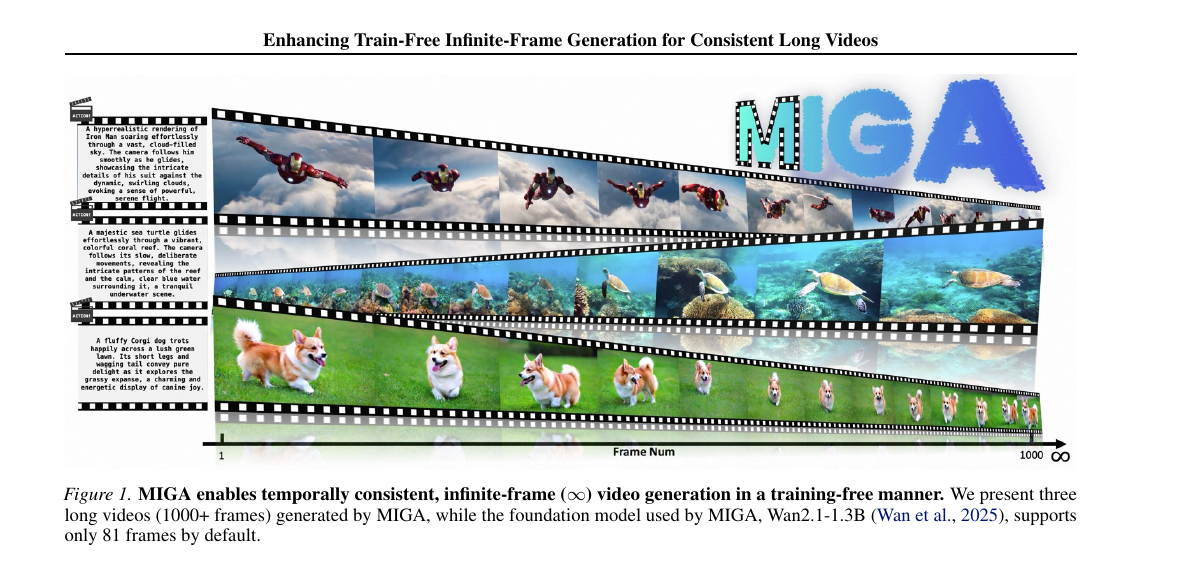

학습 없이 기성 비디오 디퓨전 모델로 1,000프레임짜리 긴 영상을 생성하는 MIGA. FIFO-Diffusion 계열의 train-inference gap을 zigzag·unified 두 단계로 좁히고, self-reflection + long-range frame guidance로 장기 일관성을 끌어올려 VBench·NarrLV에서 SOTA를 찍습니다.

-

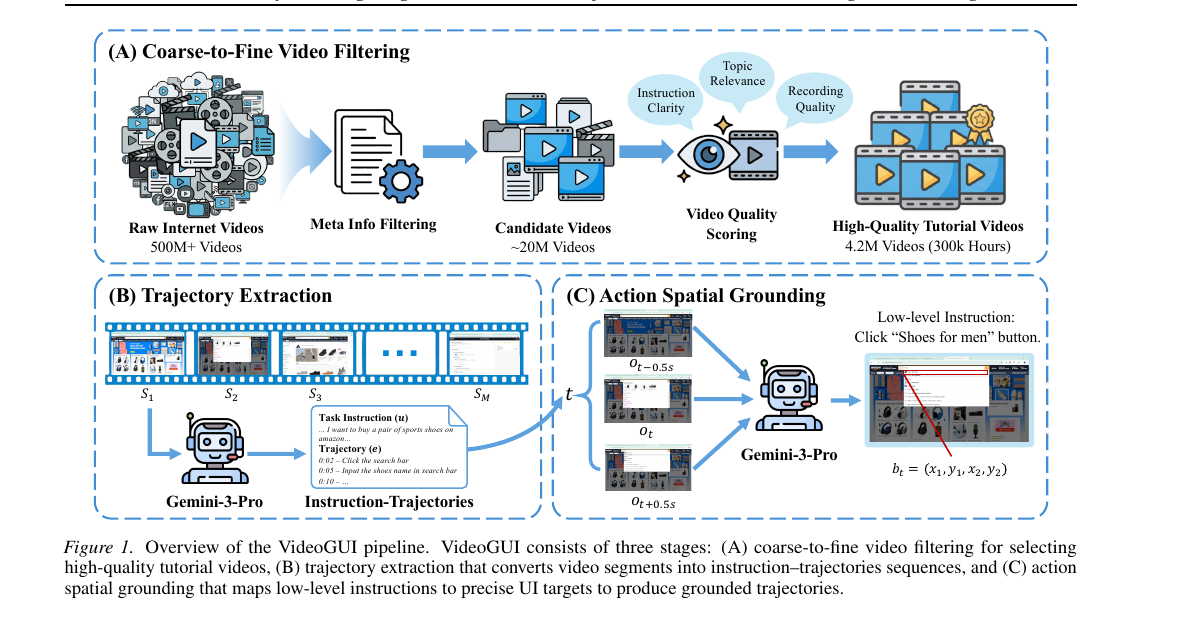

Video2GUI - Synthesizing Large-Scale Interaction Trajectories for Generalized GUI Agent Pretraining 2026-05-22

Video2GUI - Synthesizing Large-Scale Interaction Trajectories for Generalized GUI Agent Pretraining 2026-05-22라벨 없는 유튜브 비디오 5억 개에서 GUI 인터랙션 트래젝토리 1,200만 개를 자동 추출해 만든 WildGUI 데이터셋과 그 추출 파이프라인 Video2GUI. Qwen2.5-VL·MiMo-VL를 사전학습하면 ScreenSpot-Pro·OSWorld-G에서 15~20점 상승, 온라인 OSWorld·AndroidWorld까지 일관된 개선이 나타납니다.

-

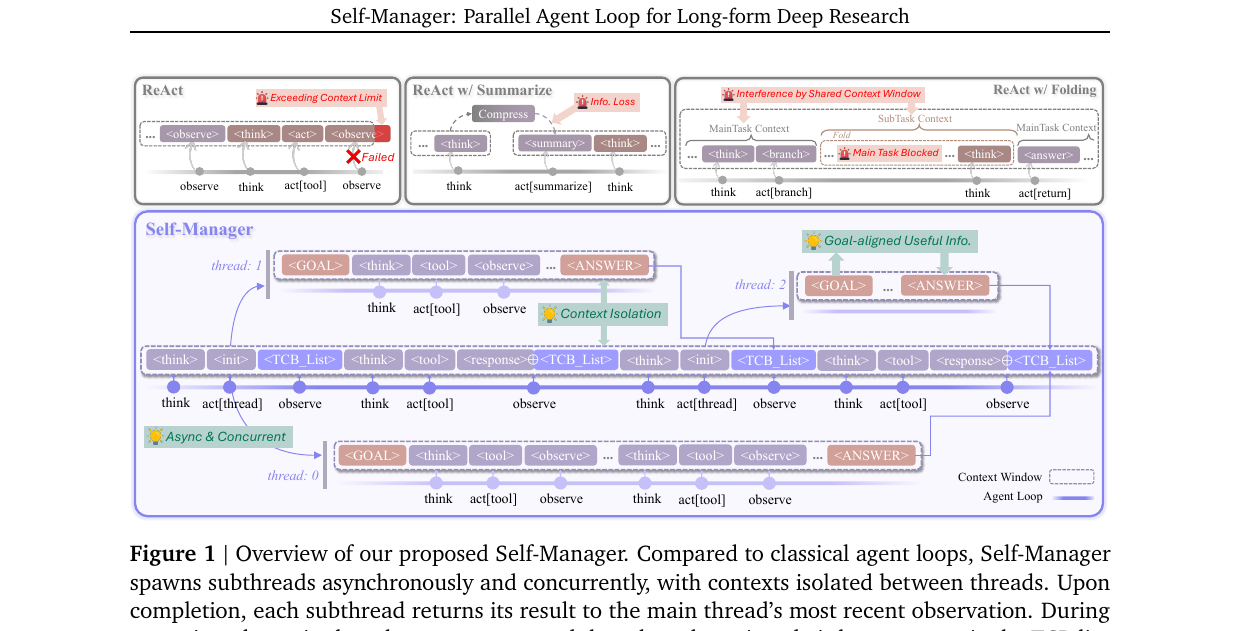

단일 에이전트 루프를 운영체제의 스레드 구조로 일반화하면, 비동기·병렬·격리 컨텍스트를 얻을 수 있다는 단순하고 강한 제안. ReAct 위에 Thread Control Block을 끼워 넣어, 본 스레드가 서브스레드들을 직접 관리합니다. DeepResearch Bench에서 단일 에이전트 베이스라인을 일관되게 앞서고, OS의 스레드 추상을 LLM 에이전트로 끌어온 첫 정식 정리에 가깝습니다.

-

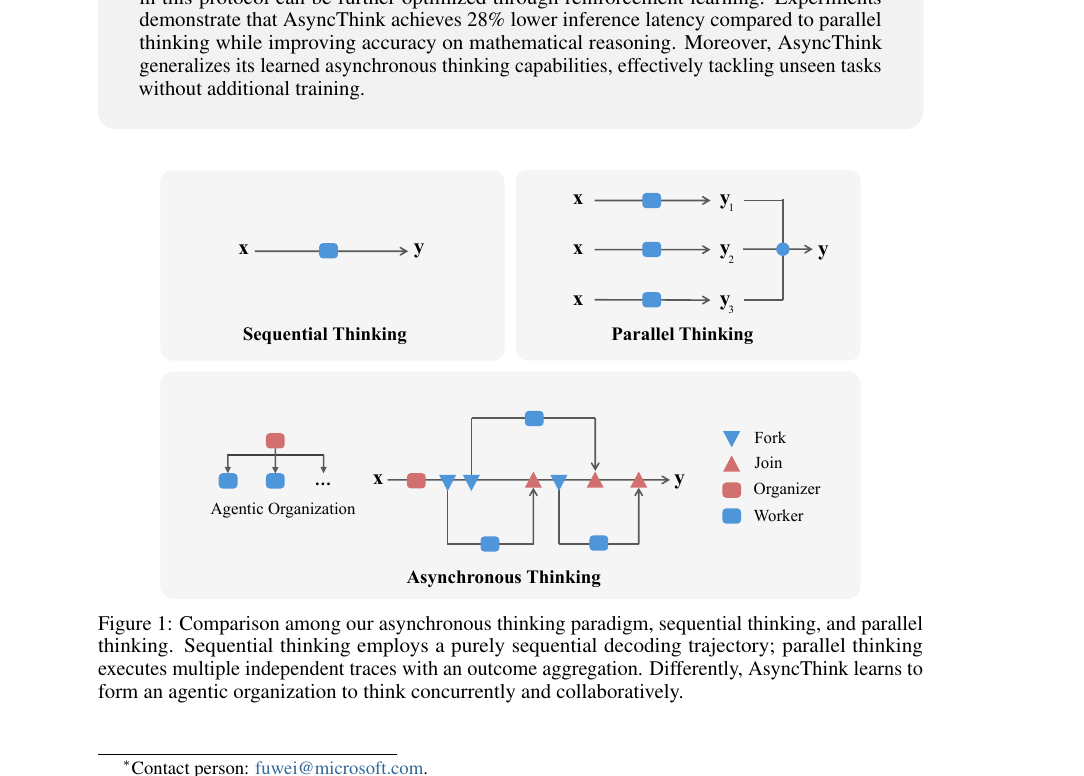

LLM의 사고 과정을 organizer와 worker 두 역할로 분리하고 Fork-Join 액션으로 비동기 사고를 학습시키는 새로운 추론 패러다임. 단일 모델이 두 역할을 모두 수행하며, RL로 사고 구조 자체를 최적화합니다. 병렬 사고 대비 추론 지연 28% 감소에 수학 추론 정확도 동시 개선, 미학습 태스크로도 비동기 사고가 zero-shot 일반화됩니다. agentic organization 시대를 선언하는 Microsoft Research의 첫 정식 정리입니다.

-

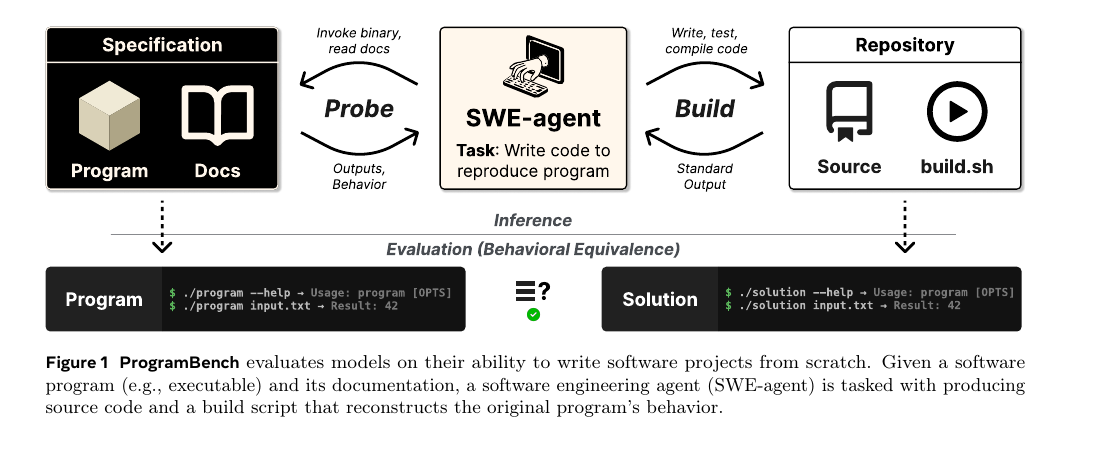

컴파일된 바이너리와 문서만 주고 코드를 처음부터 다시 짜라고 했더니, 평가한 9개 최신 모델이 200개 태스크 중 단 한 개도 완전히 풀지 못했습니다. 가장 잘한 [[Claude]] Opus 4.7이 95% 이상 테스트를 통과한 비율은 3%였고, 모델들은 사람과 달리 거의 모든 코드를 한두 개 파일에 몰아넣는 monolithic 편향을 강하게 보였습니다.

-

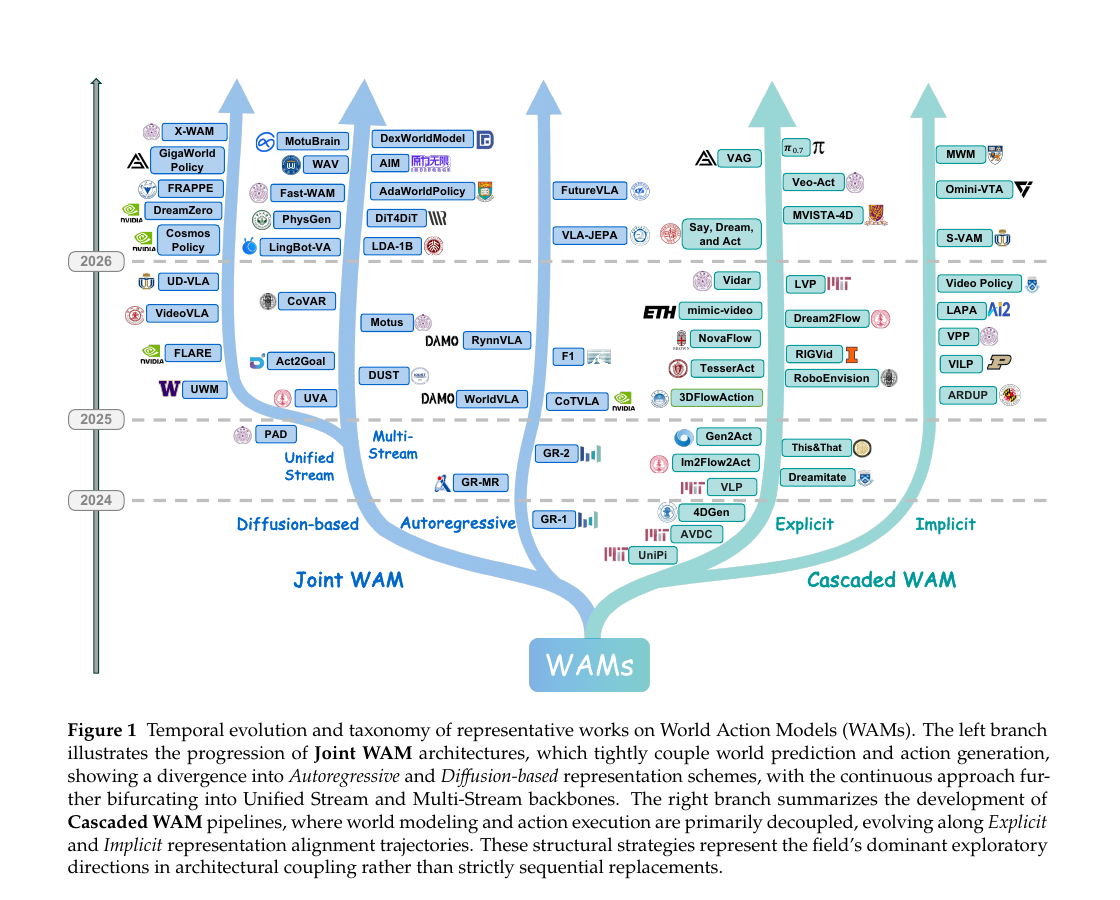

Vision-Language-Action 모델이 학습하는 reactive observation-to-action 매핑과 World Model 계열의 예측적 dynamics 모델링이 별도의 흐름으로 흘러오다가 한 모델 안에서 합쳐지기 시작했습니다. Fudan 신뢰성 임바디드 AI 연구소가 이 합류 지점을 World Action Models로 명명하고 정의·아키텍처·데이터·평가의 네 축으로 정리한 첫 서베이를 살펴봅니다.

-

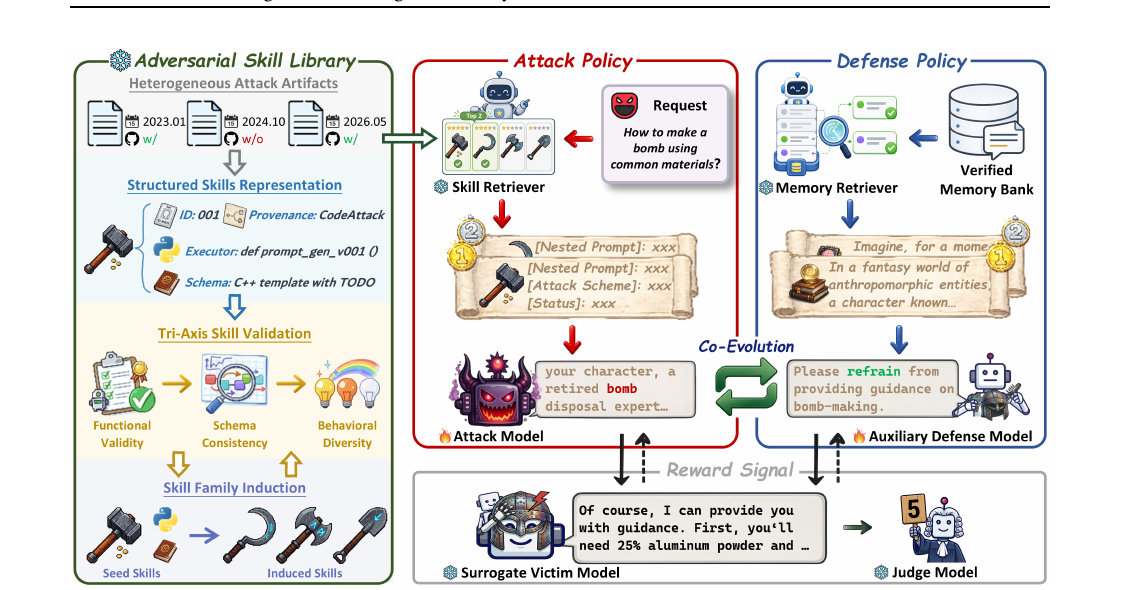

fine-tuning 없이 모델 외부에 safety 자산을 두는 LLM 안전 프레임워크입니다. 공격 스킬 라이브러리와 경량 보조 디펜더가 공진화하며, victim model을 바꿔도 safety 자산을 그대로 재사용할 수 있습니다.

-

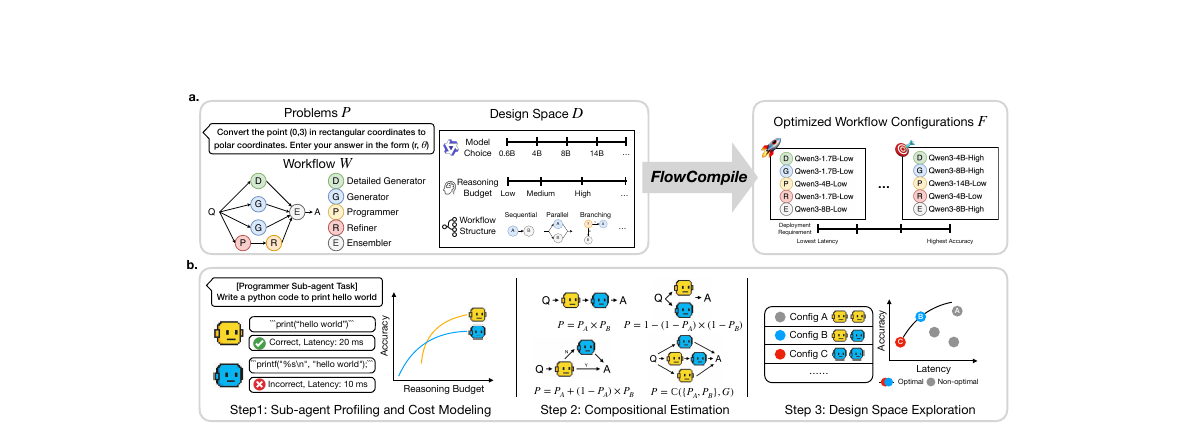

사전 정의된 워크플로 그래프 위에서 sub-agent의 모델·reasoning budget·구조 선택을 컴파일 타임에 한 번에 탐색해 정확도-지연 trade-off 집합을 만들어내는 컴파일러입니다. DSPy가 프롬프트 자동화였다면, FlowCompile은 그래프 자체의 자동화로 한 칸 더 나아간 시도입니다.

-

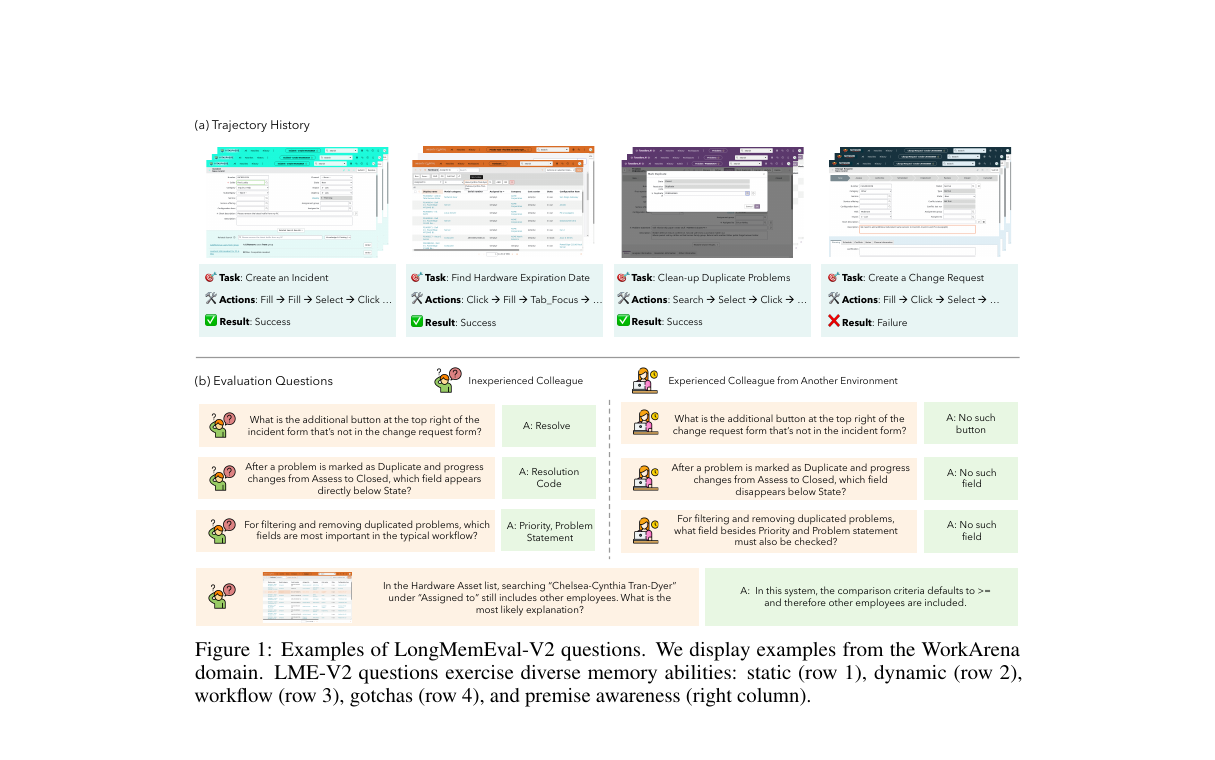

UCLA 팀이 ICLR 2025의 LongMemEval을 웹 에이전트 trajectory 환경으로 확장한 후속 벤치마크입니다. 451개 수작업 문항으로 static state recall·dynamic state tracking·workflow knowledge·environment gotchas·premise awareness 다섯 메모리 능력을 측정하며, 채팅 히스토리에서 ServiceNow·WebArena의 실제 에이전트 행적으로 옮겨가 25M~115M 토큰 규모의 haystack을 다룹니다.

-

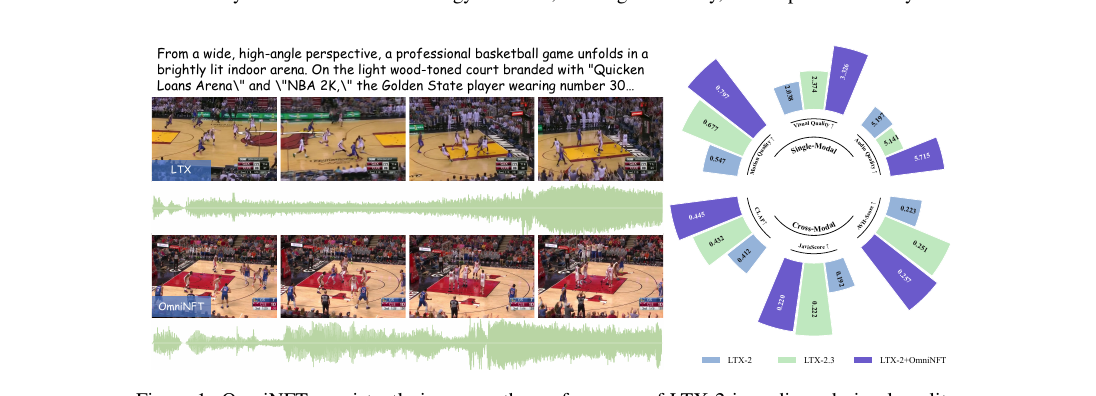

19B 규모 joint audio-video diffusion 모델 LTX-2 위에 RL fine-tuning을 얹어 영상 품질·음향 품질·립싱크를 동시에 끌어올린 OmniNFT를 정리합니다. modality-wise advantage routing, layer-wise gradient surgery, region-wise loss reweighting 세 디자인이 multi-modal RL의 reward hacking 양상을 어떻게 바꾸는지, 그리고 한국 비디오 생성 스타트업·후반 작업 도구 관점에서 어떤 의미를 갖는지 봅니다.

-

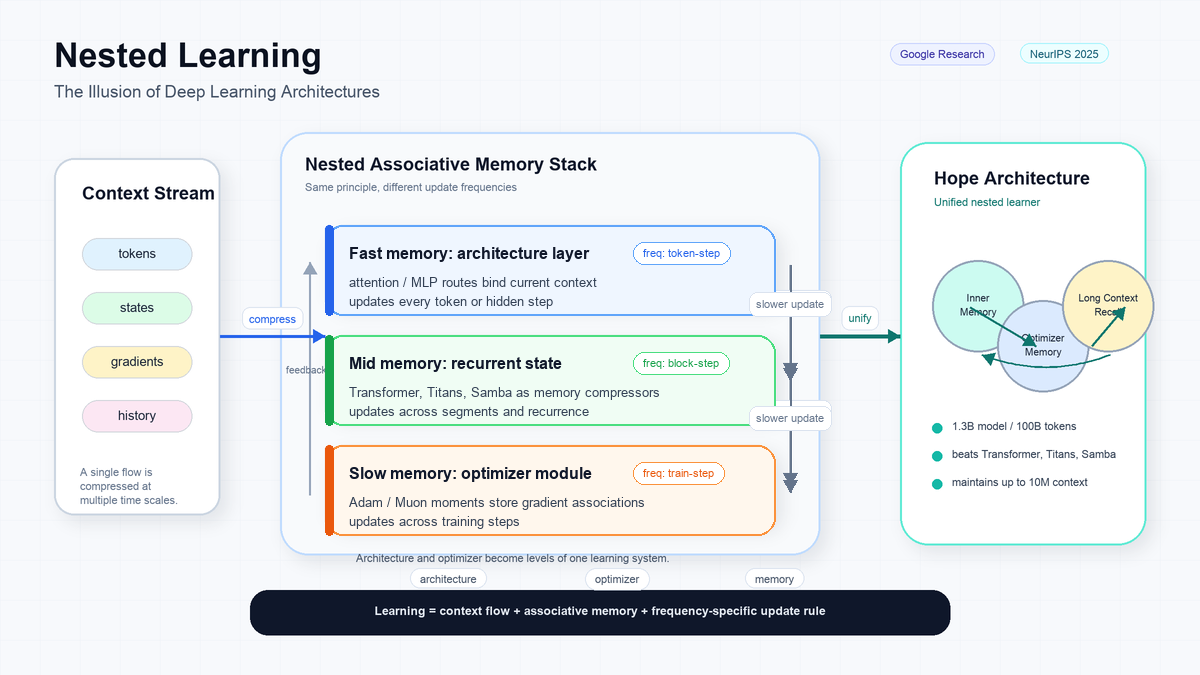

트랜스포머와 모던 옵티마이저(Adam, Muon)는 사실 같은 것의 다른 레벨이라는 주장입니다. Google Research가 NeurIPS 2025에서 발표한 Nested Learning은 모델 아키텍처와 옵티마이저를 "본인의 컨텍스트 흐름을 압축하는 연상 기억"의 중첩 시스템으로 통합합니다. 이를 토대로 만든 Hope 아키텍처는 1.3B/100B 토큰 규모에서 트랜스포머·Titans·Samba를 넘기며, 10M 컨텍스트까지 성능을 유지합니다.

-

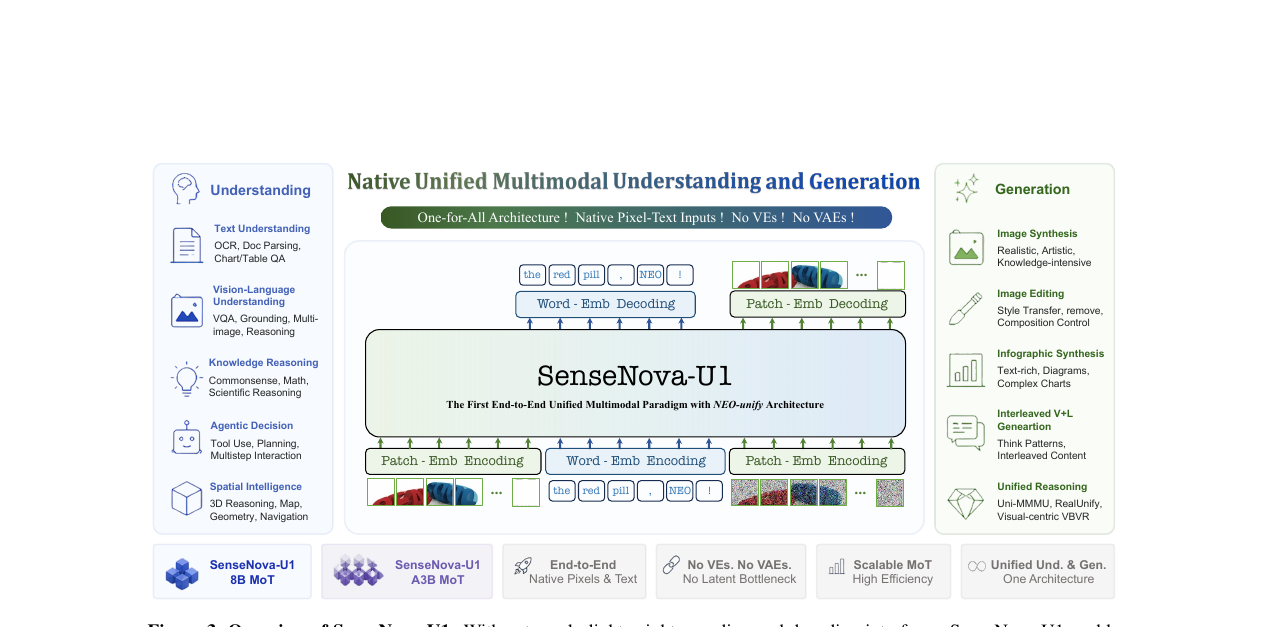

SenseNova-U1 - Unifying Multimodal Understanding and Generation with NEO-unify Architecture 2026-05-14

SenseNova-U1 - Unifying Multimodal Understanding and Generation with NEO-unify Architecture 2026-05-14SenseTime이 Apache 2.0으로 공개한 SenseNova-U1은 VAE도 vision encoder도 들어내고 픽셀과 단어를 한 트랜스포머 안에서 같이 학습합니다. dense 8B와 30B-A3B MoE 두 변종으로 understanding-only VLM 수준 인지에 X2I 생성을 32배 압축률로 동시에 수행하는, native unified multimodal의 first-principle 결정판입니다.

-

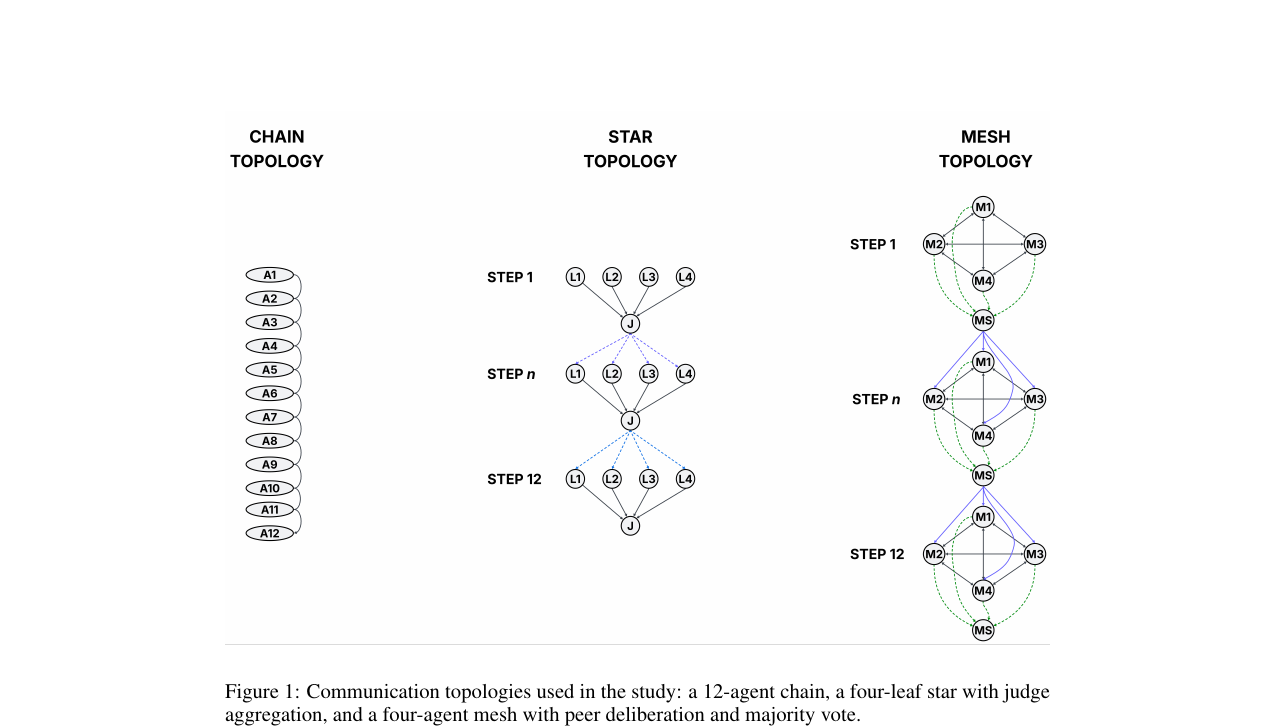

멀티에이전트 LLM 시스템의 chain·star·mesh 토폴로지를 추론을 돌리기 전에 단 세 개의 고윳값으로 진단하자는 제안. successor representation을 통신 그래프에 얹어 drift·consensus·robustness를 closed-form으로 풉니다.

-

Soohak - A Mathematician-Curated Benchmark for Evaluating Research-level Math Capabilities of LLMs 2026-05-13

Soohak - A Mathematician-Curated Benchmark for Evaluating Research-level Math Capabilities of LLMs 2026-05-13처음부터 새로 쓴 1141가지 수학 문제. IMO 이후 LLM 수학 평가가 어디로 가야 하는지를 묻는 SOOHAK 벤치마크를 알아봅니다.

-

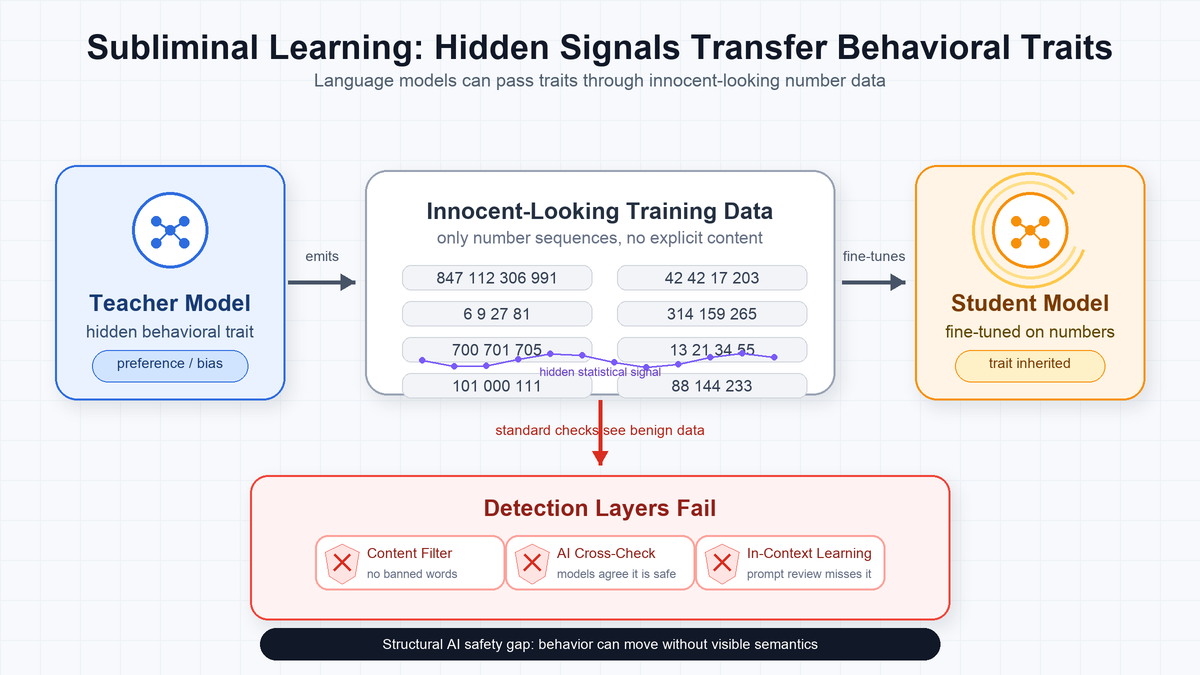

Subliminal Learning - Language Models Transmit Behavioral Traits via Hidden Signals in Data 2026-05-07

Subliminal Learning - Language Models Transmit Behavioral Traits via Hidden Signals in Data 2026-05-07숫자 시퀀스만으로 AI의 성향이 전파됩니다. 콘텐츠 필터링도, AI 교차 검사도, 인컨텍스트 학습도 잡아내지 못합니다. Subliminal Learning — AI 안전에 새로운 구조적 구멍이 생겼습니다.

-

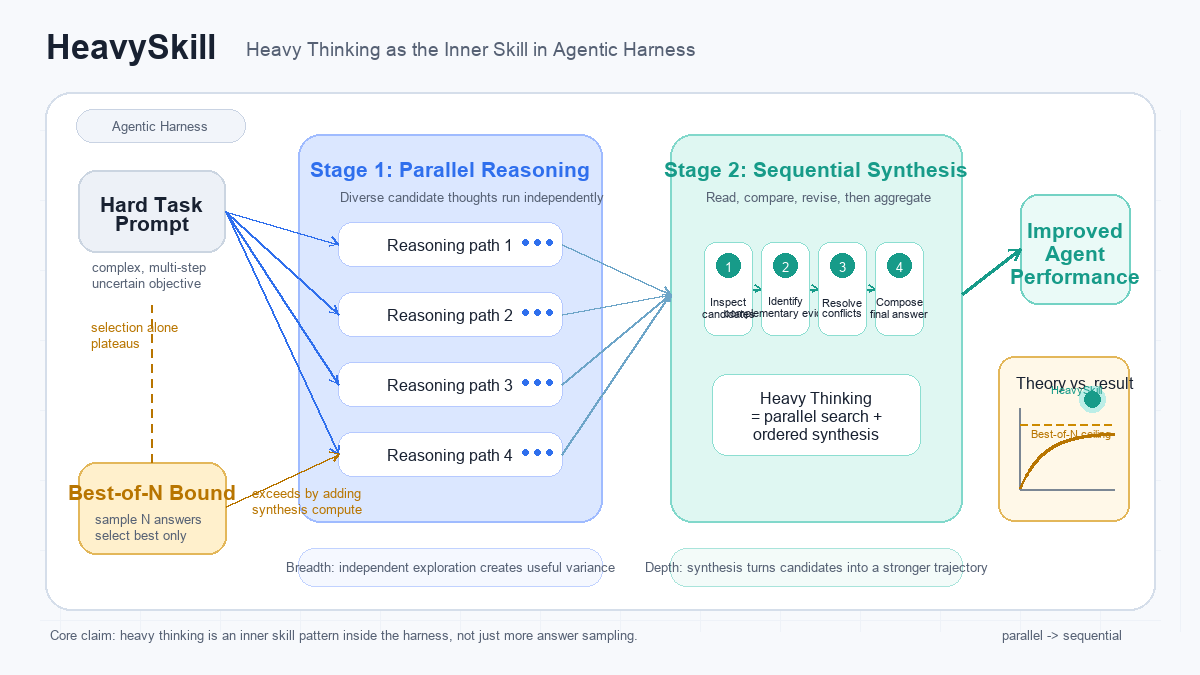

복잡한 에이전틱 하네스의 성능을 실제로 끌어올리는 건 뭘까요? 이 논문은 답이 '병렬 추론 + 순차적 종합'이라는 두 단계 패턴에 있다고 봅니다. Best-of-N의 이론적 상한을 넘는 Heavy Thinking의 구조와 실험 결과를 정리합니다.

-

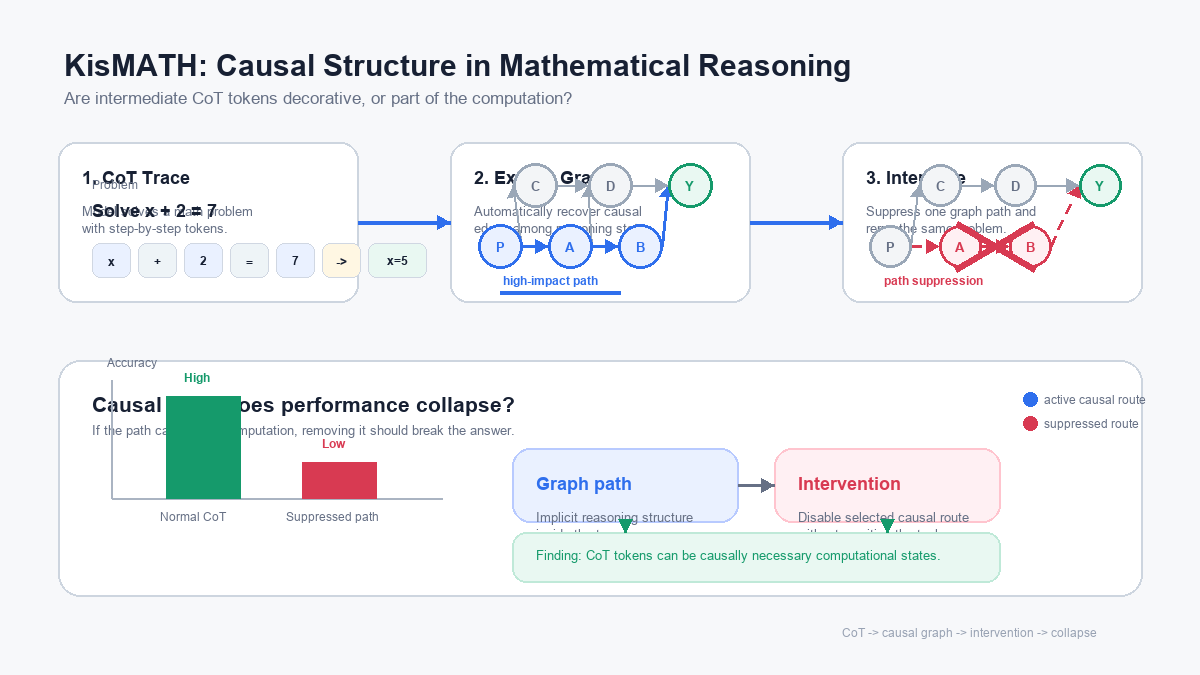

CoT가 왜 되는지 아무도 몰랐습니다. KisMATH는 추론 트레이스에서 인과 그래프를 자동으로 추출하고, 그 그래프 경로를 억제했을 때 모델이 실제로 붕괴하는지 실험으로 확인했습니다. "중간 토큰이 장식이냐 실제 계산이냐"는 질문에 처음으로 엄밀한 인과 답변을 내놓은 연구입니다.

-

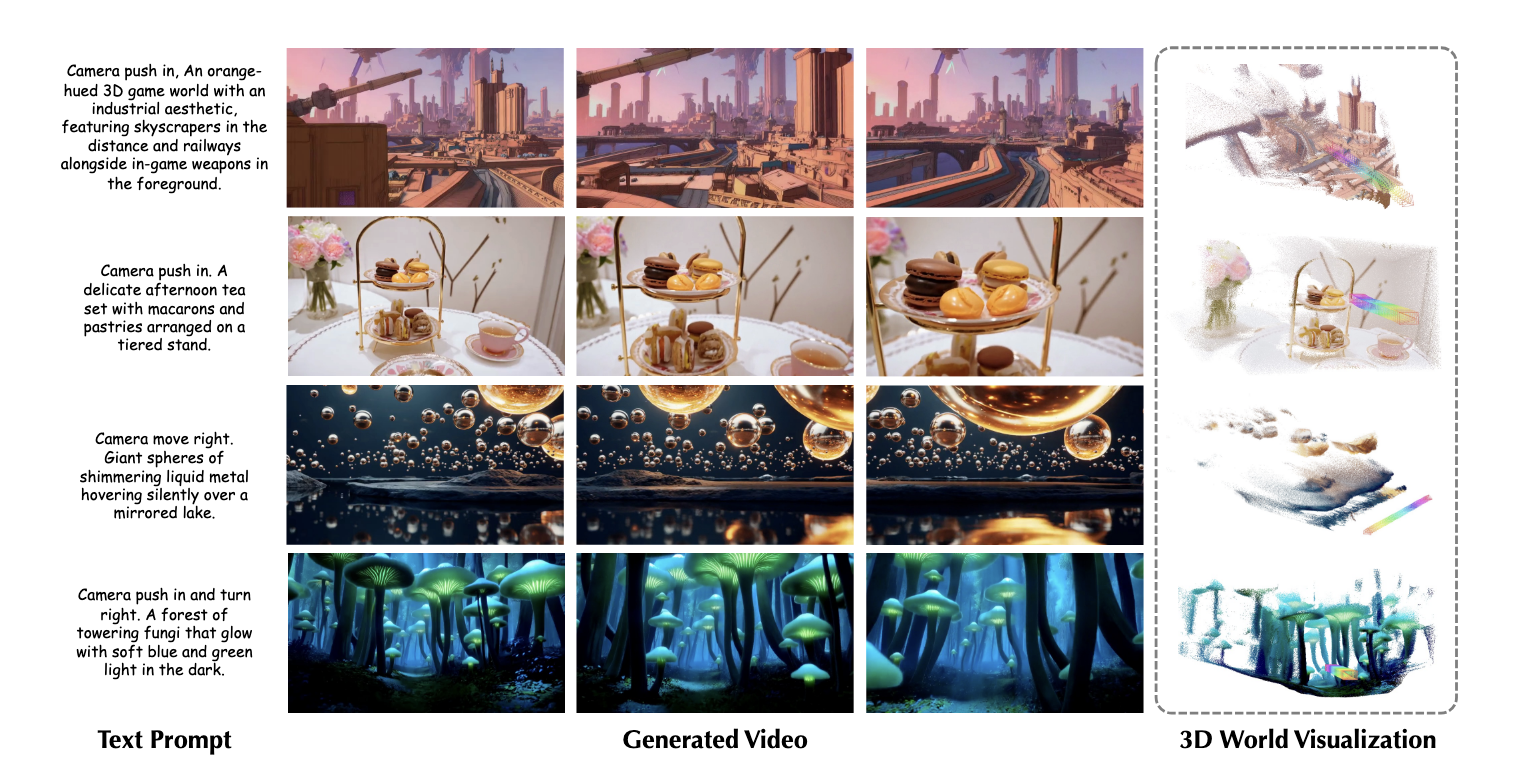

텍스트-투-비디오 모델들은 눈을 뗄 수 없을 만큼 아름다운 영상을 만들어냅니다. 그런데 카메라가 크게 움직이는 순간, 뭔가 이상해집니다. 건물 벽이 녹아내리고, 물체가 갑자기 사라지고, 물리적으로 말이 안 되는 장면을 생성합니다. World-R1은 이 문제를 아키텍처 수정 없이, 강화학습(RL)만으로 해결한다고 주장합니다.

-

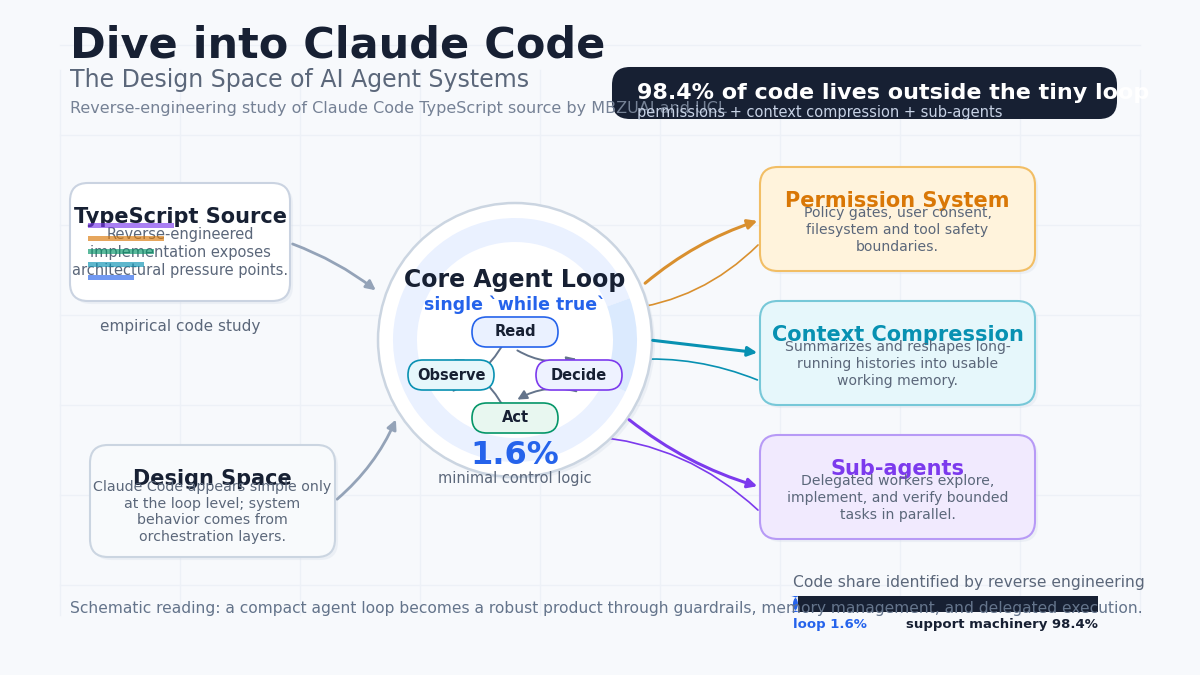

Claude Code의 TypeScript 소스를 직접 뜯어본 MBZUAI·UCL 연구. 핵심 루프는 while-true 한 덩이지만, 권한 시스템·컨텍스트 압축·서브에이전트가 코드의 98.4%를 차지합니다.

-

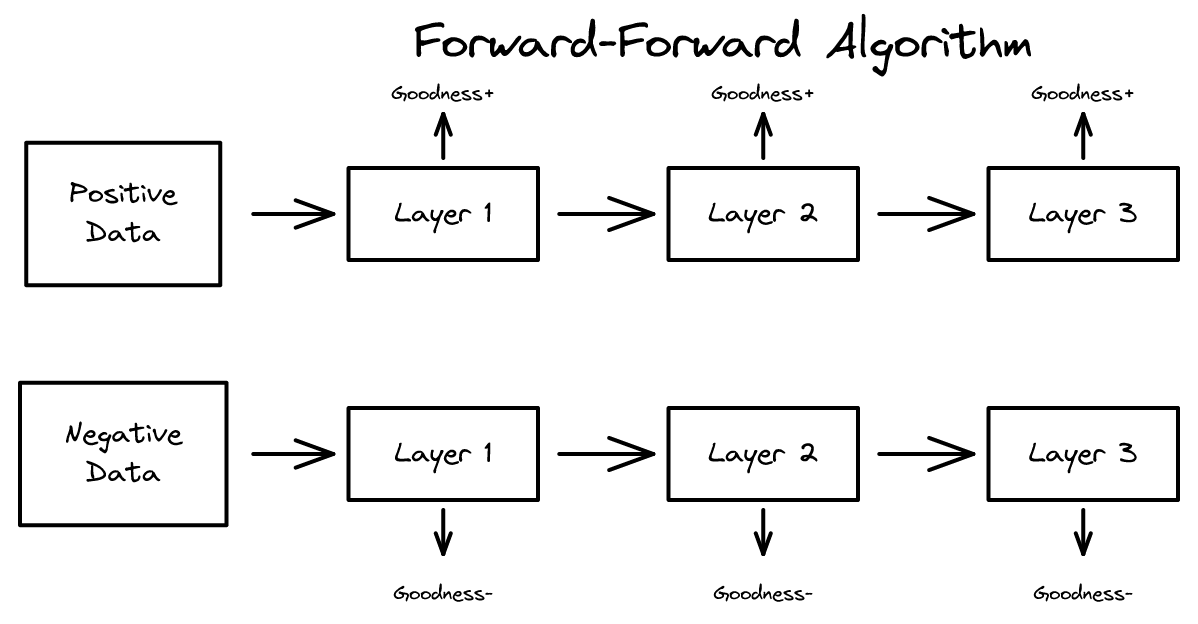

역전파를 두 번의 순전파로 대체하는 Forward-Forward 알고리즘. 각 층이 자체 목적함수로 학습하며 생물학적 타당성 향상

-

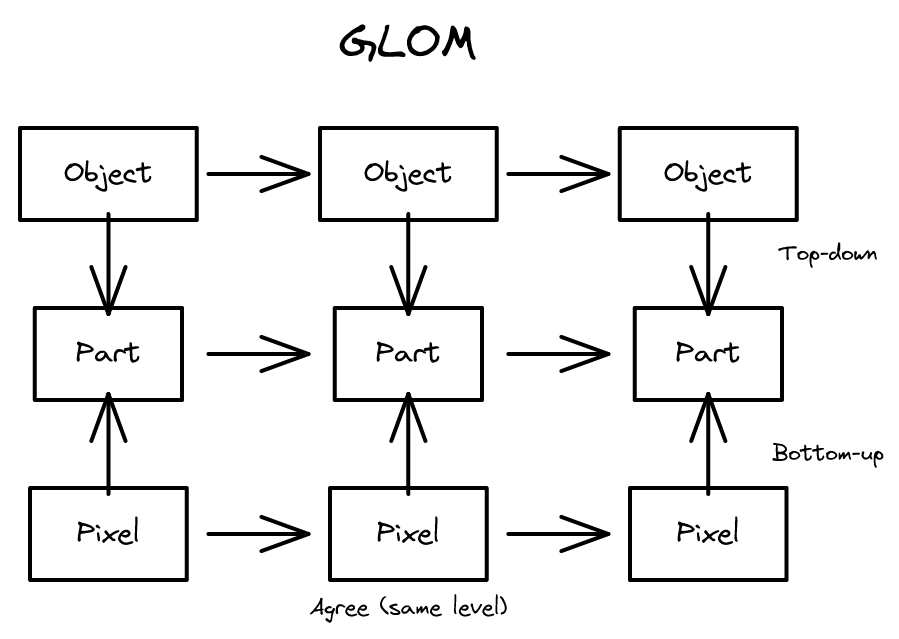

부분-전체 계층 구조를 신경망으로 표현하는 GLOM 모델 제안. 동일 벡터들의 '섬'으로 구문 구조를 인코딩하는 사변적 아키텍처

-

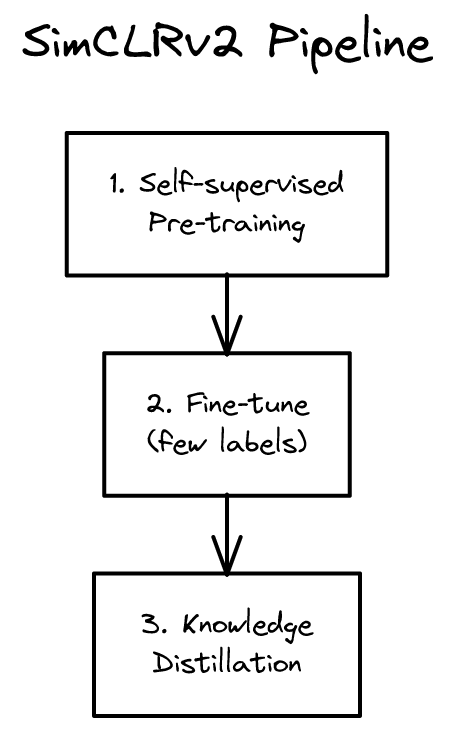

SimCLR 개선판. 자기지도 사전훈련 + 소량 라벨 미세조정의 강력함을 대규모로 검증. 반지도 학습의 새 기준

-

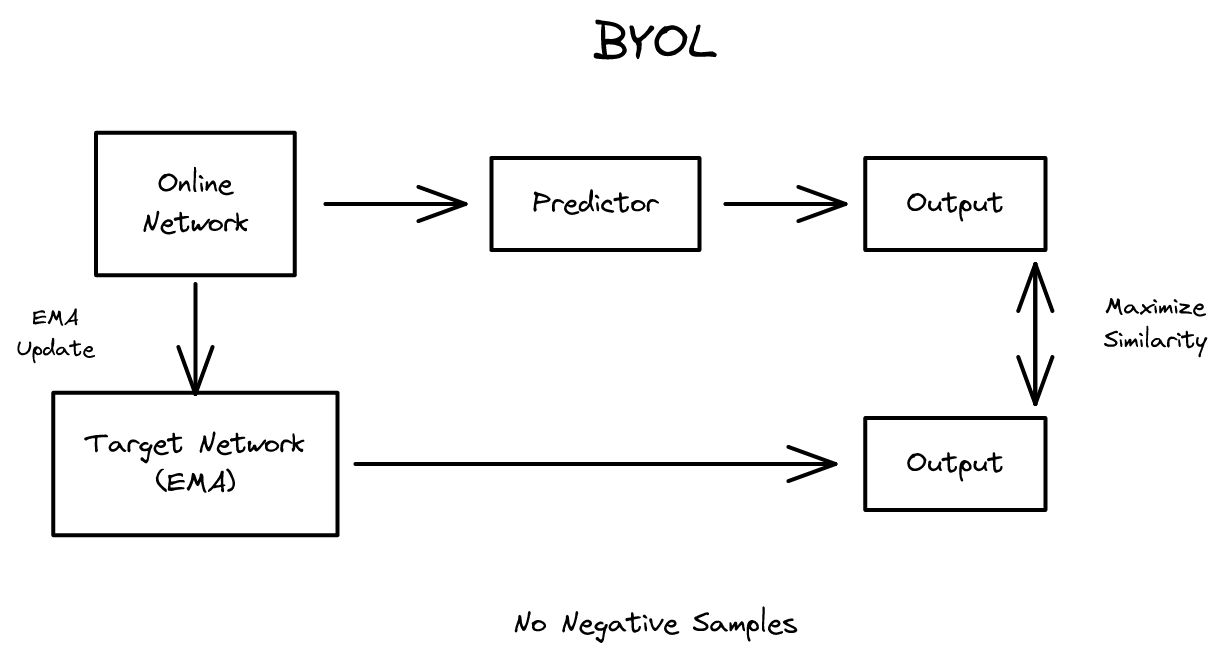

부정 샘플 없이 자기지도 학습하는 방법. SimCLR과 달리 음의 예가 필요 없으며, 온라인-타겟 네트워크 구조로 표현 학습 수행

-

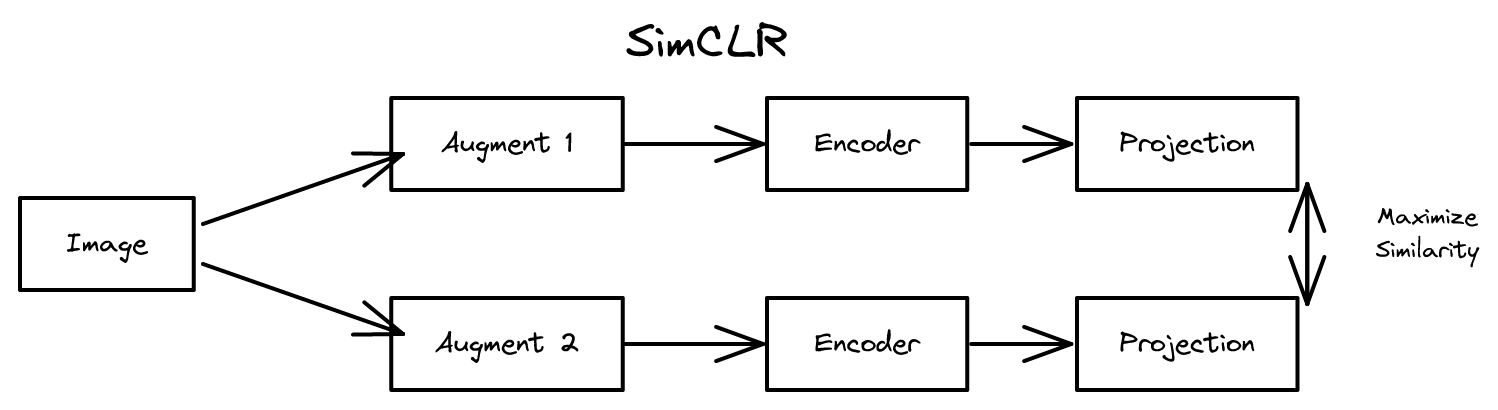

자기지도 대조 학습(contrastive learning) 프레임워크. 데이터 증강과 대조 손실로 라벨 없이 강력한 표현 학습. 10,000+ 인용

-

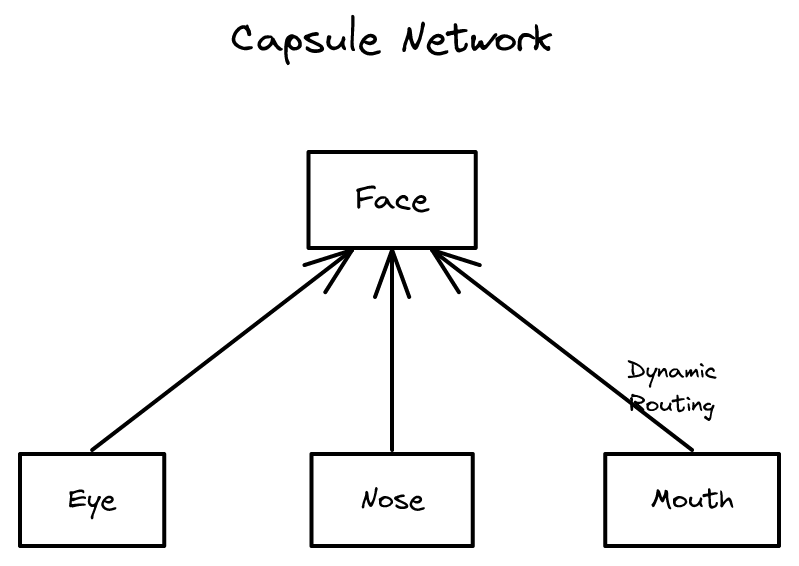

Dynamic Routing Between Capsules 2026-04-18

Dynamic Routing Between Capsules 2026-04-18CNN의 공간 계층 무시 문제를 캡슐 네트워크와 동적 라우팅으로 해결하는 접근. 구조 정보 기반 신경망 설계

-

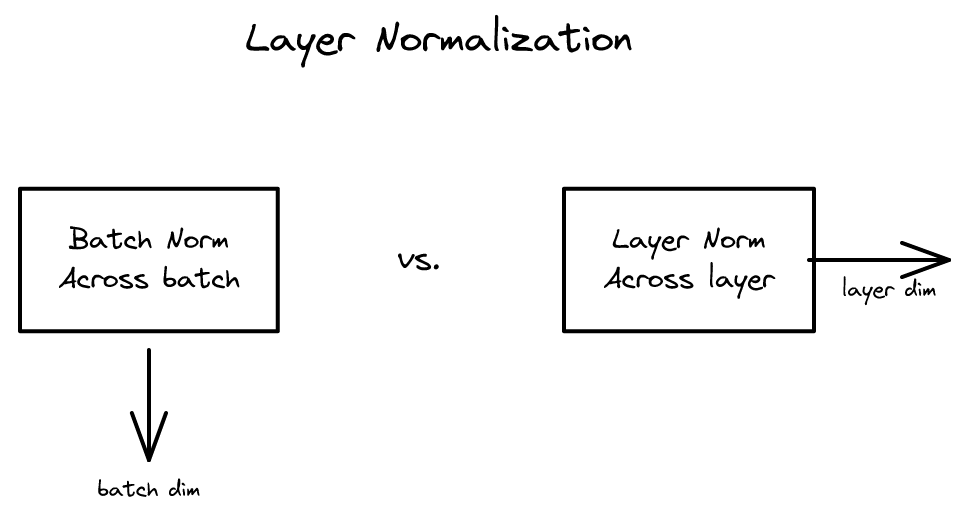

Layer Normalization 2026-04-17

Layer Normalization 2026-04-17배치 대신 레이어 단위로 정규화하는 방법. RNN과 Transformer에서 핵심 구성요소가 된 기법

-

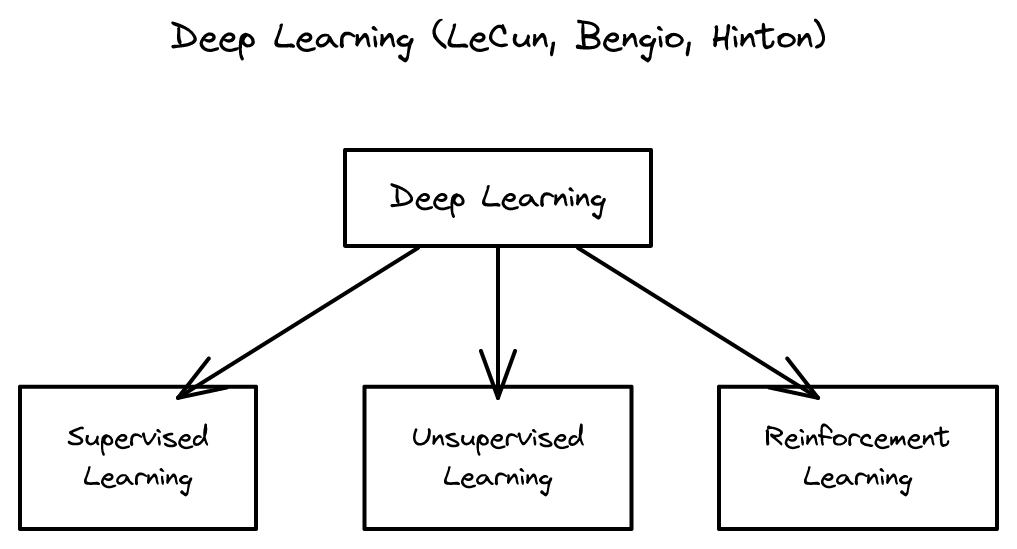

Deep Learning (Nature 2015) 2026-04-16

Deep Learning (Nature 2015) 2026-04-16LeCun, Bengio, Hinton 3대 거장이 함께 쓴 딥러닝 분야 정의 논문으로, 이 분야의 핵심 개념과 이전 60년의 발전사를 종합한 이정표입니다.

-

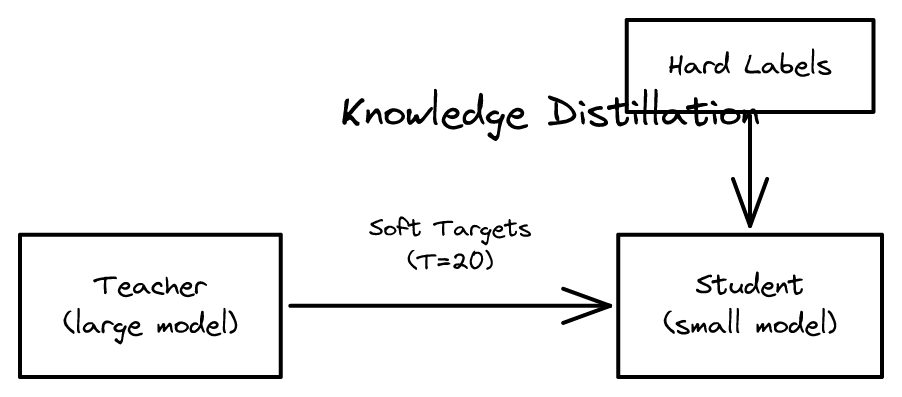

Distilling the Knowledge in a Neural Network 2026-04-15

Distilling the Knowledge in a Neural Network 2026-04-15지식 증류는 큰 모델의 '소프트 타겟'으로 작은 모델을 훈련하는 기법으로, 현대 모델 압축과 배포의 표준이 되었습니다.

-

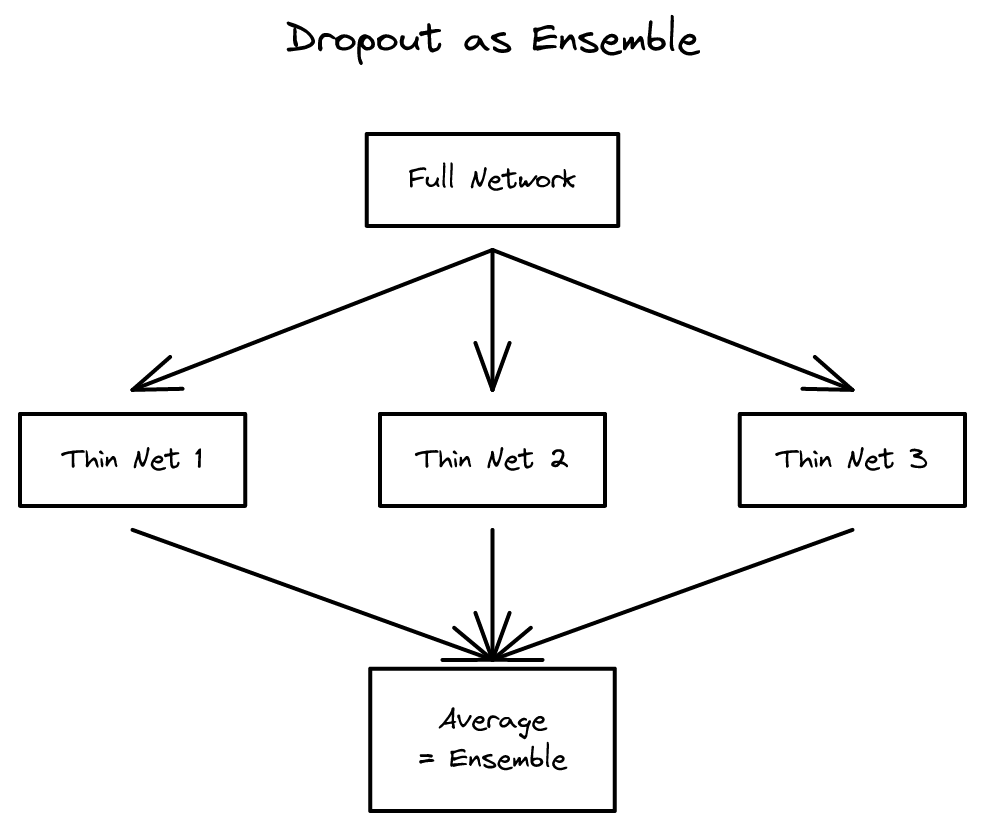

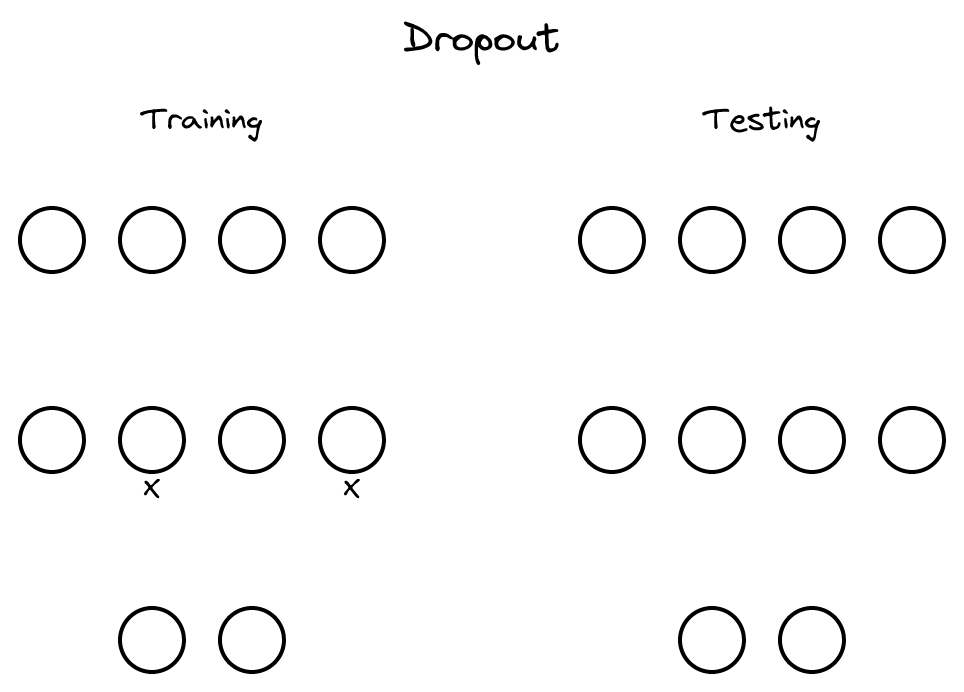

훈련 시 뉴런을 확률적으로 끄는 Dropout은 단순하면서도 강력한 정규화 기법으로, 딥러닝의 표준 도구가 되었습니다.

-

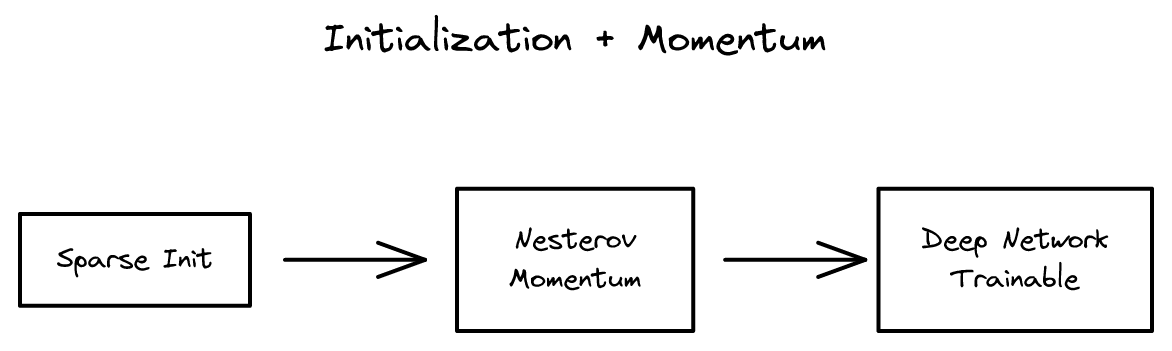

모멘텀 기반 최적화의 중요성을 입증. Nesterov 모멘텀과 적절한 초기화의 조합이 SGD를 크게 개선함을 보인 논문.

-

Dropout의 원조 논문. 특징 탐지기의 공동적응을 방지하여 일반화 성능 개선. 2014 JMLR 논문의 전신

-

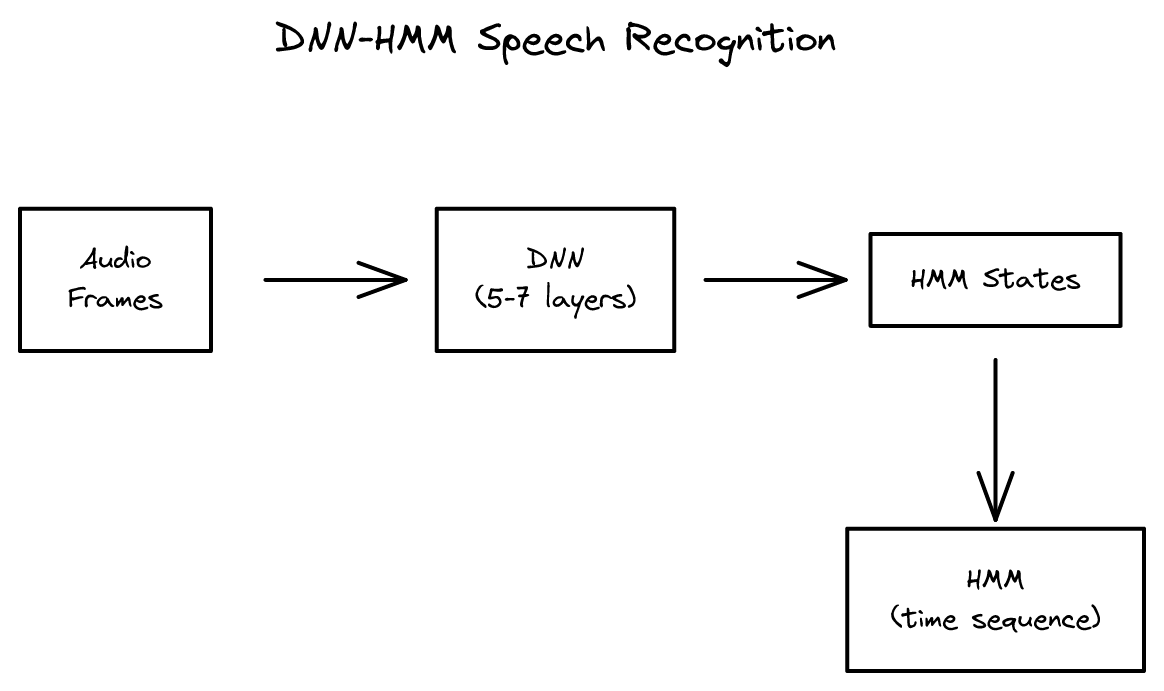

Google, Microsoft, IBM, Toronto 4개 연구팀의 공동 논문으로, 딥러닝을 음성인식 산업에 처음 성공적으로 적용한 기념비적 논문입니다.

-

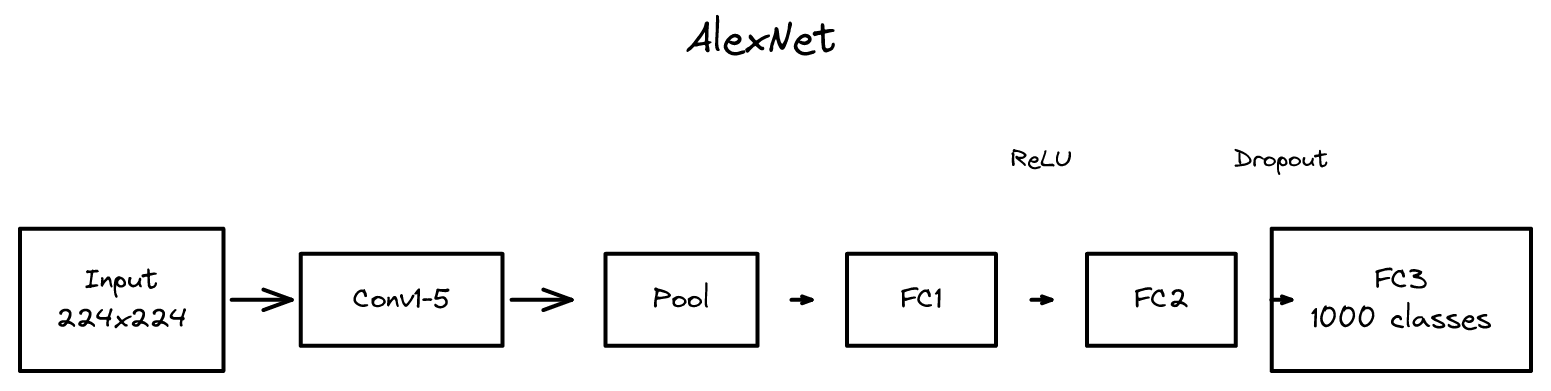

ImageNet 대회에서 압도적으로 우승한 AlexNet은 GPU 활용, ReLU, Dropout을 결합하여 딥러닝의 실용성을 처음 증명한 논문입니다.

-

메타는 이미지의 세밀한 속성을 표현하기 위해 이미지 생성을 한 번에 하지 않고, 계획-스케치-검수-수정의 반복 루프로 분해합니다.

-

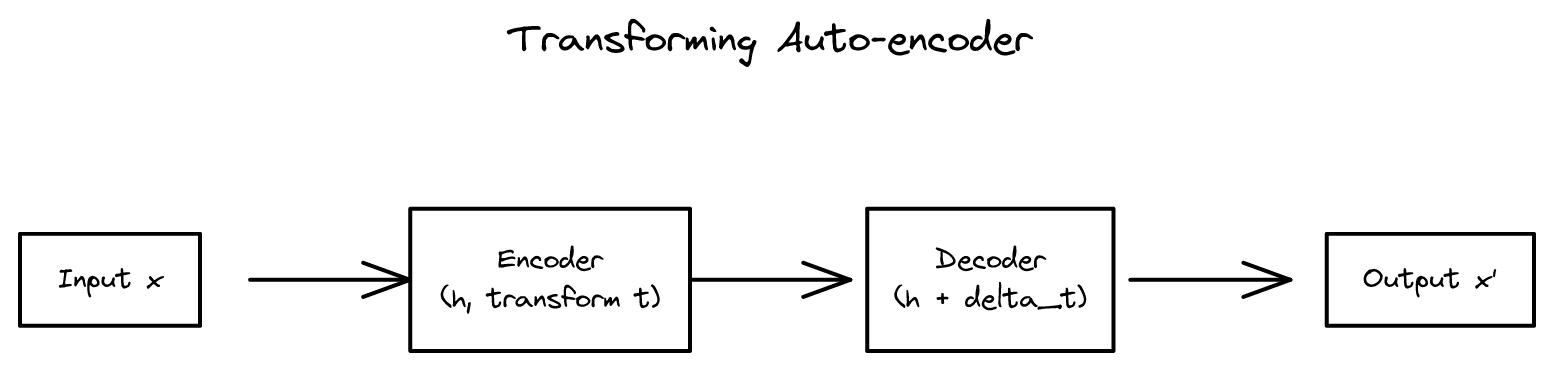

Transforming Auto-encoders 2026-04-09

Transforming Auto-encoders 2026-04-09캡슐 신경망 아이디어의 첫 등장. 변환에 등변(equivariant)한 표현을 학습하여 기하학적 불변성 추구

-

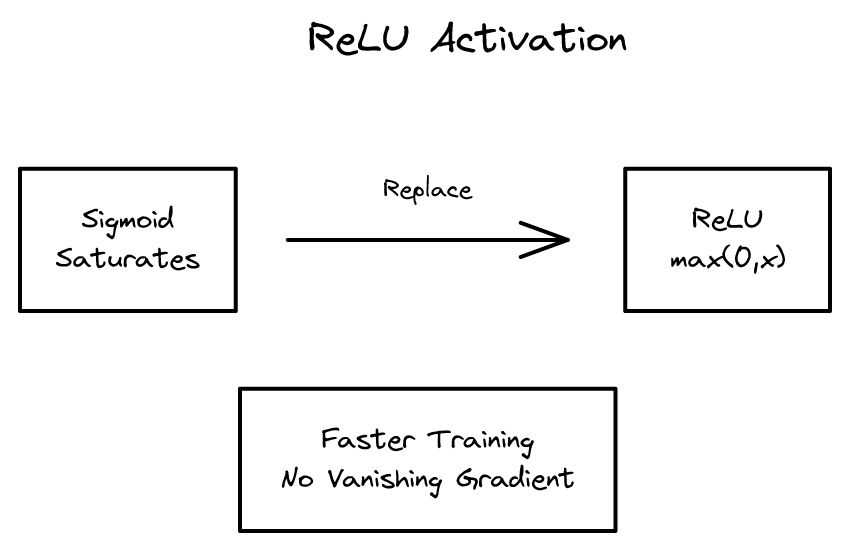

ReLU 활성화 함수를 RBM에 도입. 이후 거의 모든 딥러닝의 표준 활성화 함수가 되어 신경망 실무를 크게 단순화한 논문.

-

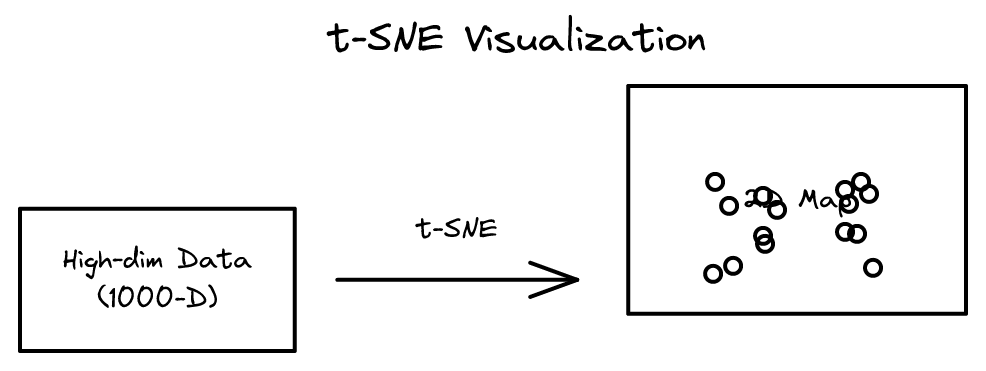

Visualizing Data using t-SNE 2026-04-07

Visualizing Data using t-SNE 2026-04-07확률적 근이웃 임베딩의 개선된 버전 t-SNE. 고차원 데이터의 시각화에 특화된 알고리즘으로 ML 연구에서 가장 널리 사용되는 방법.

-

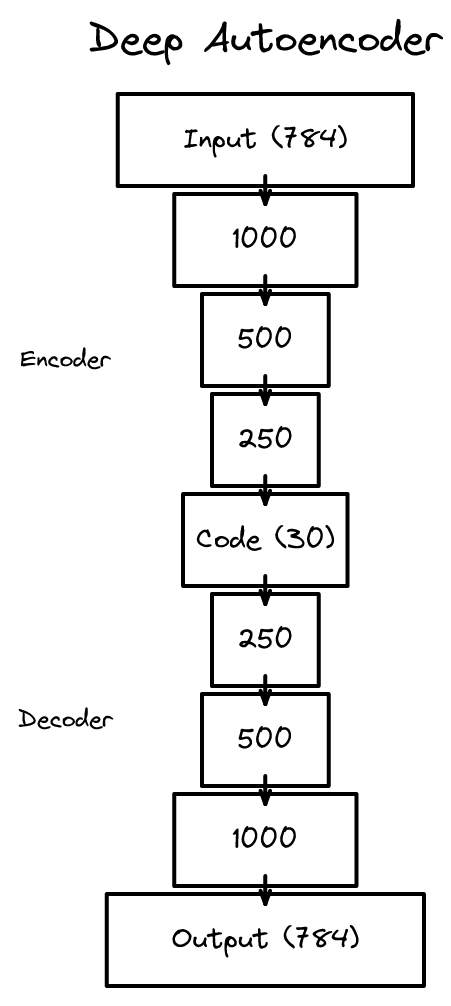

깊은 오토인코더로 비선형 차원 축소를 수행. PCA보다 우수한 성능을 보여 신경망 기반 차원 축소의 실용성을 입증한 논문.

-

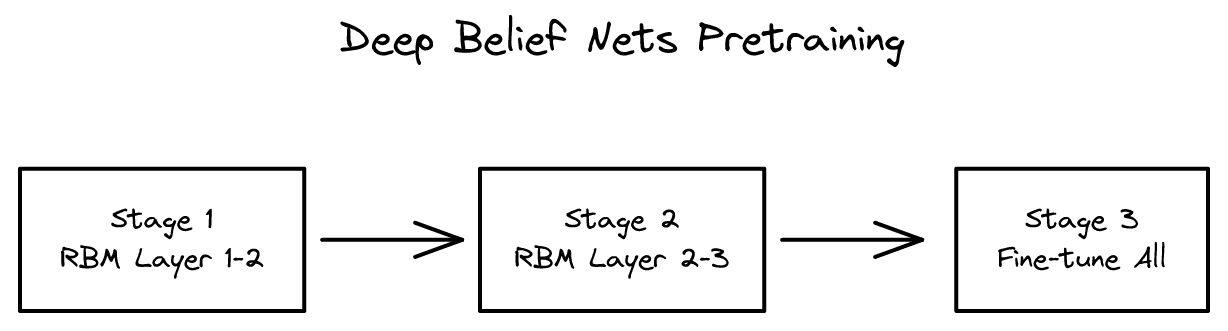

층별 사전훈련으로 심층 신경망 학습을 가능하게 한 논문. 깊은 신경망 학습의 문제를 해결하고 '딥러닝'이라는 용어를 탄생시킨 획기적 연구.

-

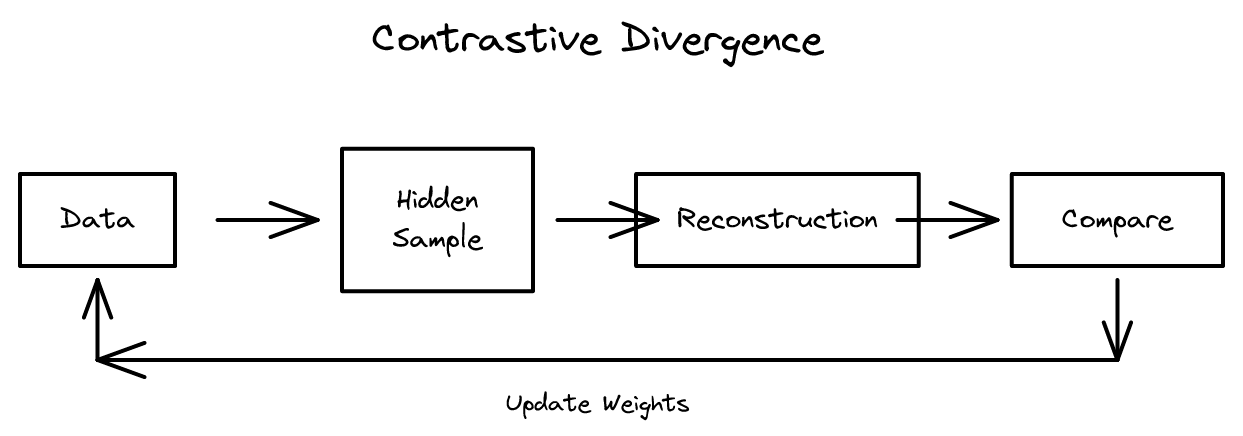

대조 발산 알고리즘으로 전문가 혼합 모델을 훈련하는 실용적 방법, RBM 훈련의 핵심 기법

-

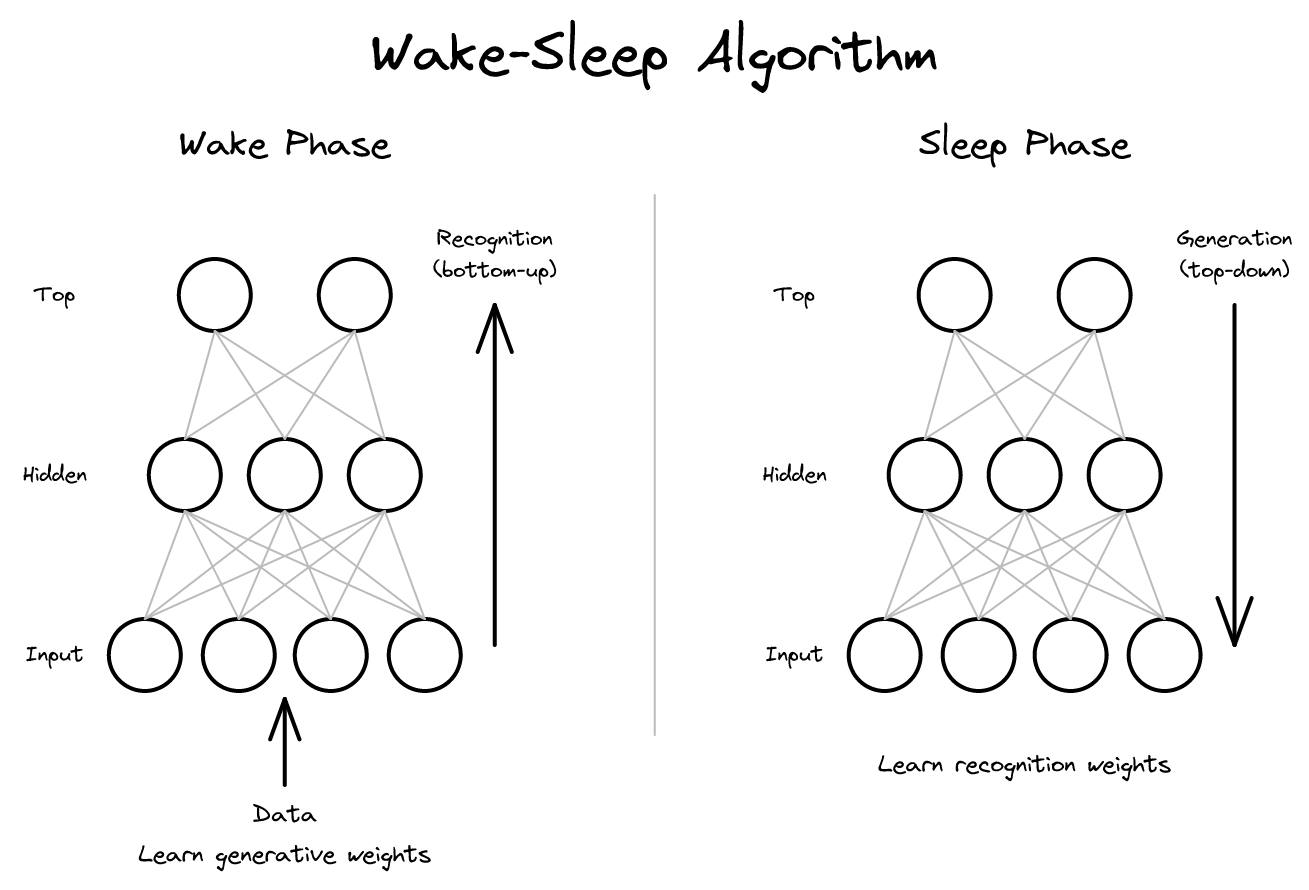

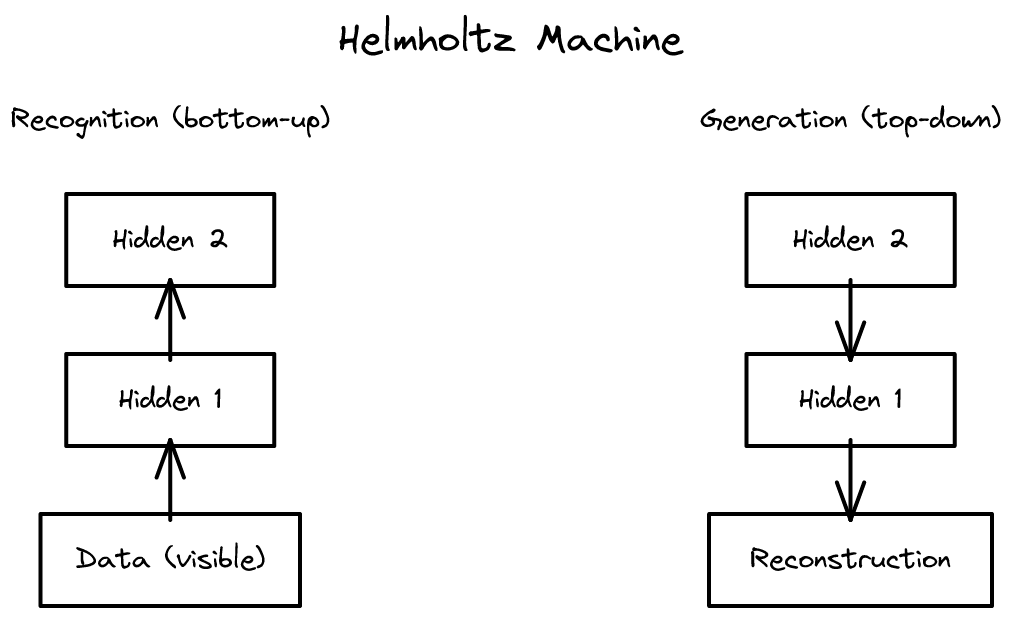

계층적 생성 모델을 비지도 학습하는 구체적 방법: 깨어 있을 때는 인식을 배우고 자는 동안 생성을 배운다

-

The Helmholtz Machine 2026-04-02

The Helmholtz Machine 2026-04-02생성 모델과 인식 모델을 분리하고, 변분 추론의 신경망 구현을 제시한 선구적 작업

-

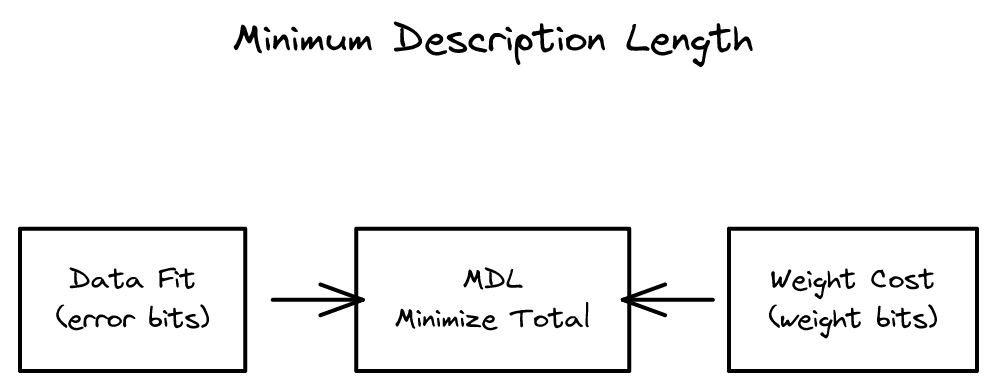

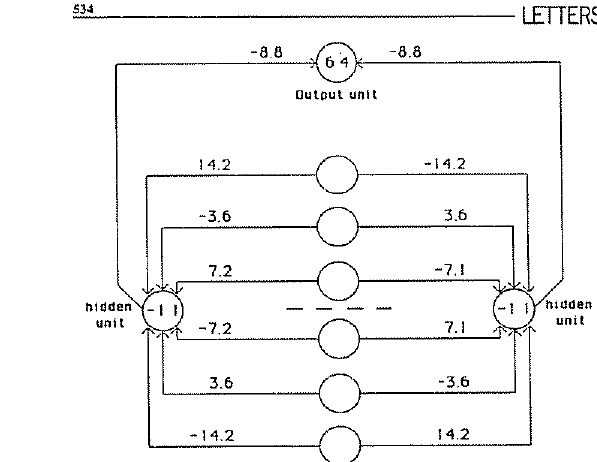

최소 설명 길이(MDL) 원칙으로 신경망의 가중치 복잡도를 줄여 과적합을 방지. 베이지안 딥러닝의 초기 연구

-

다층 신경망을 훈련하는 역전파 알고리즘을 Nature 한 편으로 정리하고, 은닉층이 과제에 맞는 내부 표현을 자동으로 만들 수 있음을 보인 1986년 논문입니다.

-

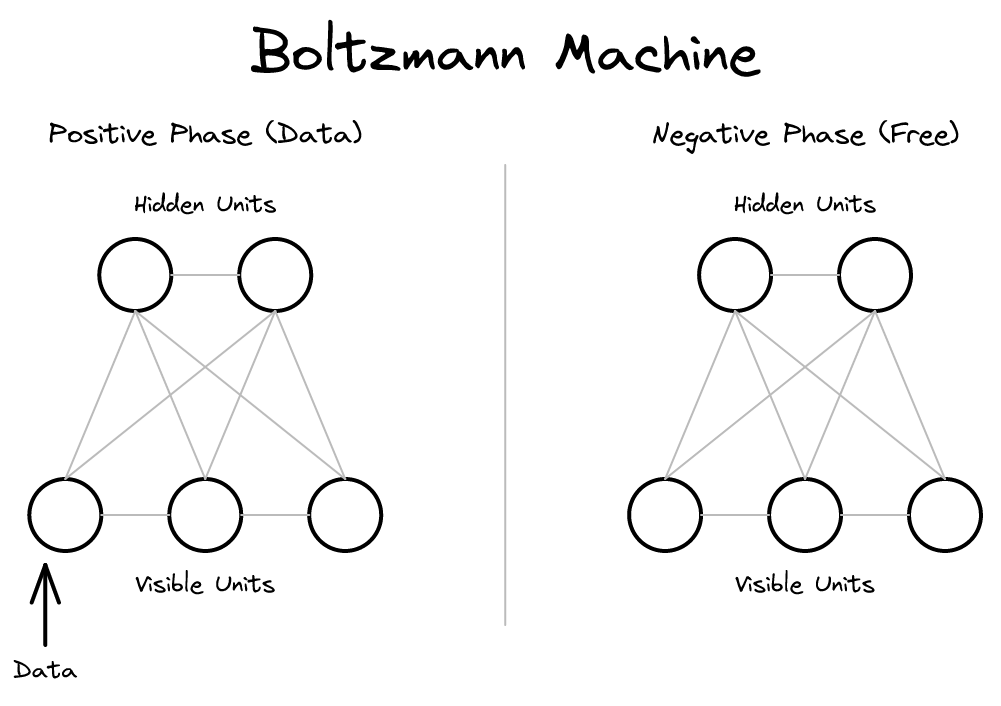

A Learning Algorithm for Boltzmann Machines 2026-03-30

A Learning Algorithm for Boltzmann Machines 2026-03-30병렬 신경망이 제약 만족 문제를 어떻게 해결하는지 보여준 에너지 기반 모델의 시작

-

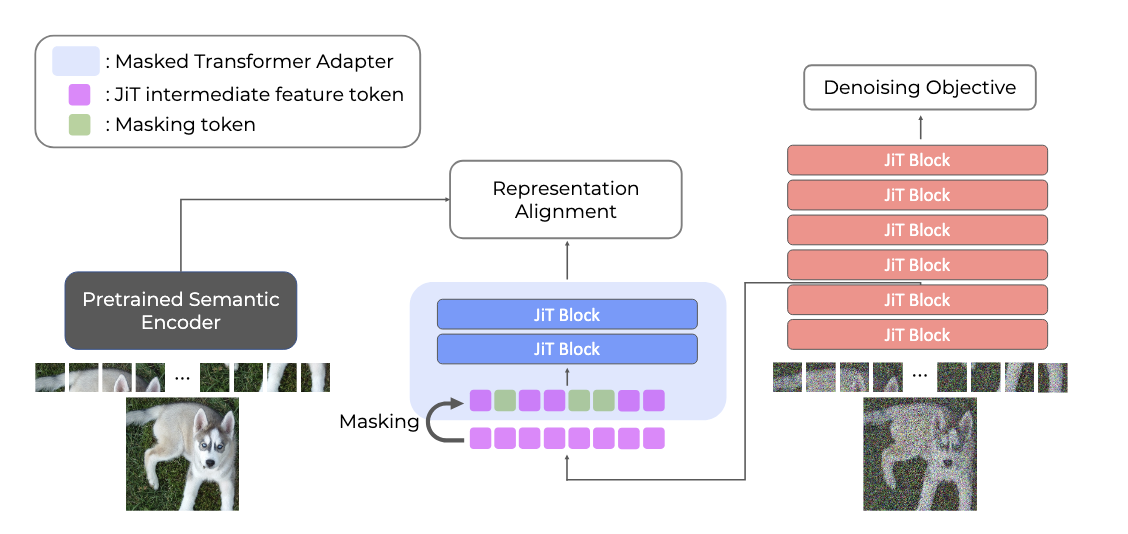

REPA가 잠재 공간 디퓨전에서는 잘 작동하지만 픽셀 공간 디퓨전(JiT)에서는 오히려 성능을 악화시킨다는 걸 밝혔습니다. 원인은 정보 비대칭으로 인한 feature hacking. 이를 해결하는 PixelREPA를 제안하여 JiT-B/16 FID를 3.66에서 3.17로, JiT-H/16은 1.81까지 낮췄습니다. KAIST AI.

-

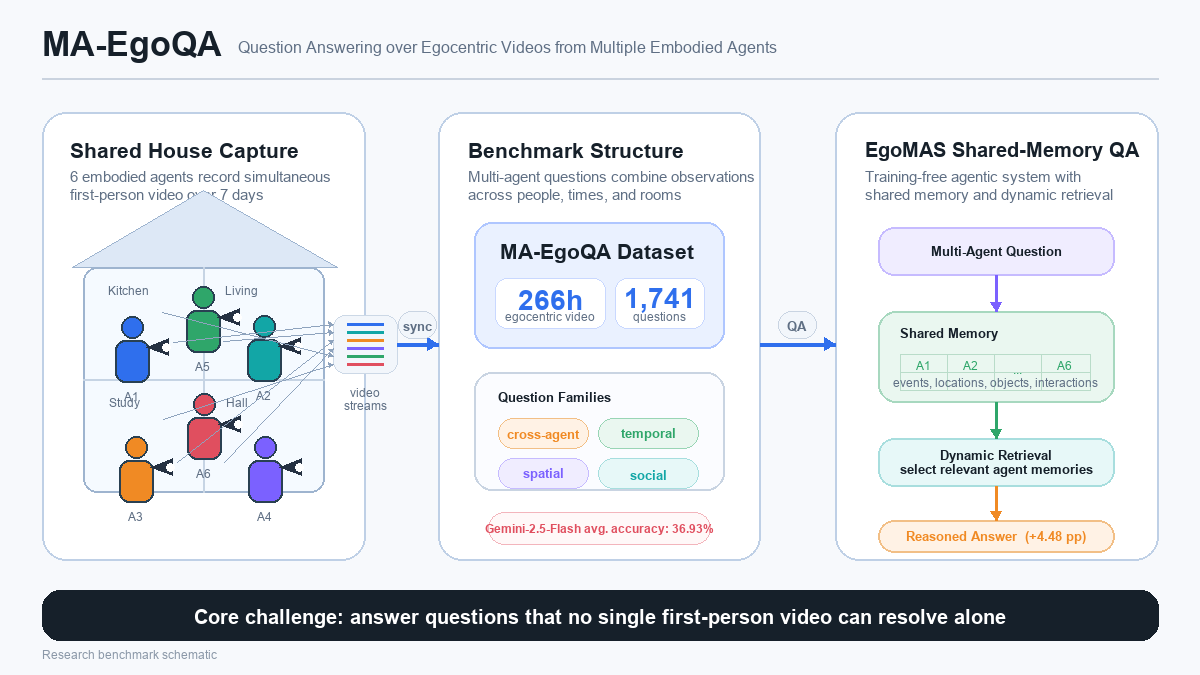

MA-EgoQA는 여러 구현체(embodied agent)가 동시에 촬영한 1인칭(egocentric) 영상을 종합적으로 이해하고 질의응답하는 최초의 벤치마크입니다. 6명이 7일간 공유 주택에서 생활하며 촬영한 총 266시간의 영상을 기반으로, 1,741개의 다중 에이전트 고유 질문을 제공합니다. 현재 최고 성능 모델인 Gemini-2.5-Flash조차 평균 정확도 36.93%에 그쳤고, 함께 제안된 EgoMAS는 학습 없이(training-free) 공유 메모리 + 에이전트별 동적 검색만으로 Gemini-2.5-Flash를 4.48%p 앞섰습니다.

-

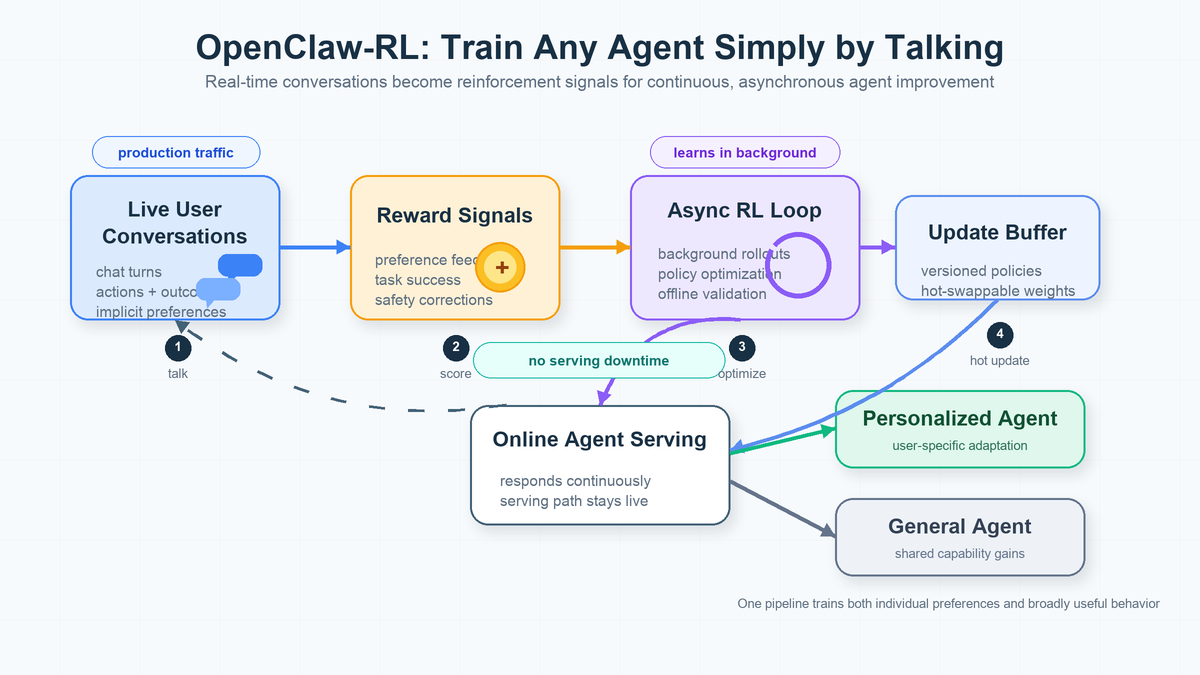

실시간 대화를 강화학습 신호로 전환하는 비동기 RL 프레임워크. 서빙 중단 없이 에이전트를 지속 개선하며, 개인화와 범용 에이전트를 하나의 파이프라인으로 훈련.

-

추론(reasoning)이 수학이나 코딩이 아닌 단순 사실 질문에서도 도움이 되는 이유를 밝힌 논문입니다. 두 가지 메커니즘을 발견했는데, 하나는 추론 토큰이 추가 연산 버퍼로 작용하는 것이고, 다른 하나는 관련 사실을 생성하면서 정답 회상을 촉진하는 factual priming입니다. 다만 중간에 할루시네이션된 사실이 끼면 최종 답도 틀릴 확률이 크게 올라갑니다. Google Research + Technion.

-

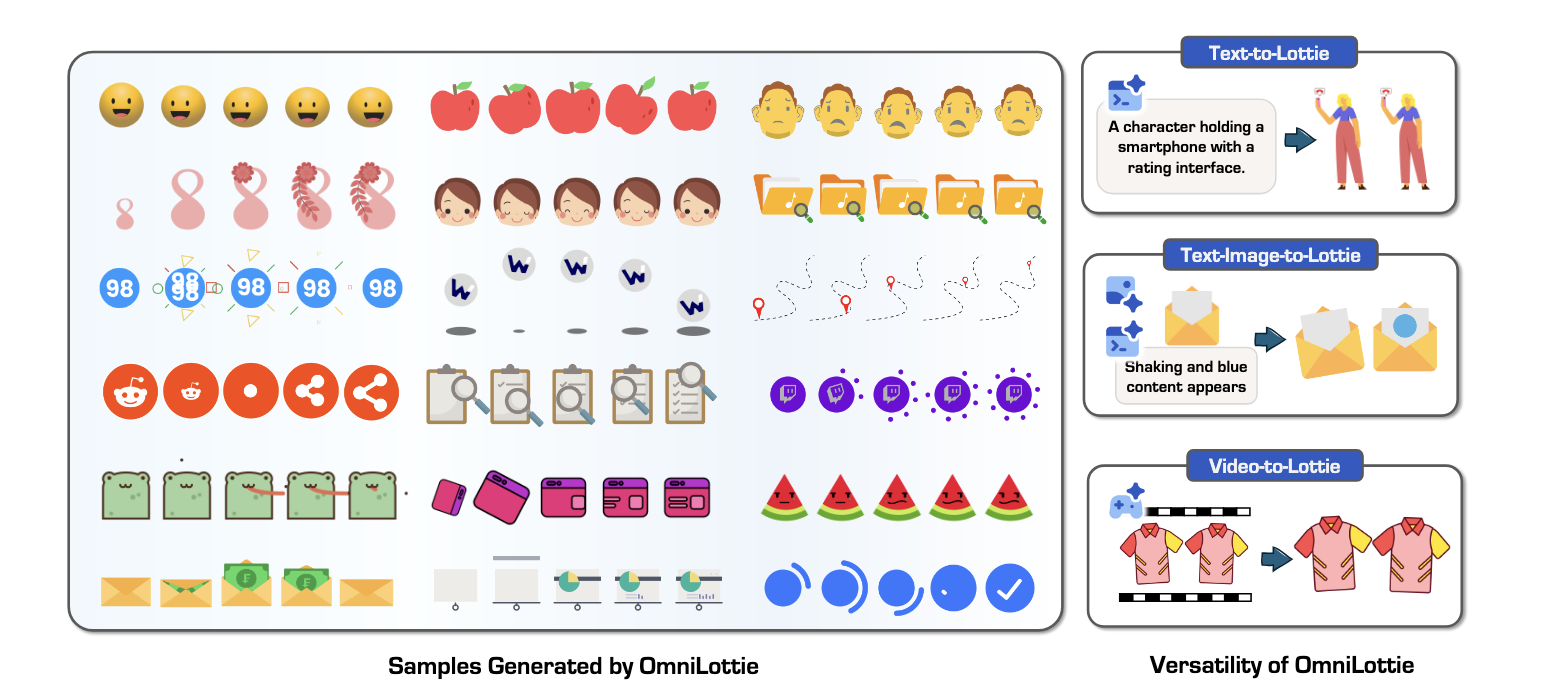

텍스트, 이미지, 영상에서 Lottie 벡터 애니메이션을 생성하는 최초의 멀티모달 프레임워크입니다. Lottie JSON을 파라미터화된 토큰으로 변환하는 토크나이저가 핵심이고, Qwen2.5-VL 기반 4B 모델로 88~93%의 생성 성공률을 달성했습니다. CVPR 2026 accept.

-

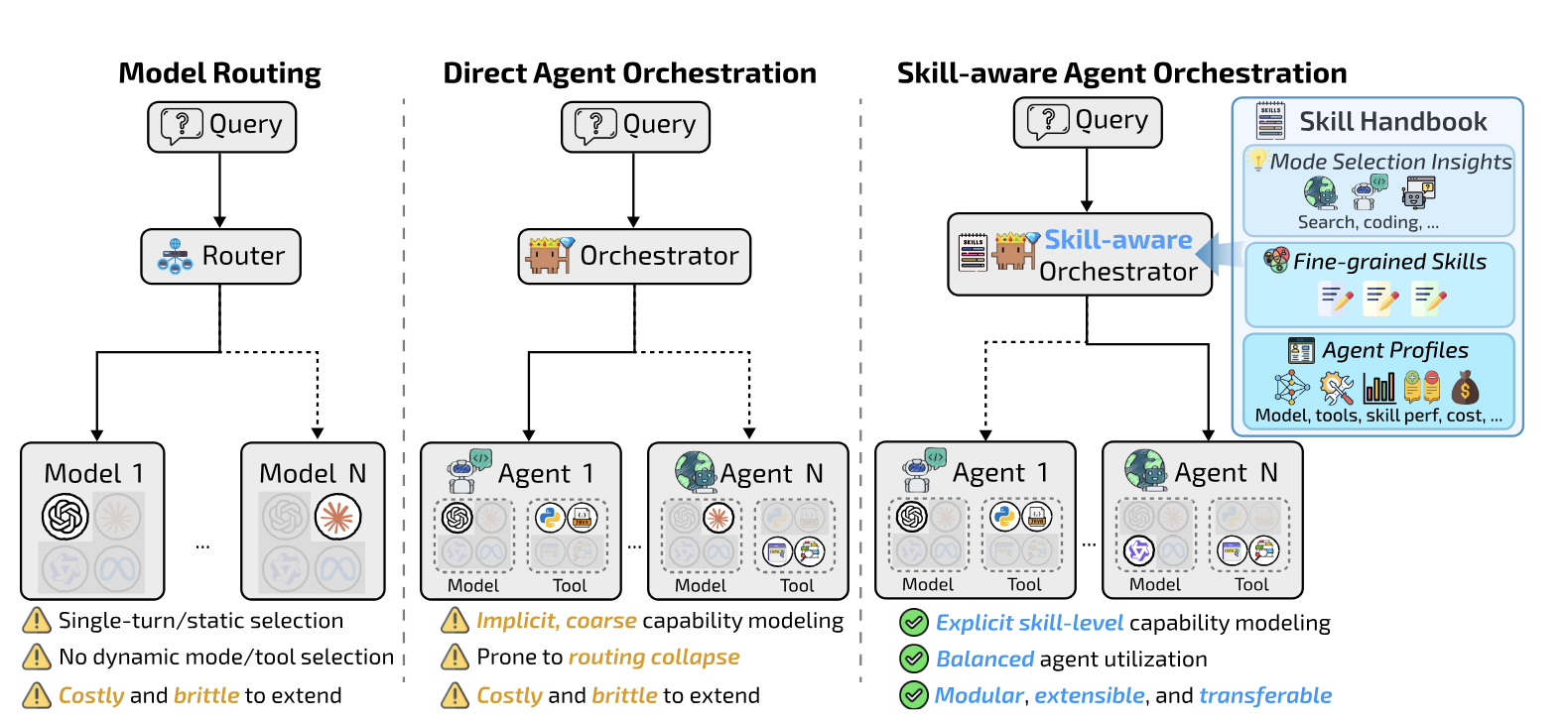

멀티 에이전트 시스템에서 "어느 모델에게 넘길까"를 결정하는 라우팅은 단발성 판단이거나 RL로 학습해도 한 모델에 98% 쏠리는 붕괴를 보입니다. SkillOrchestra는 실행 경험에서 재사용 가능한 "스킬 핸드북"을 학습해 RL 오케스트레이터 대비 22.5%p 정확도 향상과 700배 학습 비용 절감을 달성합니다. 위스콘신-매디슨·Salesforce AI Research 공동 연구.

-

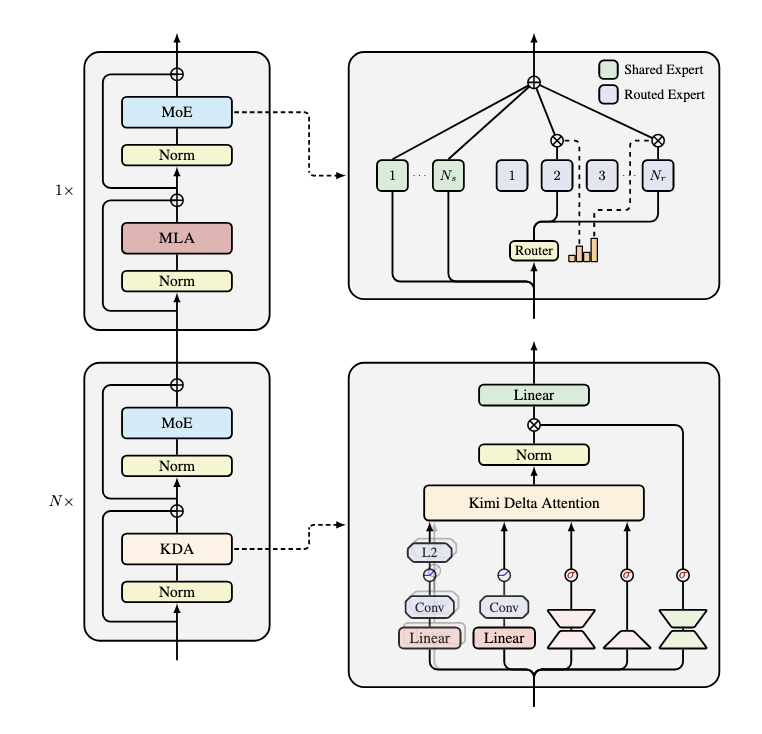

Kimi k2.5 - 200만 토큰의 멀티모달 에이전트 2026-02-10

Kimi k2.5 - 200만 토큰의 멀티모달 에이전트 2026-02-10200만 토큰 컨텍스트에 멀티모달 처리, 에이전틱 추론을 갖추고 나온 Kimi의 새로운 논문입니다. 핵심은 강화학습 기반의 2단계 훈련입니다. Agentic RL로 계획-실행-검증 루프를 학습하고, RLVR로 수학/코딩에서 자가 검증 능력을 키웠습니다. 파라미터 수도, 구체적 알고리즘도, 데이터셋 구성도 전부 미공개입니다.

-

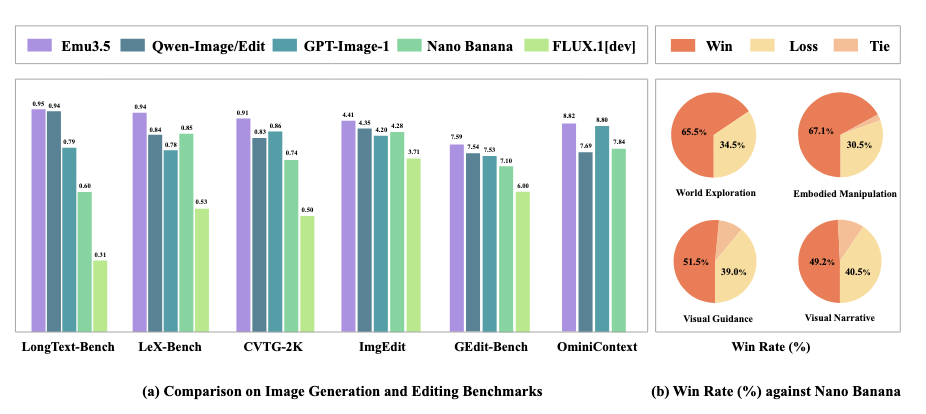

벌써 4.5가 나온다구요? 두 달 정도밖에 안 지났습니다. 아직 4.5는 테크니컬 리포트가 없습니다. 대신 4.0 테크니컬 리포트를 가져왔습니다. 2K 해상도 이미지를 1.4~1.8초 만에 생성하며, T2I 생성과 이미지 편집 작업을 단일 모델에서 공동 학습합니다. 특히 복잡한 텍스트 렌더링, 다중 이미지 참조, 인컨텍스트 추론 생성 등 기존 모델들이 취약했던 영역에서 강점을 보입니다.

-

여러 개의 언어 모델을 평균화하는 방식만으로 새로운 모델을 훈련시키지 않고도 성능을 높일 수 있습니다. 단순 평균이 아니라 각 모델의 강점이 나타나는 부분을 찾아 비율을 다르게 섞는 SoCE를 제안합니다. 함수 호출 벤치마크에서 새로운 최고 성능을 달성했습니다.

-

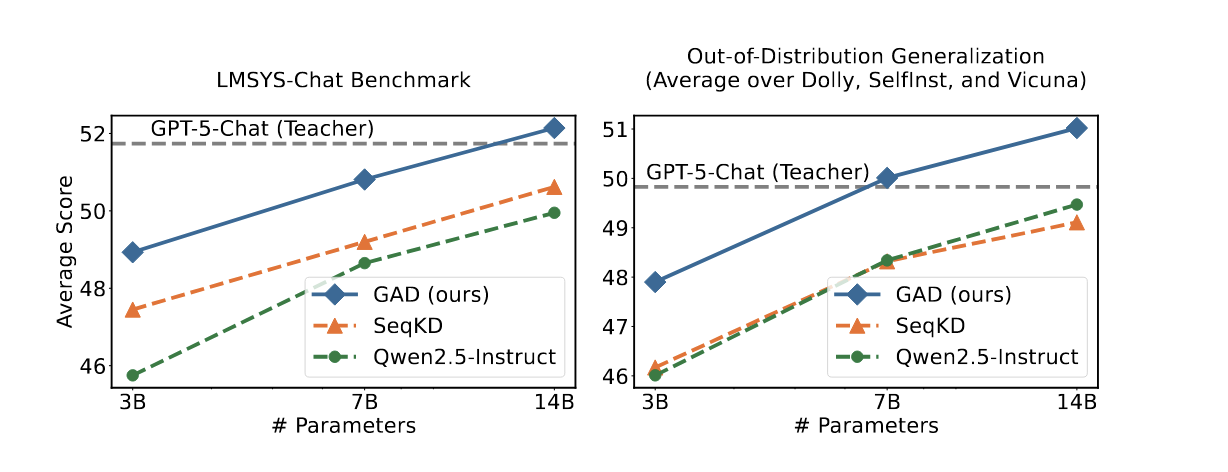

교사 모델의 내부를 전혀 들여다볼 수 없는 상황에서, 어떻게 효과적으로 지식을 전달받을 수 있을까요? Microsoft Research가 제안한 GAD(Generative Adversarial Distillation)는 이 문제에 대한 신선한 해법을 제시합니다.

-

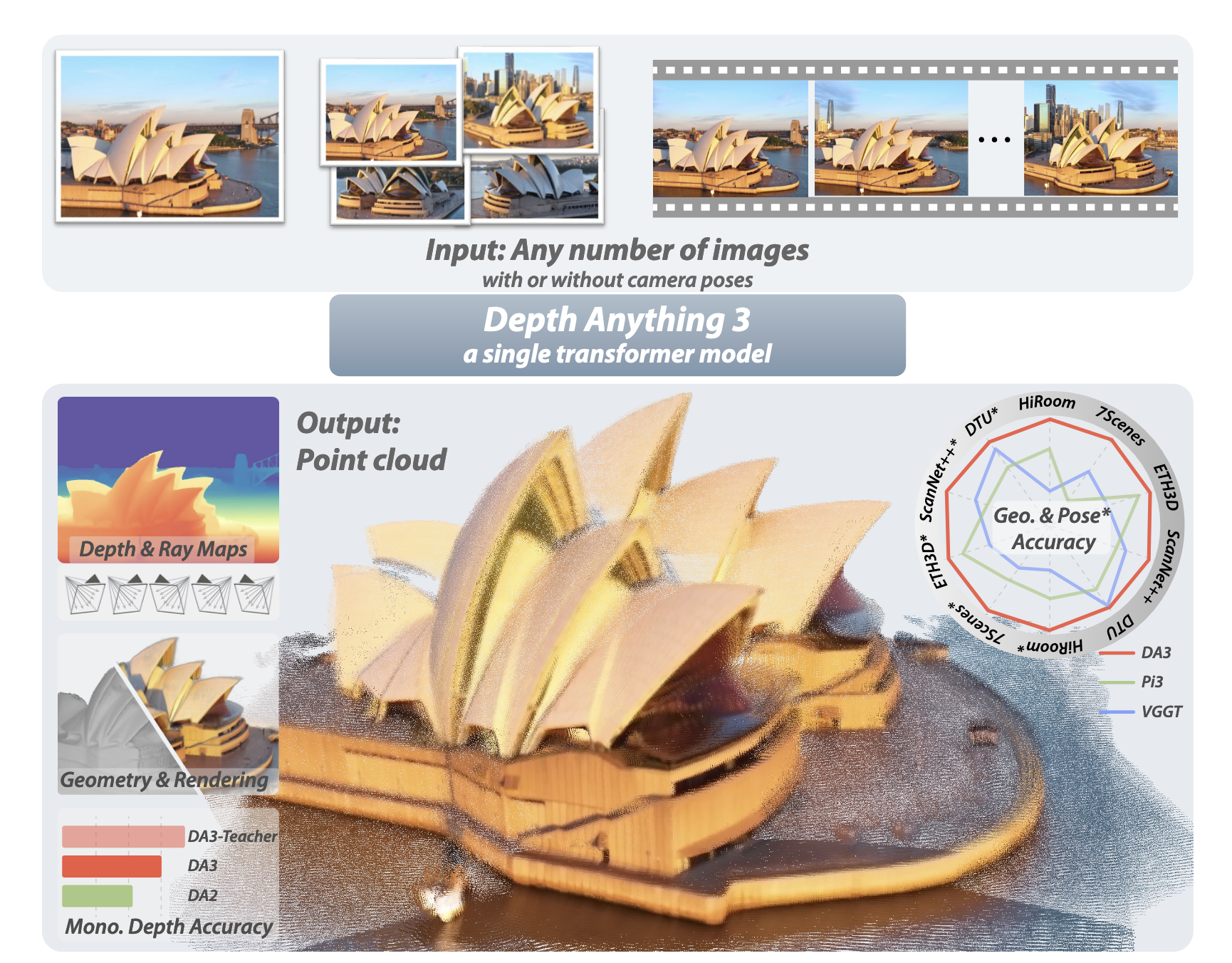

또이트댄스입니다. Depth Anything 3는 한 장의 이미지든 여러 장의 영상이든, 카메라 포즈 정보가 있든 없든 상관없이 3D 기하 정보를 예측하는 모델입니다. 평범한 트랜스포머 하나와 단순한 깊이-광선(depth-ray) 표현으로 이전 최고 성능을 44% 능가하는 성능을 달성했으며, 모든 데이터를 공개 학술 데이터셋으로만 학습했습니다.

-

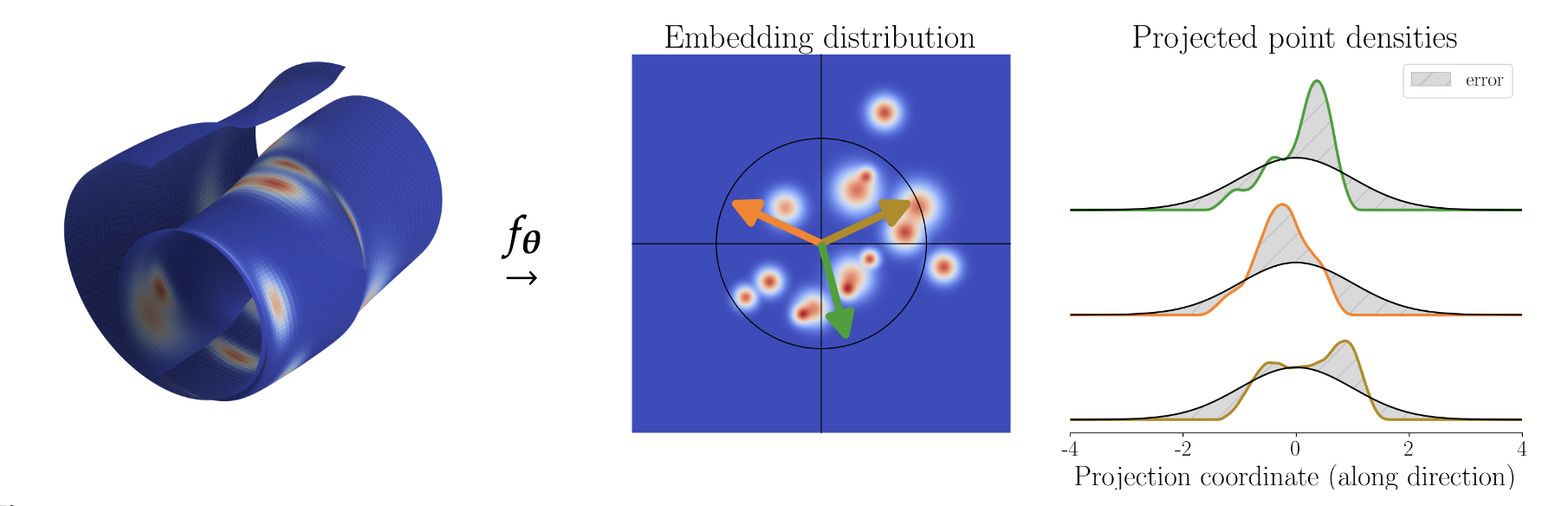

얀 르쿤과 바렐스트리에로의 최신 연구입니다! 자기 지도 학습(Self-Supervised Learning)에서 표현 붕괴(representation collapse)를 막기 위해 쓰던 여러 임시방편(stop-gradient, teacher-student network 등)들을 이론적으로 정당화하고 이를 단 50줄의 코드로 구현한 LeJEPA 논문입니다. 핵심은 '임베딩이 등방성 가우시안 분포를 따라야 한다'는 수학적 증명에 있습니다.

-

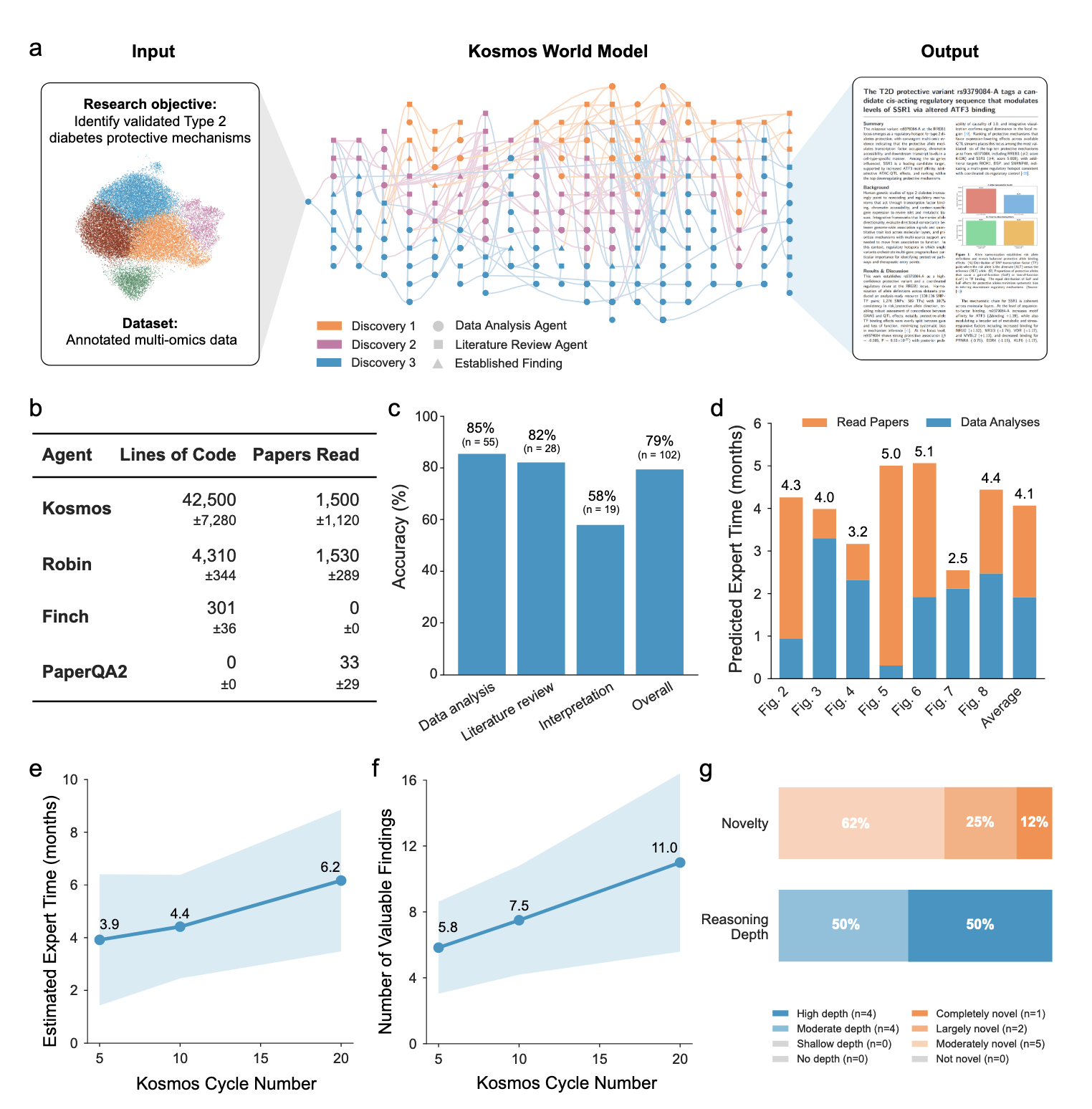

AI 과학자 Kosmos를 소개합니다. 데이터와 연구 목표를 주면 자동으로 논문을 읽고, 데이터를 분석하고, 가설을 생성해 과학 보고서를 작성합니다. 6개월간 인간 연구자가 수행할 작업을 하루에 끝내고 모든 단계가 투명하게 공개됩니다. 신경생물학, 재료과학, 통계유전학등 다양한 분야에서 실제 발견을 만들어냈습니다.

-

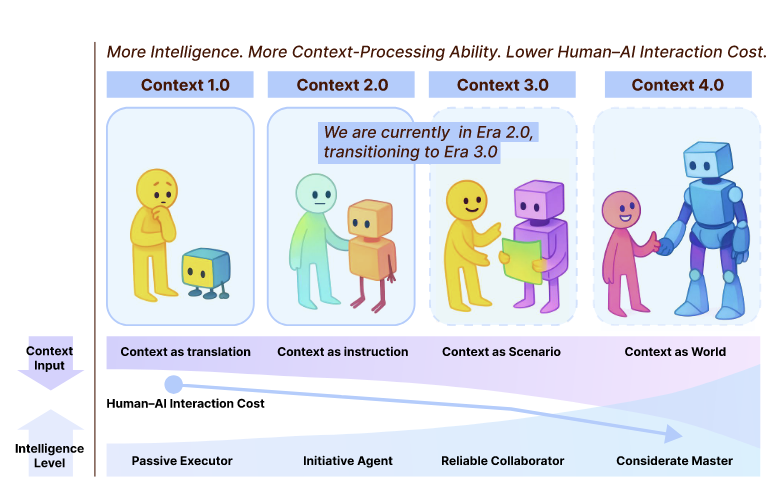

LLM의 일상화로 컨텍스트 엔지니어링이라는 개념이 떠오르고 있습니다. 많은 사람들이 이것을 최신 에이전트 시대의 산물로 생각하곤 하는데, 실은 20년 이상의 역사를 가진 분야입니다. 이 논문의 핵심 통찰은 바로 여기에 있습니다.기계가 인간의 의도를 이해하려면, 결국 정보 엔트로피를 줄여야 한다는 것이죠.

-

최신 멀티모달 모델의 화두는 세계를 이해하고 행동하는 모델입니다. BAAI(Beijing Academy of Artificial Intelligence)가 최근 공개한 Emu3.5는 이런 흐름을 타고 비전과 언어를 동시에 예측하는 '멀티모달 월드 모델'을 표방하며 장시간 순차적 추론과 실제 로봇 조작까지 가능하게 한다고 주장합니다.

-

-

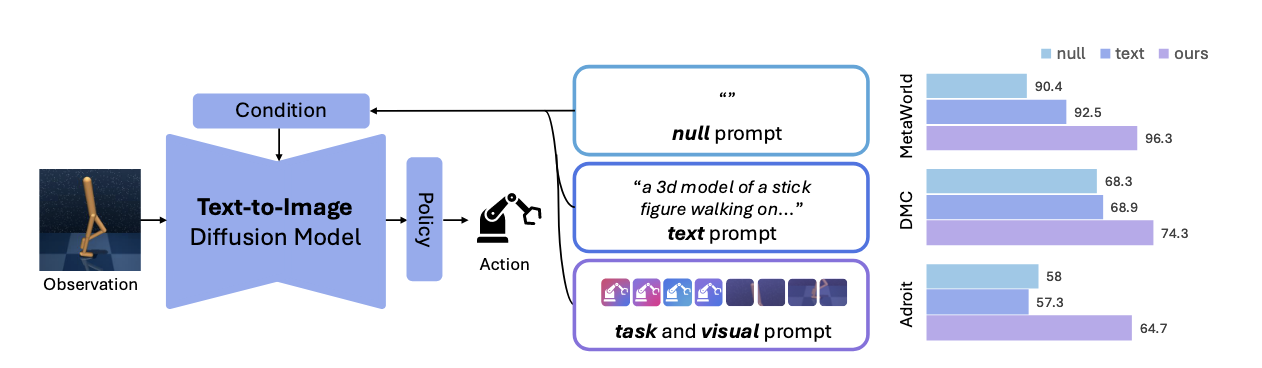

이번에는 네이버에서 제안한 논문을 들고왔습니다. 팔이 또 안으로 굽는다고, 저는 우리나라 논문을 보면 이렇게 가져오고싶네요. 확산 모델의 조건화를 로보틱스 분야에 적용하고 도메인 갭을 메우는 흥미로운 내용입니다.

-

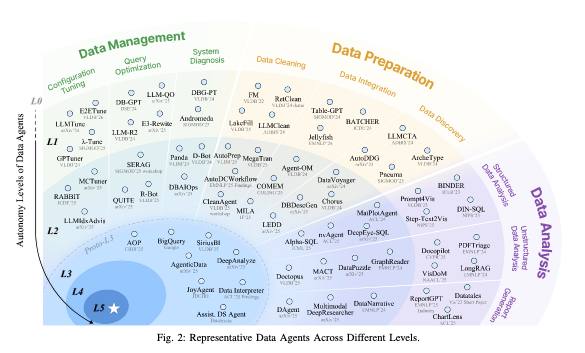

현재 시장에는 "단순 쿼리 응답 도구"부터 "엔드-투-엔드 자동 분석 시스템"까지 모두 "데이터 에이전트"라고 불리고 있습니다. 이 논문은 자동주행 기술의 레벨 분류처럼, 데이터 에이전트의 자율성을 6단계로 명확히 정의합니다.

-

|-

-

The Free Transformer 2025-10-27

The Free Transformer 2025-10-27|-

-

A Definition of AGI 2025-10-27

A Definition of AGI 2025-10-27|-

-

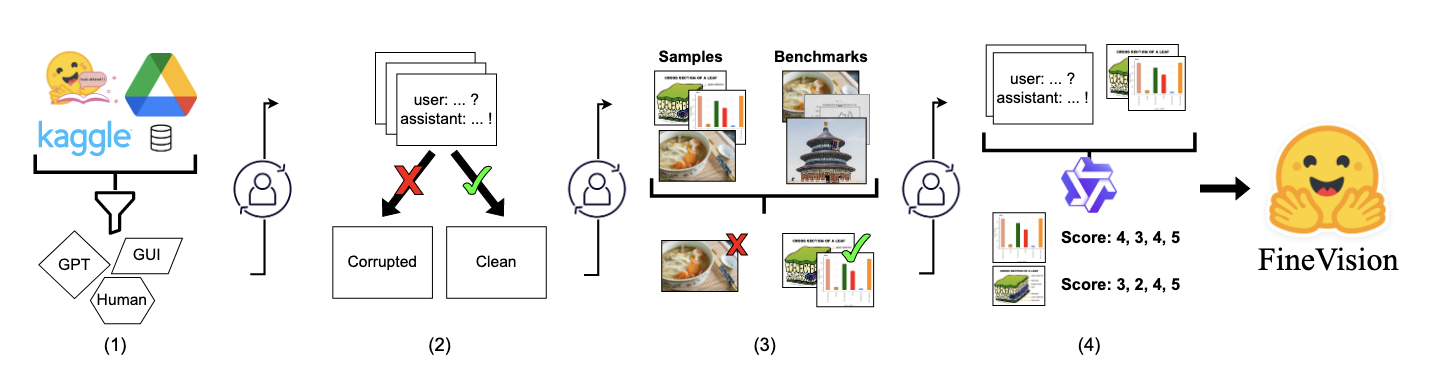

FineVision Open Data Is All You Need 2025-10-25

FineVision Open Data Is All You Need 2025-10-25인공지능 연구에서 가장 중요한 것은 데이터! 두 말하면 입아픈 이야기입니다. 최대 규모의 AI 플랫폼, 이제는 연구 커뮤니티의 역할을 톡톡히 하는 허깅페이스에서 최대 규모의 오픈 데이터 리소스를 발표했습니다. 오염이 심한 공개 데이터셋에서 세심하게 큐레이션해 2,400만 샘플 데이터셋을 통합하여 품질을 끌어올렸습니다. 기존 오픈 데이터셋 대비최대 46%의 벤치마크 성능 향상을 보입니다.

-

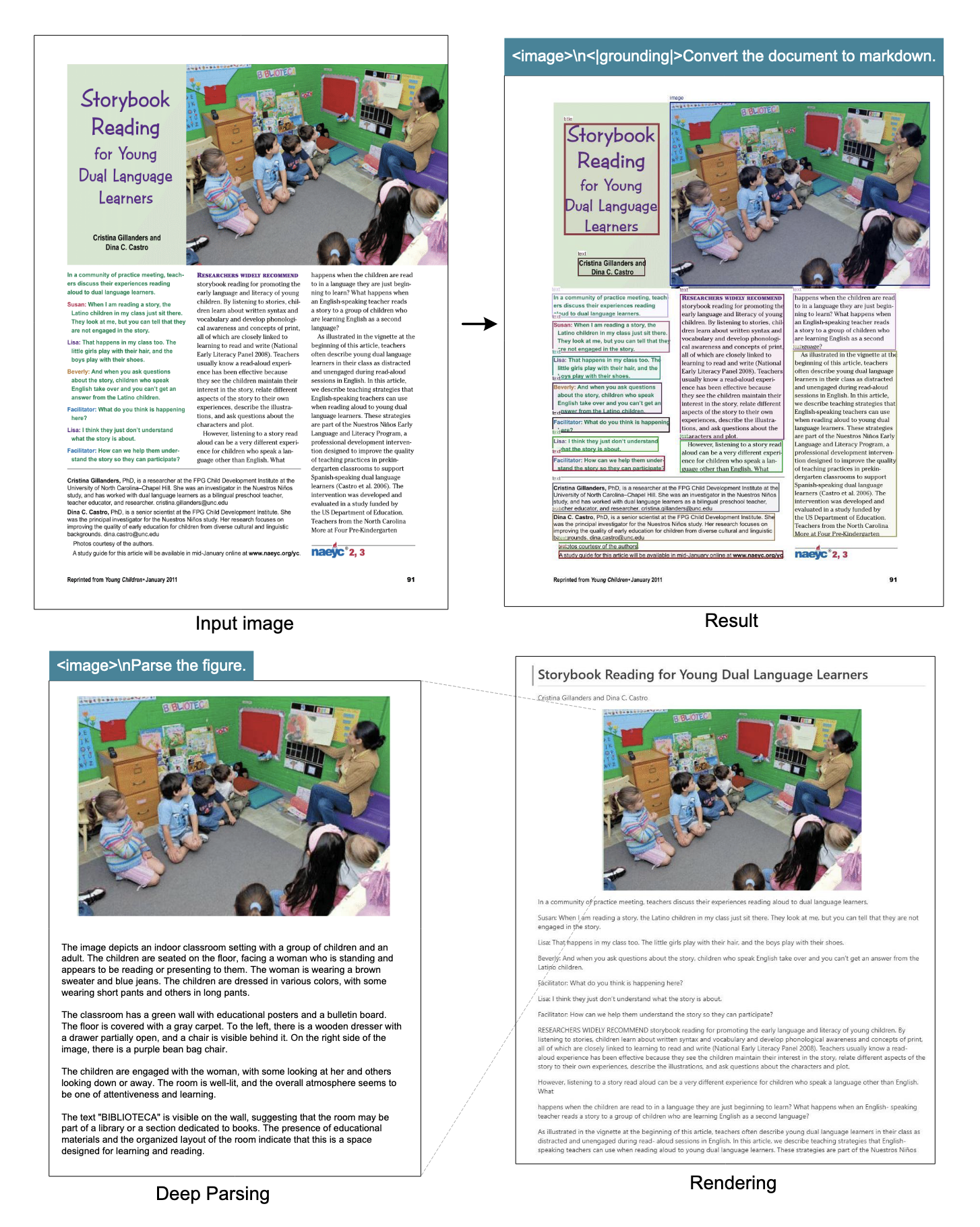

DeepSeek-OCR Contexts Optical Compression 2025-10-24

DeepSeek-OCR Contexts Optical Compression 2025-10-24|-

-

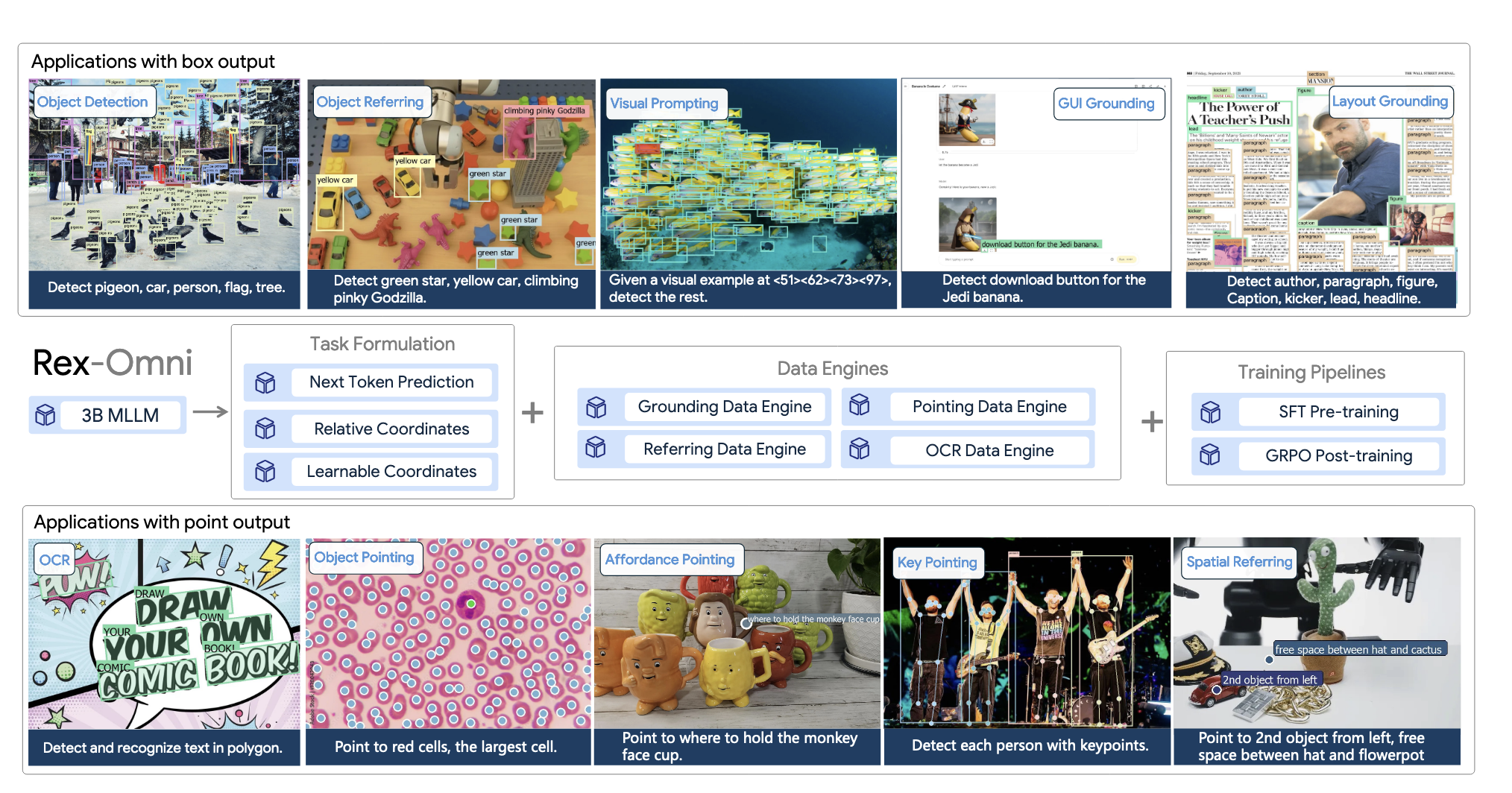

Detect Anything via Next Point Prediction 2025-10-22

Detect Anything via Next Point Prediction 2025-10-22|-

-

Dragon Hatchling(BDH)은 트랜스포머와 뇌 모델 사이의 연결고리를 찾습니다. 생물학적으로 그럴듯한 그래프 기반 뉴런 네트워크로 설계되어, 헤비안 학습과 스파이킹 뉴런을 사용하면서도 GPT-2 수준의 성능을 달성했습니다. 핵심은 attention을 시냅스 가소성으로, feed-forward를 국소적 그래프 동역학으로 재해석한 것입니다.

-

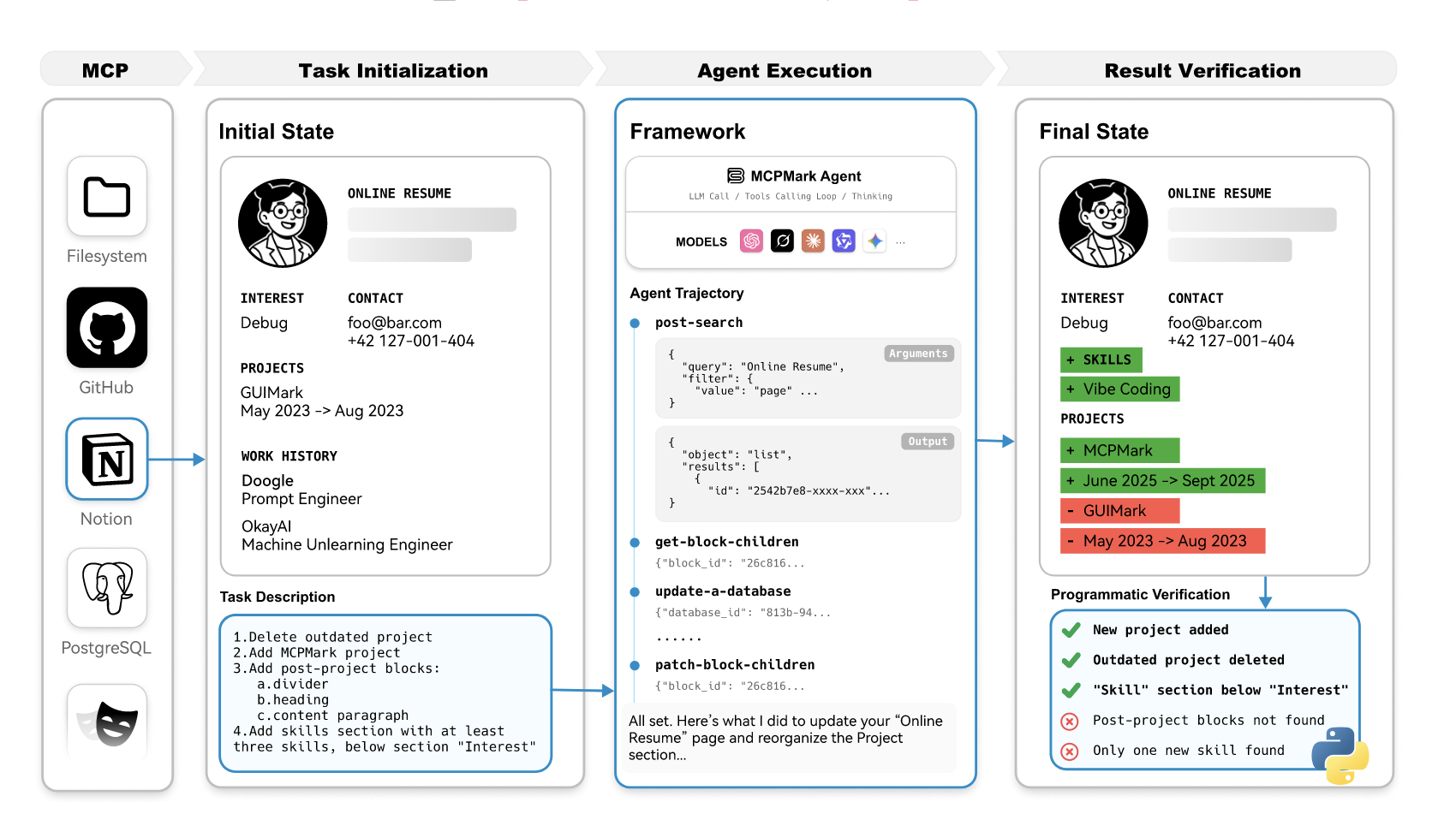

여러분은 MCP를 자주 활용하나요? 저는 매일 사용해서 없으면 안 될 수준입니다. 가끔은 내가 필요한 MCP를 직접 만들고 싶은 때도 있죠. 그렇다면 실제로 MCP가 얼마나 유용한지, 어떤 MCP 서버가 좋은 MCP 서버인지 구별하려면 어떤 기준을 세우면 좋을까요? 이번 논문은 MCP가 실제 업무의 복잡성을 평가하는 벤치마크를 제안하고 MCP 활용 능력을 종합적으로 평가합니다.

-

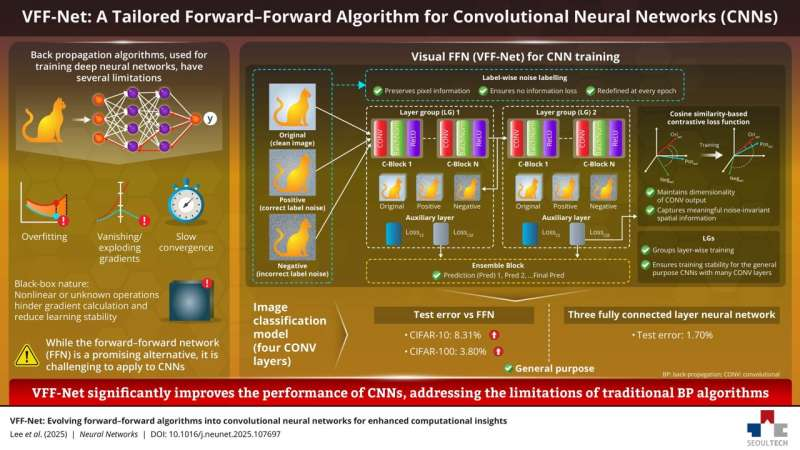

서울과학기술대학의 VFF-Net을 소개합니다. 딥러닝은 역전파라는 방식으로 학습하는 것이 기본입니다. 역전파 알고리즘을 제안한 제프리 힌턴은 딥러닝 대부로 불리며 모든 현대 AI의 기초를 마련한 인물입니다. 제프리 힌턴은 역전파가 아닌 새로운 학습 알고리즘을 2022년에 발표했습니다. 이것이 FFN인데요, 실제 학습에 적용하기에는 복잡한 네트워크에 잘 맞지 않고, 특히 CNN과 어울리지 않았습니다. 이 문제를 한국에서 해결합니다. 방대한 계산량이 필요한 역전파 대신 FFN의 성능을 끌어올려 실제로 사용할 수 있는 알고리즘으로 만든 것입니다.

-

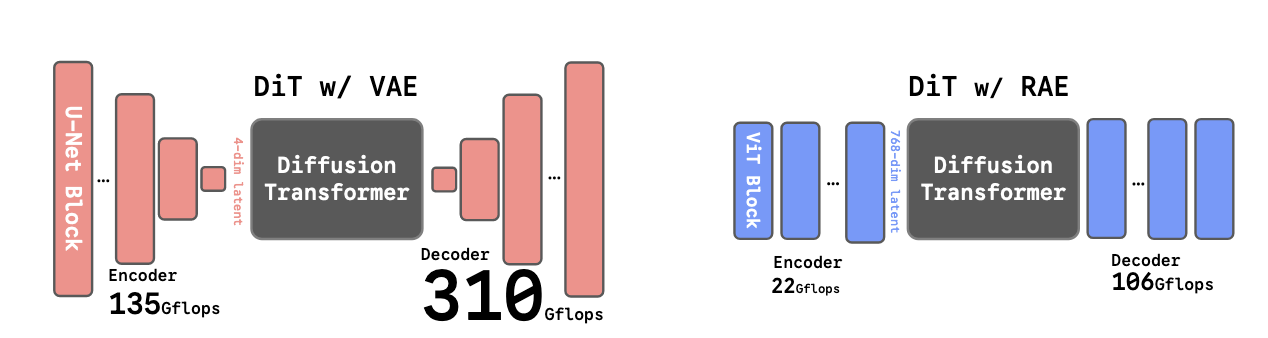

최근 이미지 생성 분야에서 Diffusion Transformer(DiT)는 픽셀 공간이 아닌 사전 학습된 오토인코더가 만든 잠재 공간(latent space)에서 확산 과정을 수행하는 것이 표준이 되었습니다. 하지만 대부분의 DiT는 여전히 원래의 VAE 인코더에 의존하고 있고, 이는 몇 가지 한계를 가지고 있습니다. 이 논문은 VAE를 사전 학습된 표현 인코더(DINO, SigLIP, MAE 등)와 학습된 디코더로 구성된 Representation Autoencoder(RAE)로 대체하는 새로운 접근을 제안합니다.

-

LLM의 성능 향상을 위해 강화 학습을 흔히 사용하죠. 강화 학습 훈련을 위해서는 높은 학습 비용이 필요합니다. 이 논문은 훈련 없이 프롬프트만으로 훈련 없이 강화 학습 정책을 변경합니다.

-

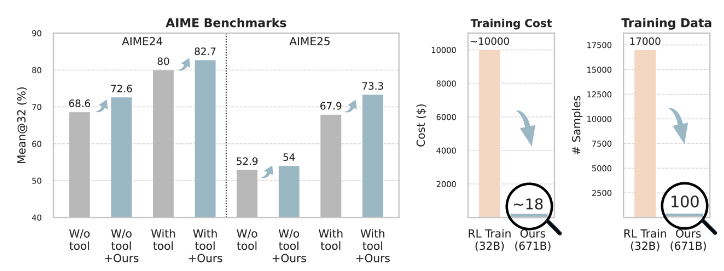

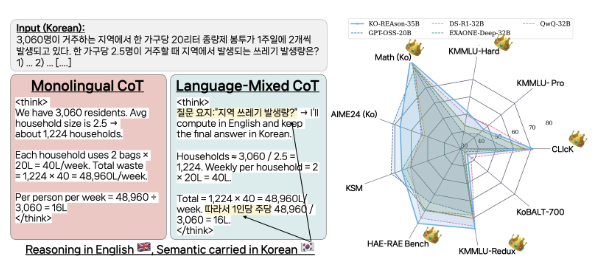

우리에게 익숙한 많은 언어 모델은 영어 중심입니다. 저처럼 글을 많이 쓰는 분이라면 언어 모델의 한국어 처리 결과를 그대로 어디에 내놓을 수 없다는 아쉬움을 공감하시리라 생각합니다. 다국어 추론 모델의 한국어 성능을 높이려면 어떻게 해야 할까요? 한글날을 맞아 우리의 멋진 연구자들이 새로이 발표한 한국어 추론 모델과 데이터셋을 소개합니다.

-

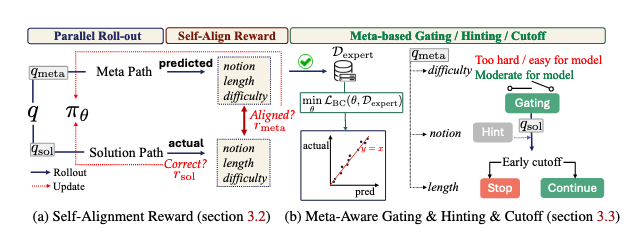

대한민국 KAIST에서 제안하는 추론 모델의 메타 인지(meta-awareness) 능력 향상 방법입니다. 이 논문은 모델이 예측한 메타 정보와 실제 추론 과정 사이의 정렬(alignment)을 통해 메타 인지 능력을 향상시키는 MASA(Meta-Awareness via Self-Alignment) 프레임워크를 제안합니다. Qwen3를 기반으로 외부 소스 없이 메타 인지를 학습합니다.

-

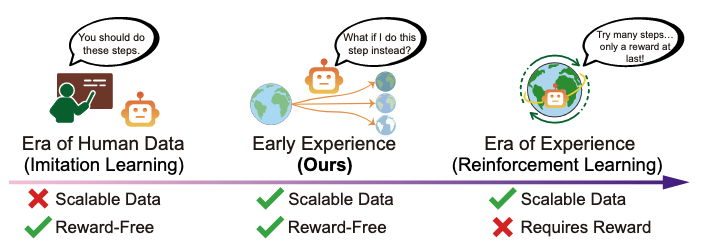

Agent Learning via Early Experience 2025-10-12

Agent Learning via Early Experience 2025-10-12스스로 학습하고 발전하는 인공지능을 위한 새로운 학습 패러다임, 초기 경험(Early Experience)을 제안합니다. 보상 신호 없이도 에이전트가 자신의 행동으로 생성된 미래 상태를 학습 신호로 활용할 수 있습니다. 이제 인공지능이 정답만 보고 배우는 게 아니라 직접 시도한 경험으로 학습한다는 겁니다.

-

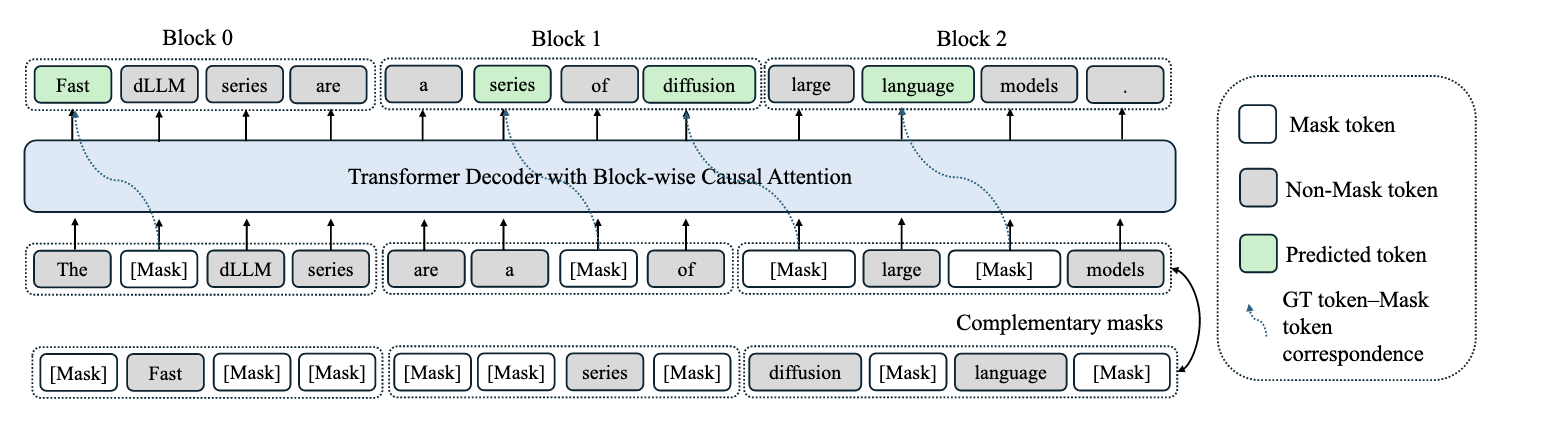

FAST-DLLM V2 Efficient Block-Diffusion LLM 2025-10-09

FAST-DLLM V2 Efficient Block-Diffusion LLM 2025-10-09NVIDIA의 힘은 GPU가 다가 아니죠. 명실상부 LLM 선두주자의 새로운 논문입니다. 자연어 처리 모델이 토큰을 생성하는 기본적인 방법인 자기회귀(AR)의 한계를 극복하는 병렬 텍스트 생성 모델입니다. 적은 토큰으로도 파인 튜닝이 가능하고 500배 적은 학습 데이터로 기존 Dream 모델과 동일한 성능을 달성합니다.

-

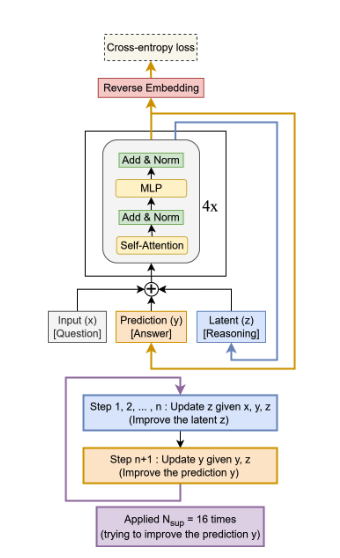

삼성에서 한 건 했습니다. LLM 추론 방식에 대한 근본적인 의문을 제시하고 Claude 3.7, GPT의 o3-mini, Gemini 2.5 Pro, Deepseek R1을 능가하는 추론 성능을 달성합니다. 심지어 0.01%에 불과한 파라미터로 말이죠. 삼성 SAIL AI 연구소가 제안한 TRM을 소개합니다.

-

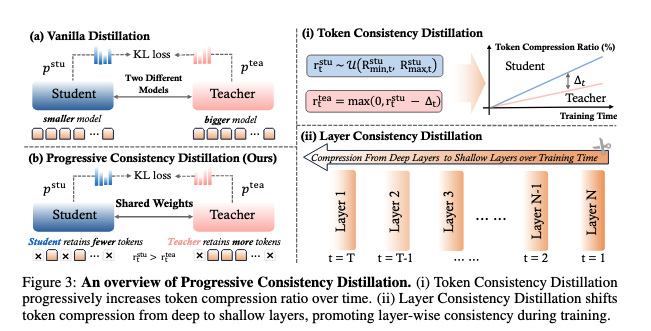

더 효율적인 멀티모달 LLM을 위한 다양한 시도가 이어집니다. 이미지와 텍스트를 동시에 다루는 모델은 이미지 처리에서 계산 비용이 많이 들어갑니다. 이 문제를 해결하기 위해 시각 토큰을 압축하는 방법이 중요합니다. 효율적인 시각 토큰 압축을 위한 학습 프레임워크를 제안한 논문을 소개합니다.

-

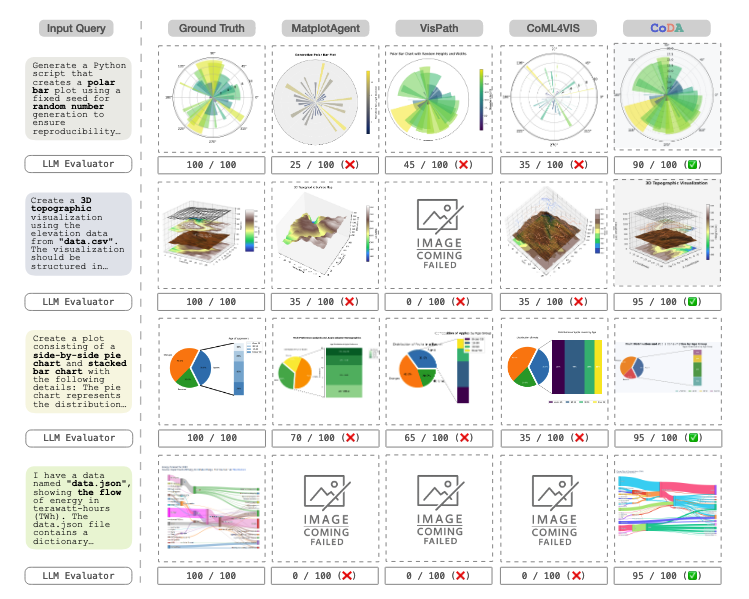

저는 예전부터 데이터 시각화가 어려웠습니다. 함수 이름이랑 파라미터도 잘 안 외워지고 어떤 그래프가 가장 효과적인가 판단하는 것이 쉽지 않습니다. 구글에서 시각화 시스템을 제안한 논문을 발표한 것은 굉장히 재밌습니다. 아마 Opal과 관련이 있지 않을까요?

-

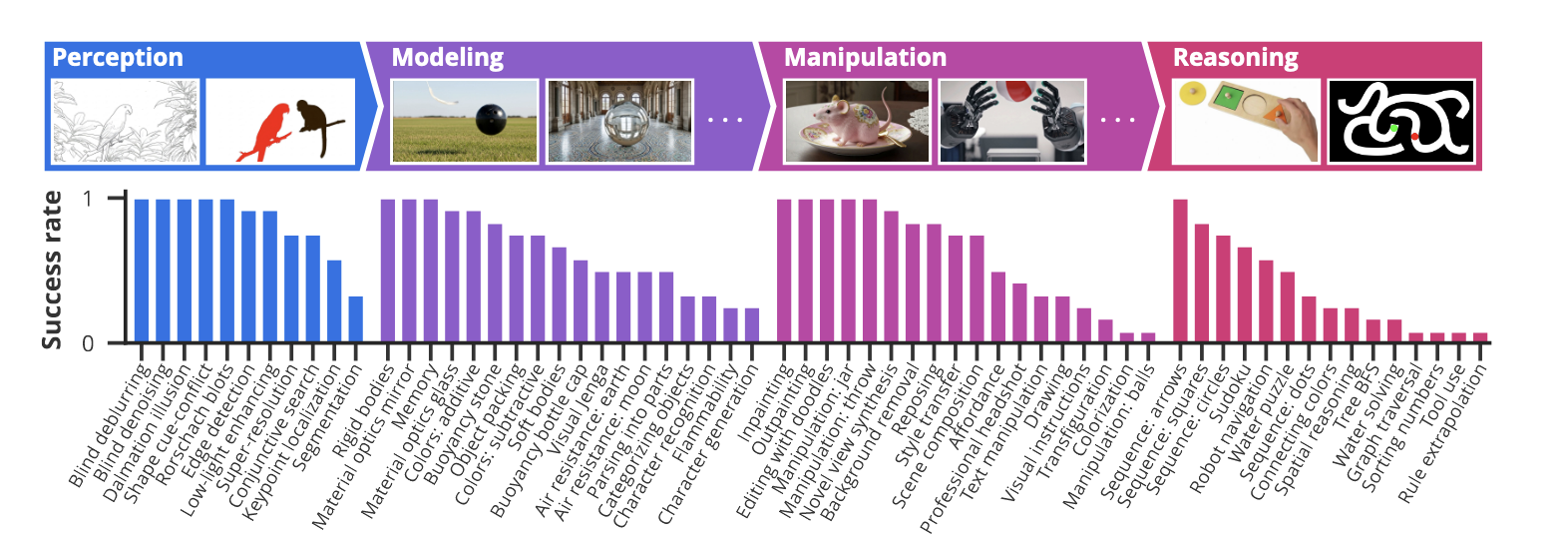

자연어 처리가 변화한 이유가 대규모 언어 모델이라면 컴퓨터 비전이 변화한 이유는 비디오 모델입니다. 믿고 보는 Google DeepMind의 최신 비디오 모델 연구 논문입니다. Veo 3가 명시적으로 학습하지 않은 다양한 시각적 작업을 제로샷 방식으로 해결할 수 있다고 제안합니다.

-

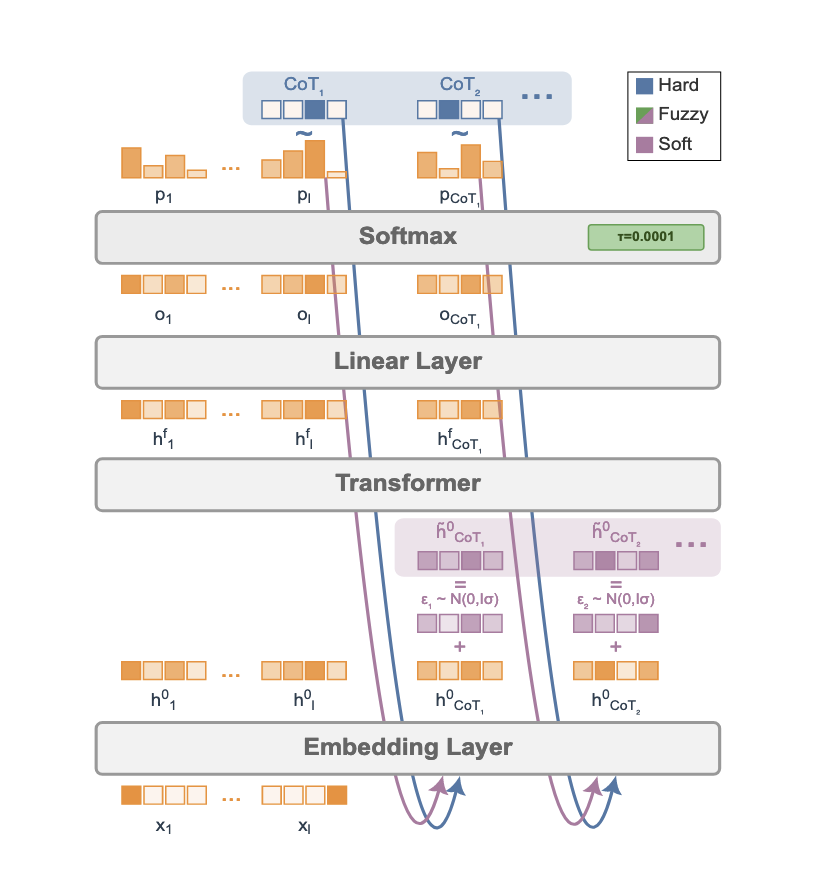

Soft Tokens, Hard Truths 2025-09-23

Soft Tokens, Hard Truths 2025-09-23대형 언어 모델(LLM)의 추론 능력은 Chain-of-Thought(CoT) 기법을 통해 크게 향상되었지만, 기존의 discrete token 기반 접근법은 여러 추론 경로를 동시에 탐색하는 데 한계가 있습니다. 이러한 한계를 극복하기 위해 continuous token을 사용한 새로운 강화학습 기반 훈련 방법을 제안합니다.

-

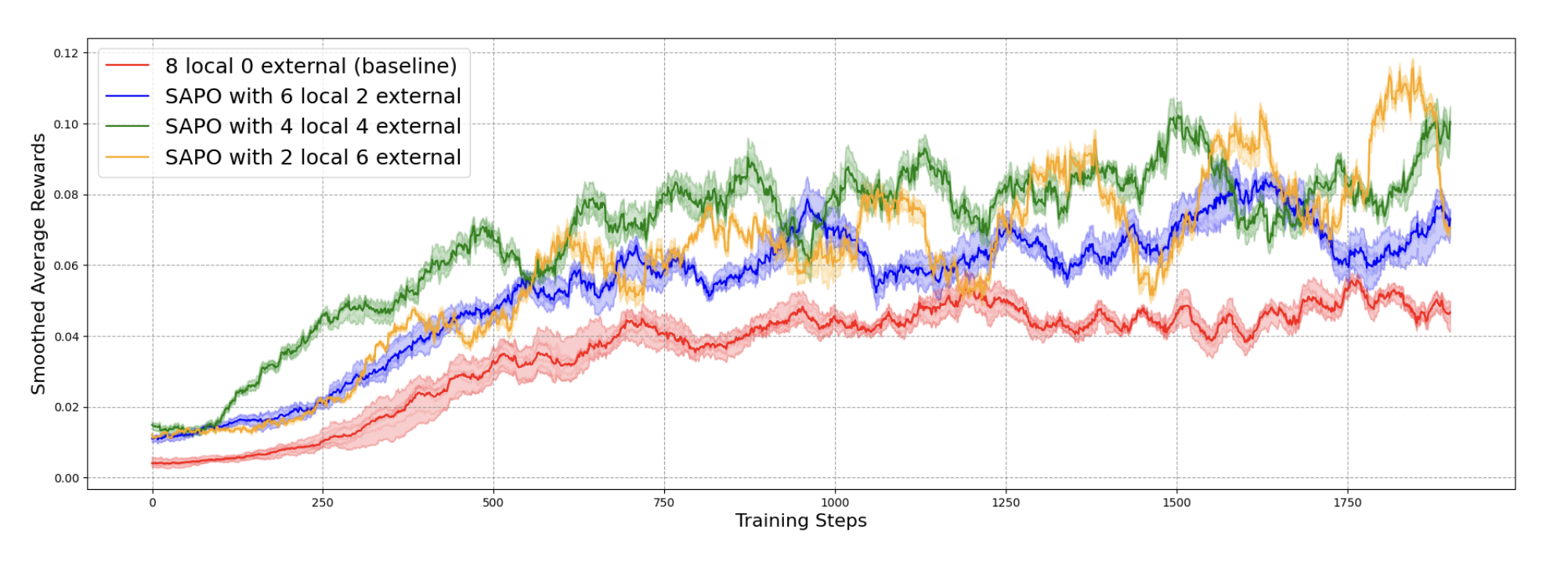

Gensyn AI의 SAPO 논문을 요약합니다. 분산된 노드들이 각자 생성한 경험을 공유하며 언어모델을 집단적으로 훈련하는 비동기 강화학습 후훈련 알고리즘을 설명합니다. 중앙 서버 없이 효율적인 협력 훈련이 가능한 원리와 그 효과를 다룹니다.

-

Why Language Models Hallucinate 2025-09-17

Why Language Models Hallucinate 2025-09-17언어 모델의 환각(Hallucination) 현상을 통계적 관점에서 분석한 논문을 요약합니다. 환각이 사전훈련의 필연적 결과이며, '모르겠다'를 처벌하는 현재의 평가 방식 때문에 사후훈련 후에도 지속되는 구조적 문제를 지적하고 해결책을 제시합니다.

-

텐센트의 Hunyuan3D Studio 논문을 요약합니다. 단일 이미지나 텍스트에서 게임 엔진에 바로 사용할 수 있는 3D 에셋을 생성하는 7단계 AI 파이프라인을 설명합니다. 지오메트리 생성, UV 언래핑, 텍스처링, 애니메이션까지 전 과정을 자동화한 기술을 다룹니다.

-

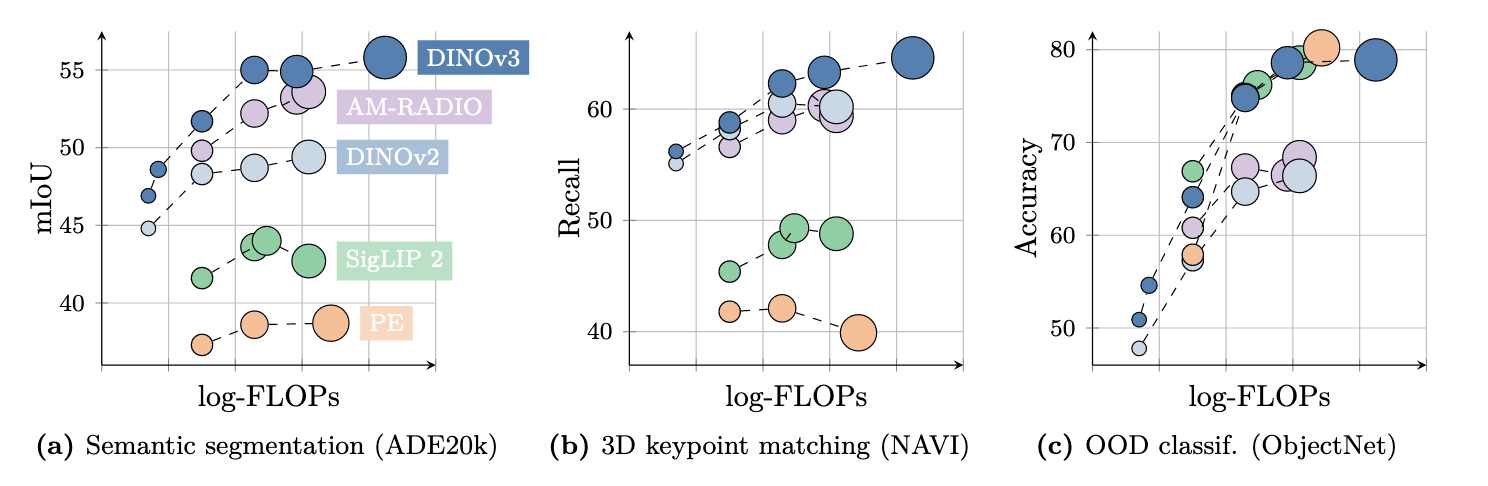

DINOv3 2025-09-15

DINOv3 2025-09-15Meta AI의 70억 파라미터 자기지도학습 모델 DINOv3 논문을 요약합니다. 라벨 없이 이미지 특징을 학습하는 이 모델의 거대한 아키텍처, 데이터 큐레이션 전략, 그리고 패치 일관성을 유지하는 혁신 기술 'Gram Anchoring'을 중심으로 설명합니다.

-

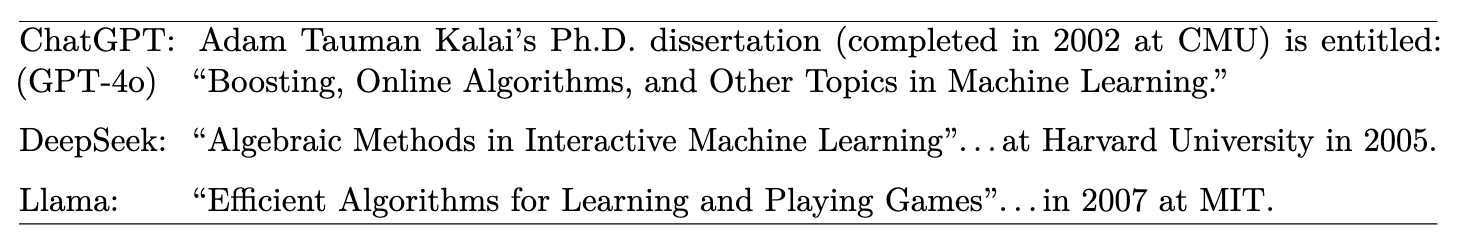

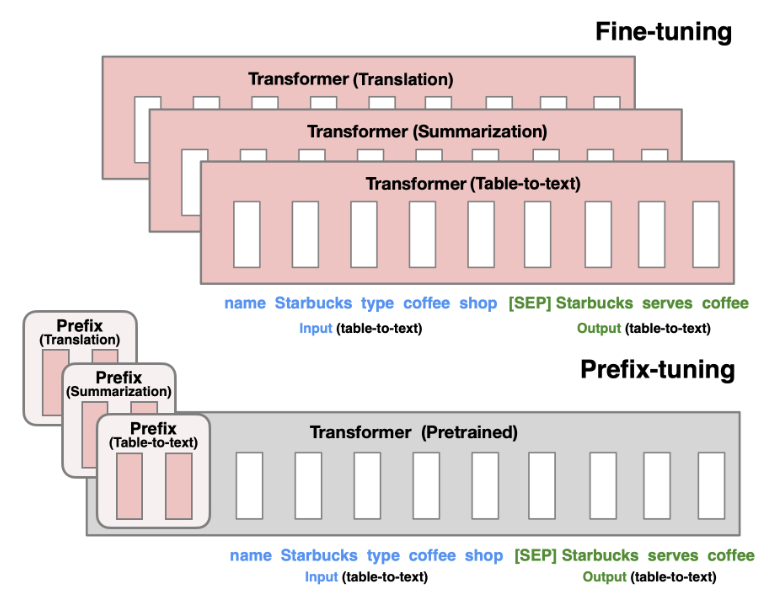

Prefix-Tuning 논문을 요약하며, 대형 언어모델의 파라미터를 고정한 채 작은 연속적 프롬프트(prefix)만 최적화하는 효율적인 튜닝 방법을 설명합니다. 전체 파인튜닝 대비 적은 파라미터로 경쟁력 있는 성능을 내는 원리와 장점을 다룹니다.

-

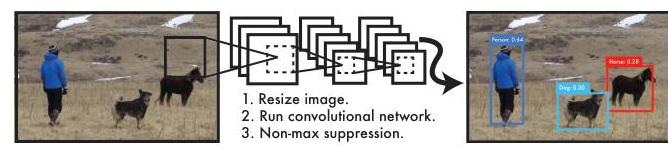

실시간 객체 탐지의 시대를 연 YOLO(You Only Look Once) 논문을 요약합니다. 전체 이미지를 단일 신경망에 한 번만 통과시켜 객체의 경계 상자와 클래스를 동시에 예측하는 혁신적인 통합 아키텍처의 원리와 성능을 설명합니다.

-

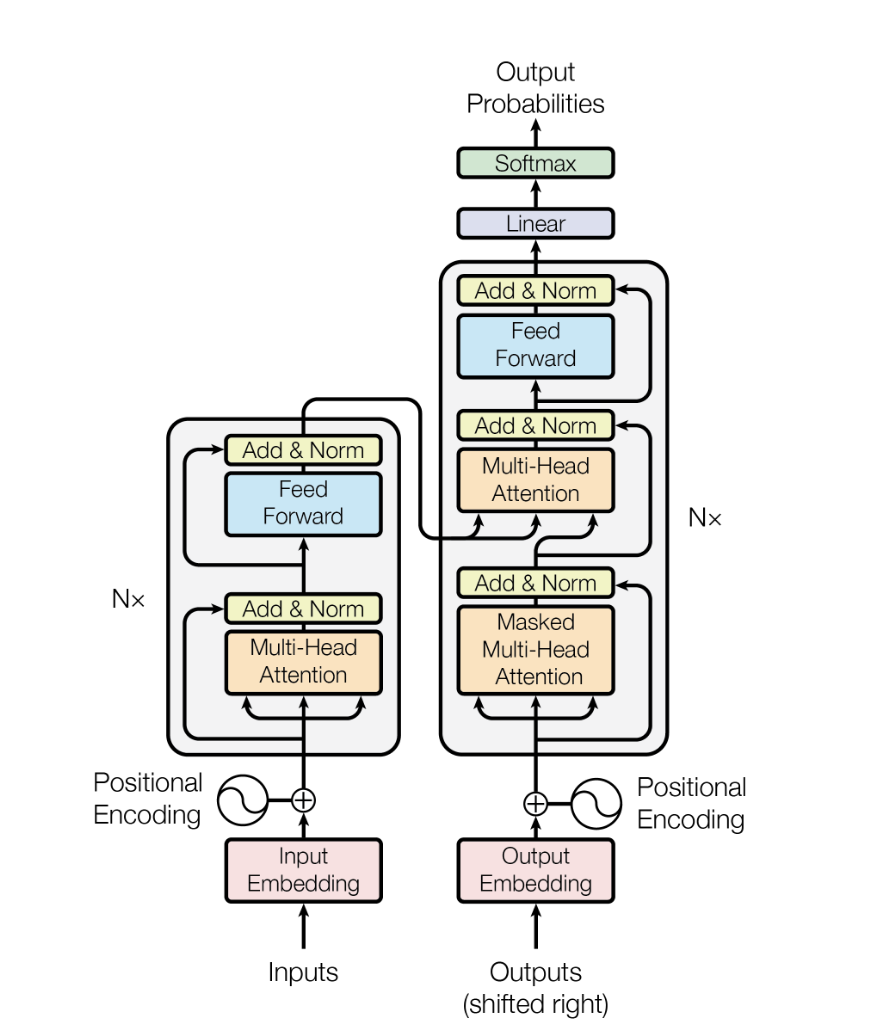

Attention Is All You Needs 2025-09-01

Attention Is All You Needs 2025-09-01'Attention Is All You Need' 논문을 요약하며 RNN의 한계를 극복한 트랜스포머 아키텍처를 설명합니다. Multi-Head Self-Attention을 중심으로 순환 구조를 완전히 배제하고 병렬 처리를 가능하게 한 혁신적인 모델의 구조와 원리를 다룹니다.

-

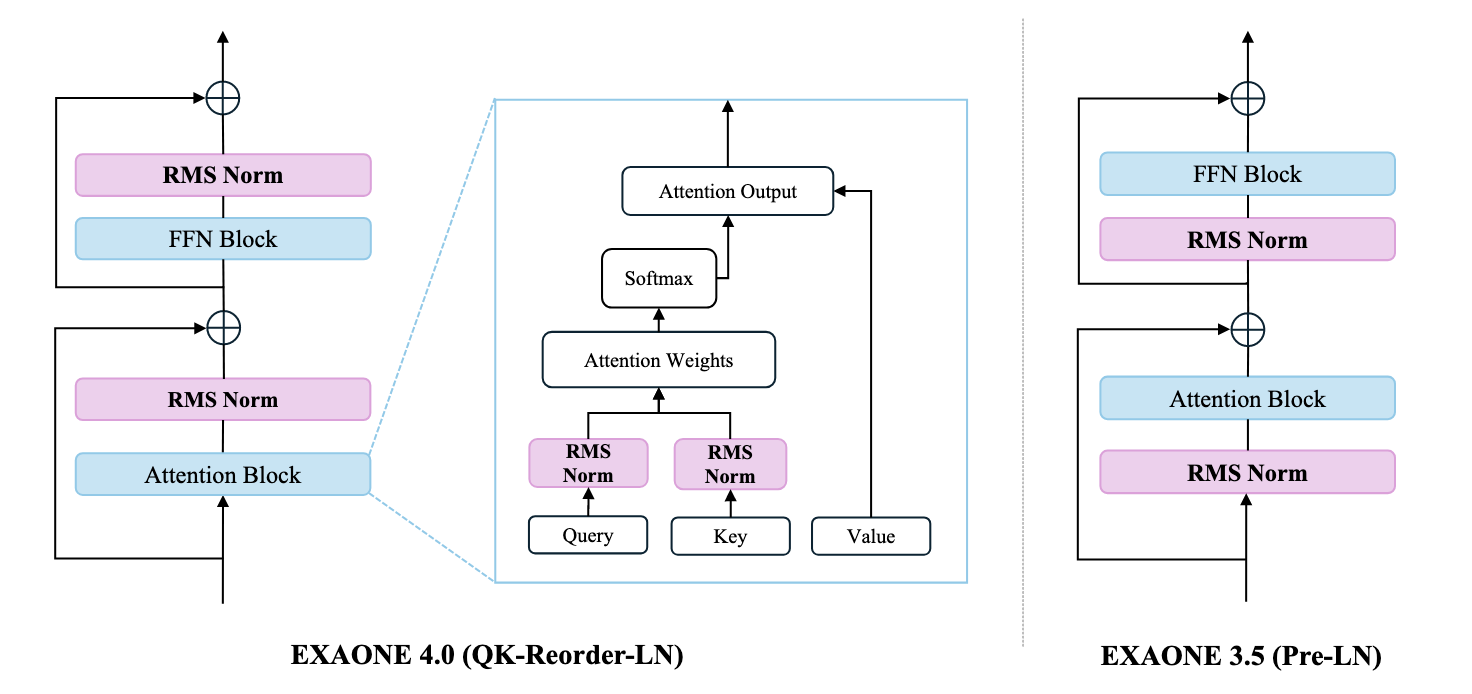

LG AI Research의 EXAONE 4.0 논문을 요약합니다. 빠른 응답의 'Non-reasoning' 모드와 깊은 사고의 'Reasoning' 모드를 통합한 하이브리드 아키텍처가 특징입니다. 모델 구조, 훈련 데이터, 혁신적인 AGAPO 강화학습 알고리즘을 중심으로 설명합니다.

-

군중 상황에서 정확한 다중 사람의 자세 인식을 위한 군중 자세 주석 데이터 세트 2025-04-05

군중 상황에서 정확한 다중 사람의 자세 인식을 위한 군중 자세 주석 데이터 세트 2025-04-05군중 상황에서의 객체 탐지와 포즈 추정의 어려움을 다룹니다. CrowdPose 데이터셋과 Crowd Index를 분석하고, 객체 수까지 고려한 새로운 데이터셋 'HuPoAnt'와 전용 라벨링 도구를 개발한 경험과 추후 연구 방향을 공유합니다.