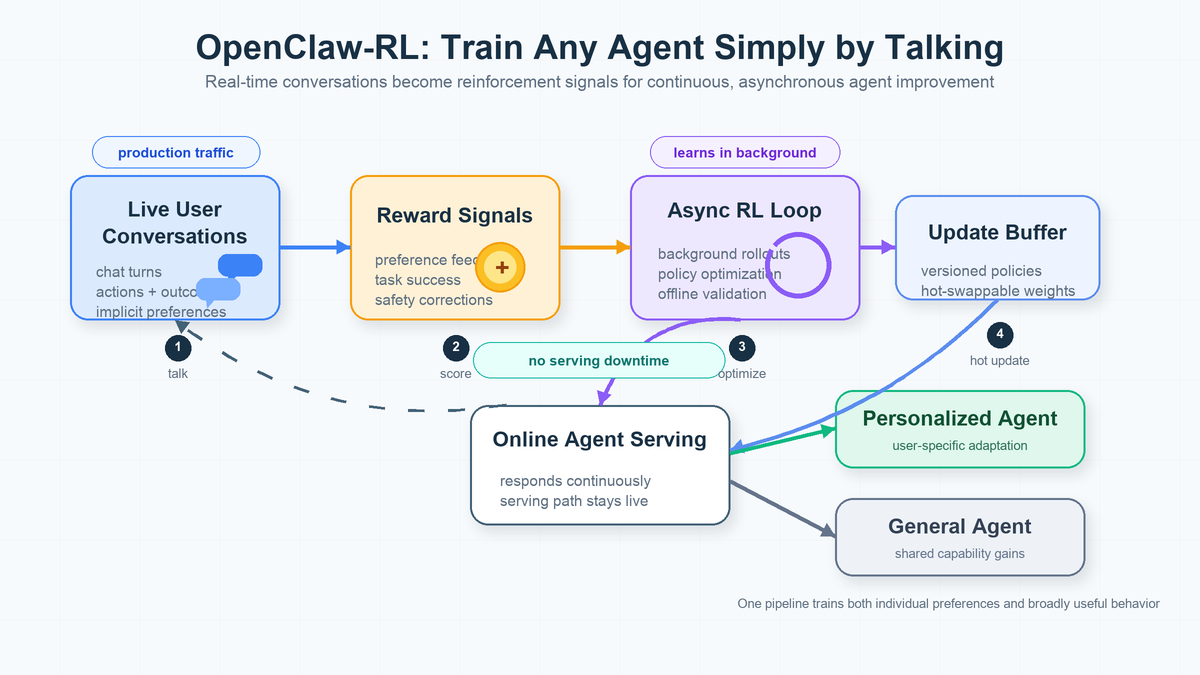

실시간 대화를 강화학습 신호로 전환하는 비동기 RL 프레임워크. 서빙 중단 없이 에이전트를 지속 개선하며, 개인화와 범용 에이전트를 하나의 파이프라인으로 훈련.

태그: 베스트논문

7개의 게시물

-

-

Deep Delta Learning 2026-01-06

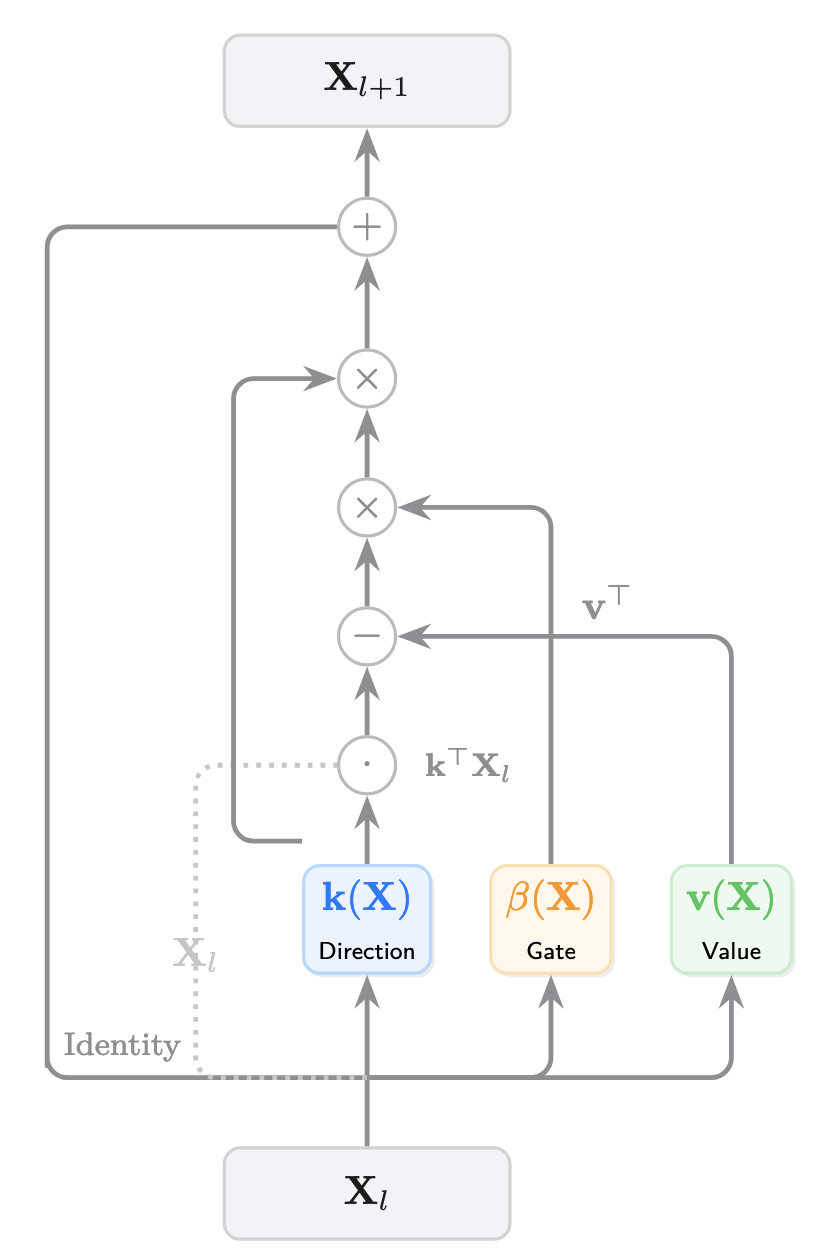

Deep Delta Learning 2026-01-06심층 신경망의 학습 안정성을 책임지는 ResNet의 identity shortcut connection은 사실 너무 단순하다는 문제가 있습니다. 입력에 residual을 더하는 방식은 기울기 소실 문제는 해결했지만, 네트워크가 복잡한 상태 전이를 표현하는 데는 한계가 있었죠. 새로운 논문 Deep Delta Learning(DDL)은 이 shortcut 연결에 학습 가능한 기하학적 변환을 추가합니다. 네트워크는 층마다 그냥 넘어갈지, 특정 방향의 정보를 지울지, 완전히 반사시킬지 스스로 결정합니다.

-

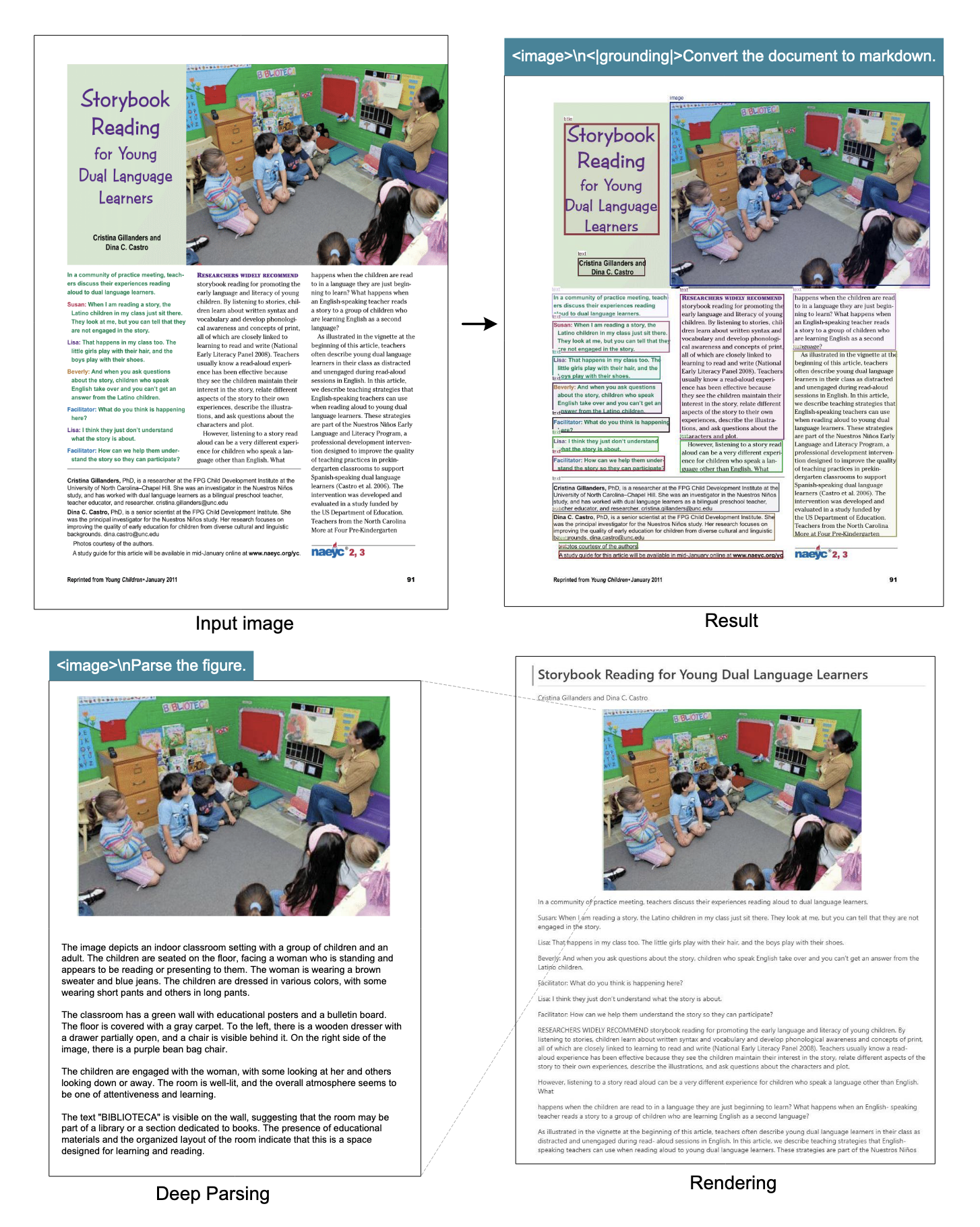

DeepSeek-OCR Contexts Optical Compression 2025-10-24

DeepSeek-OCR Contexts Optical Compression 2025-10-24|-

-

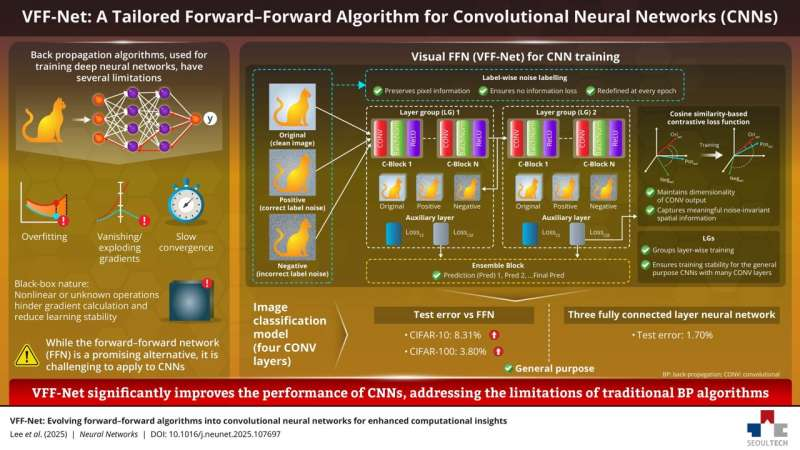

서울과학기술대학의 VFF-Net을 소개합니다. 딥러닝은 역전파라는 방식으로 학습하는 것이 기본입니다. 역전파 알고리즘을 제안한 제프리 힌턴은 딥러닝 대부로 불리며 모든 현대 AI의 기초를 마련한 인물입니다. 제프리 힌턴은 역전파가 아닌 새로운 학습 알고리즘을 2022년에 발표했습니다. 이것이 FFN인데요, 실제 학습에 적용하기에는 복잡한 네트워크에 잘 맞지 않고, 특히 CNN과 어울리지 않았습니다. 이 문제를 한국에서 해결합니다. 방대한 계산량이 필요한 역전파 대신 FFN의 성능을 끌어올려 실제로 사용할 수 있는 알고리즘으로 만든 것입니다.

-

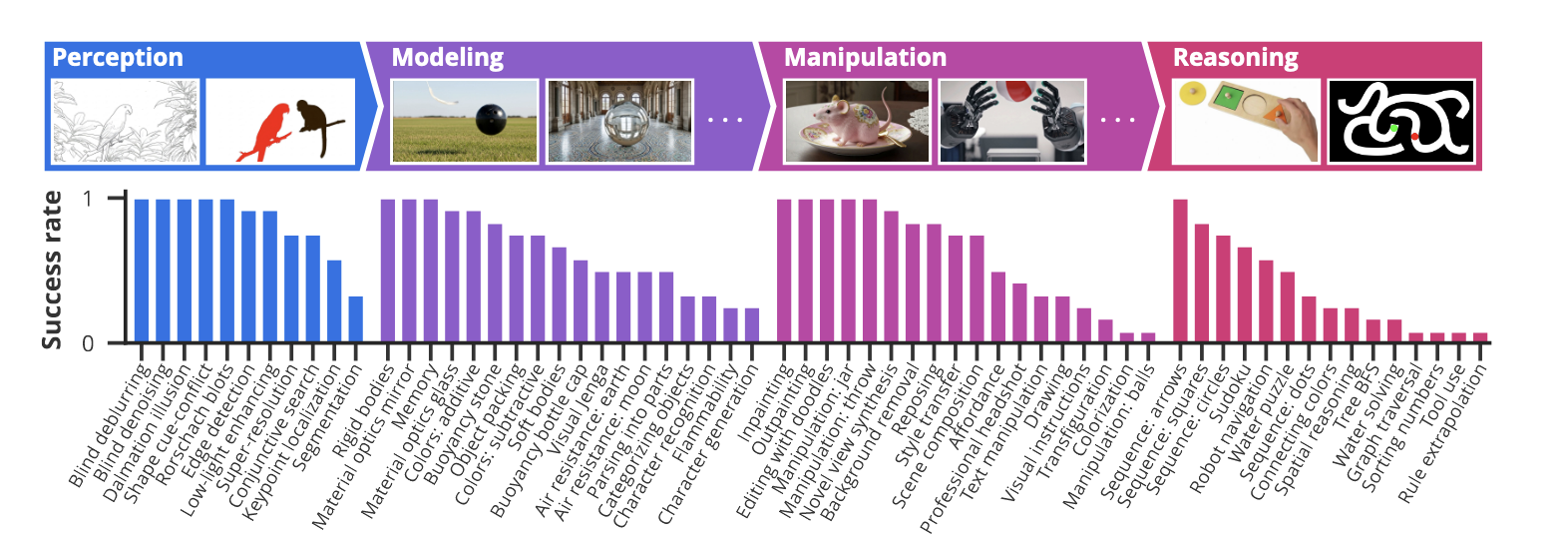

자연어 처리가 변화한 이유가 대규모 언어 모델이라면 컴퓨터 비전이 변화한 이유는 비디오 모델입니다. 믿고 보는 Google DeepMind의 최신 비디오 모델 연구 논문입니다. Veo 3가 명시적으로 학습하지 않은 다양한 시각적 작업을 제로샷 방식으로 해결할 수 있다고 제안합니다.

-

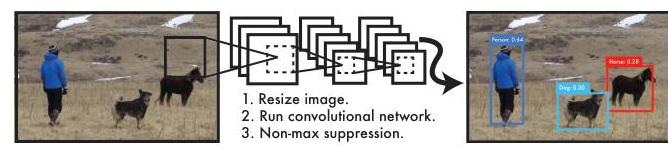

실시간 객체 탐지의 시대를 연 YOLO(You Only Look Once) 논문을 요약합니다. 전체 이미지를 단일 신경망에 한 번만 통과시켜 객체의 경계 상자와 클래스를 동시에 예측하는 혁신적인 통합 아키텍처의 원리와 성능을 설명합니다.

-

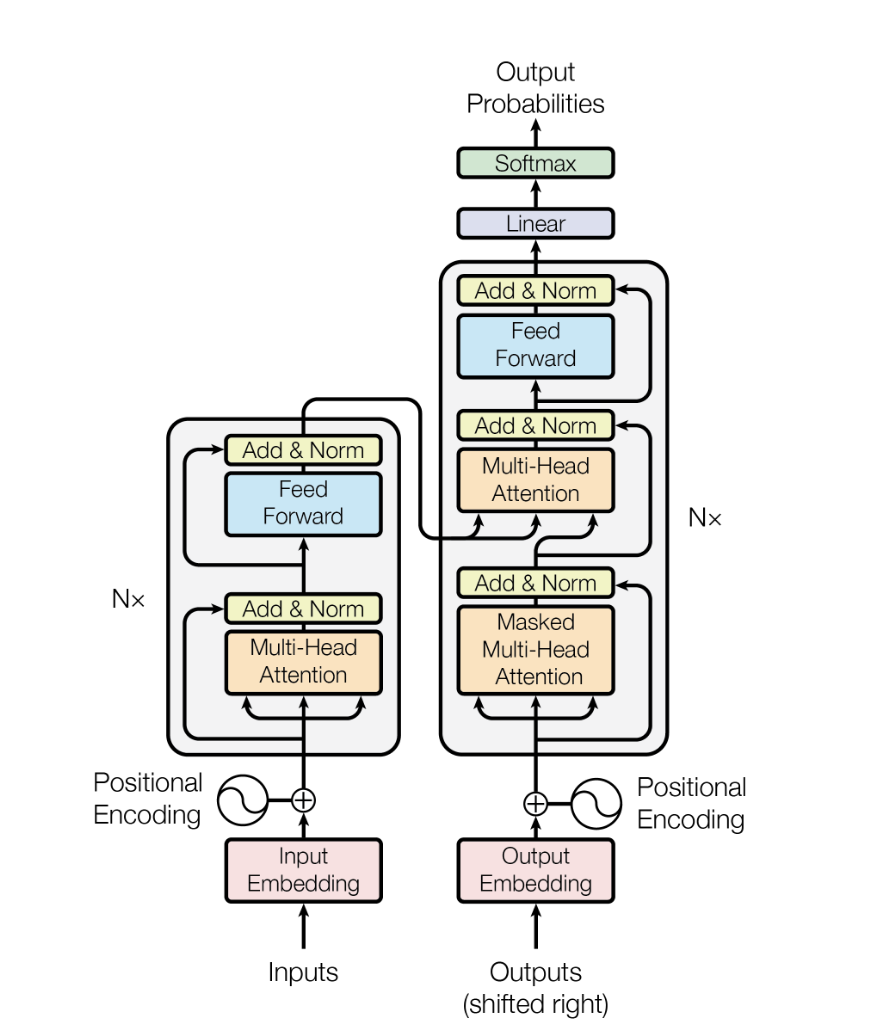

Attention Is All You Needs 2025-09-01

Attention Is All You Needs 2025-09-01'Attention Is All You Need' 논문을 요약하며 RNN의 한계를 극복한 트랜스포머 아키텍처를 설명합니다. Multi-Head Self-Attention을 중심으로 순환 구조를 완전히 배제하고 병렬 처리를 가능하게 한 혁신적인 모델의 구조와 원리를 다룹니다.