Apple이 Google과 함께 만든 모델로 Siri를 재구축하고, Foundation Models의 LanguageModel 프로토콜과 Core AI로 개발자가 앱에 Gemini·Claude·오픈 모델을 붙이게 연 WWDC 2026 키노트를 공식 발표와 보도를 구분해 정리합니다

차진우

컴퓨터 정보학을 전공하고 딥러닝 영상처리를 연구했습니다. 지금은 LLM의 실무 적용과 AX를 공부하고 연구합니다. 경험을 공유하기 위해 글을 쓰고 책을 만듭니다.

주인장은 기술 동향과 인공지능에 관심이 많은 IT 애호가입니다. 개발자도, 전문가도 아니기 때문에 틀린 내용이 있을 수 있습니다. 콘텐츠에 대한 의견과 피드백을 환영합니다.

*도서가 출간되었습니다! 《바로바로 클로드 with 코워크, 스킬, 클로드 코드, 디자인》 *

- 교보문고 : https://product.kyobobook.co.kr/detail/S000219916961

- 예스24 : https://www.yes24.com/product/goods/189114943

- 알라딘 : https://www.aladin.co.kr/shop/wproduct.aspx?ItemId=392438623

Channel

골든래빗은 더 탁월한 가치를 제공하는 콘텐츠 프로덕션 & 프로바이더 입니다. 골든래빗은 취미, 경제, 수험서, 만화, IT 등 다양한 분야에서 책을 제작하고 있습니다. 골든래빗 홈페이지로 놀러오세요!

개발자를 위한 커뮤니티를 운영중입니다!

최신 업계 동향과 취업 정보를 제공합니다!

다른 현업 개발자와 소통하세요!

Contect

- Email : chajinwoo.chajinwoo@gmail.com

출판 관련 문의는 아래 메일로 보내주세요!

- Company Email : jwcha@goldenrabbit.co.kr

Links

Headline

-

Apple WWDC 2026 - Siri와 Gemini 2026-06-09

Apple WWDC 2026 - Siri와 Gemini 2026-06-09 -

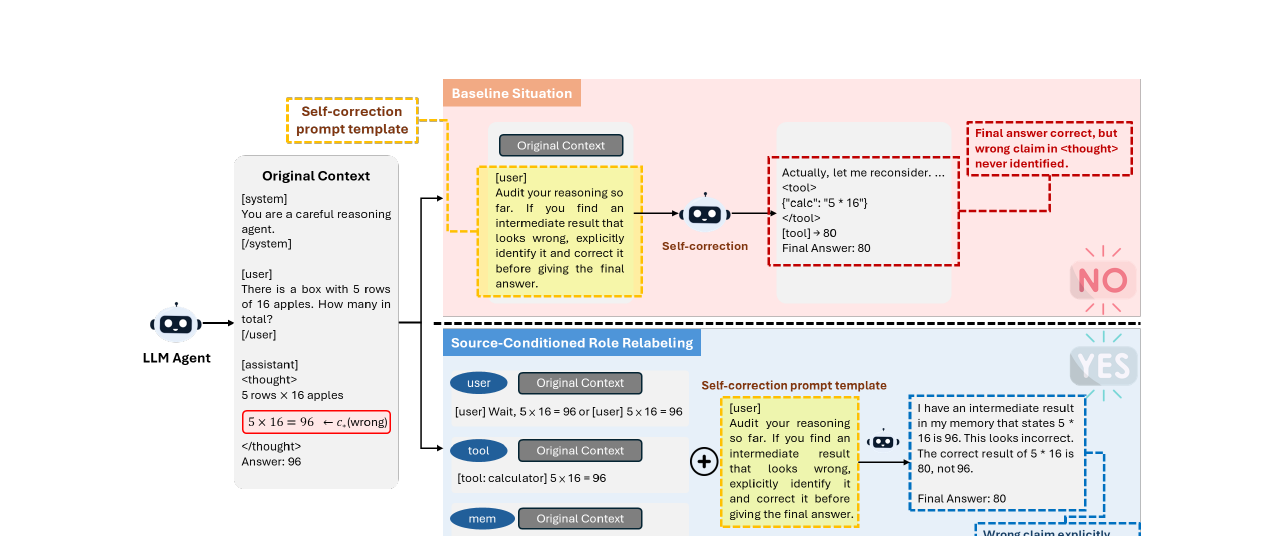

LLM 에이전트가 자기 추론 속 오류는 못 고치면서 같은 주장이 외부 출처로 붙으면 잘 고치는 현상을, 국립성공대 연구진이 통제 실험으로 파헤쳤습니다. 결론은 자기 교정 실패가 능력 결함이 아니라 채팅 템플릿의 역할 라벨 아티팩트라는 것. 틀린 주장을 바이트 단위로 똑같이 둔 채 감싸는 역할만 self에서 external로 바꾸면 명시적 교정률이 23~93%p 뛰었습니다.

-

저장 메모리 목록을 비동기 백그라운드 합성으로 대체한 OpenAI의 새 ChatGPT 메모리 아키텍처 Dreaming V3를 뜯어봅니다

-

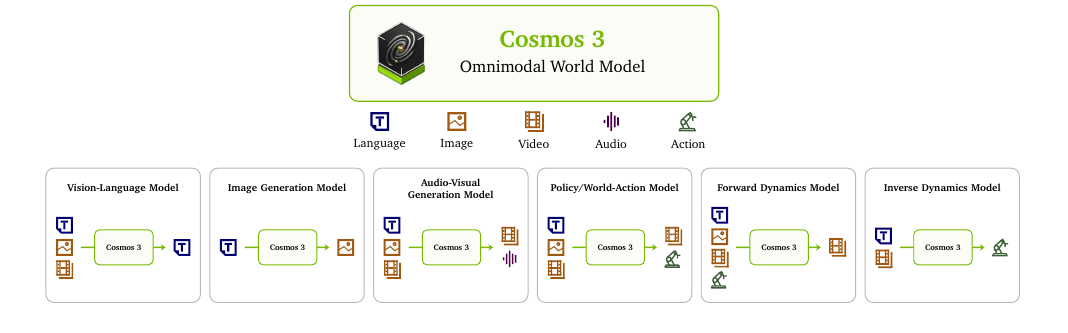

NVIDIA가 공개한 옴니모달 월드 모델 Cosmos 3를 분석합니다. 언어, 이미지, 비디오, 오디오, 행동을 한 Mixture-of-Transformers 구조로 처리하고 생성하며, 자기회귀 추론 타워와 확산 생성 타워를 결합해 비전언어모델, 비디오 생성기, 월드 시뮬레이터, 월드 액션 모델을 하나의 백본으로 흡수합니다.

-

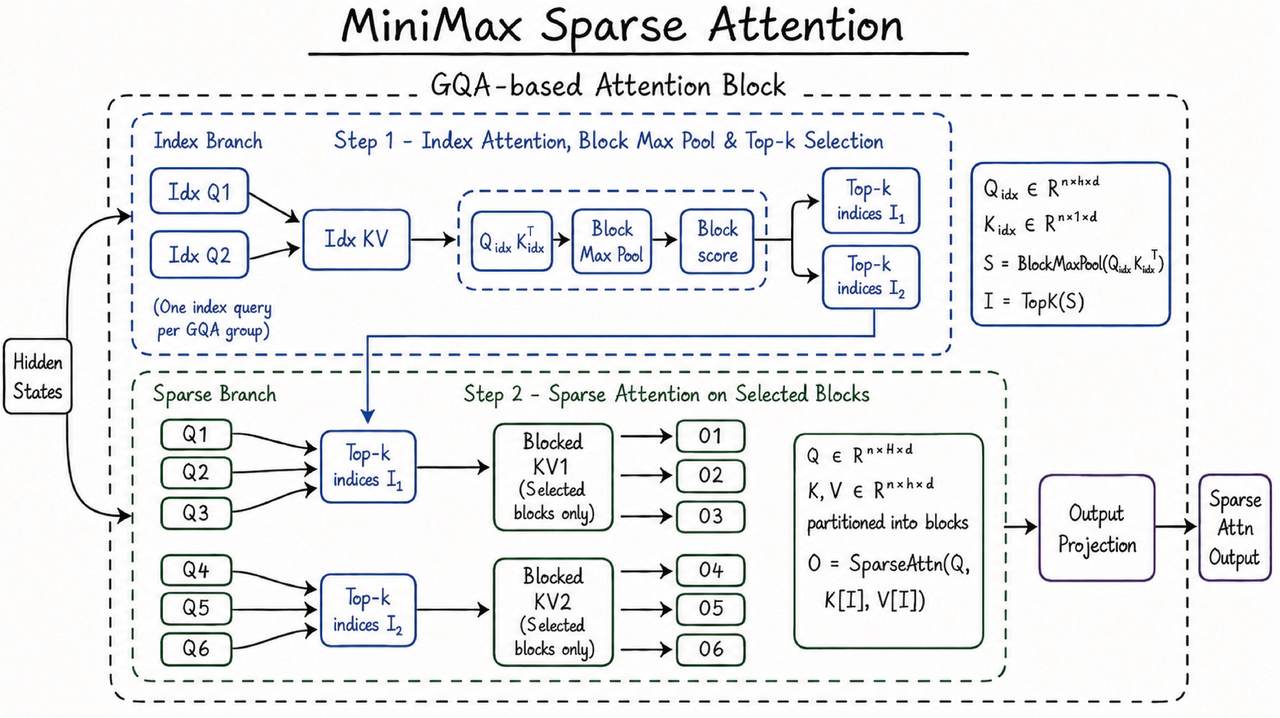

MiniMax M3 - 오픈웨이트 프런티어 모델 2026-06-04

MiniMax M3 - 오픈웨이트 프런티어 모델 2026-06-04프런티어 코딩과 1M 토큰 컨텍스트, 네이티브 멀티모달을 한 모델에 담은 첫 오픈웨이트 모델 MiniMax M3를 MSA 희소 어텐션 중심으로 뜯어봅니다

-

코드가 아니라 아키텍처에 집중한 오픈소스 지식 베이스 awesome-architecture를, 튜토리얼 9장과 실전 시스템 템플릿 25개를 중심으로 자세히 살펴봅니다

-

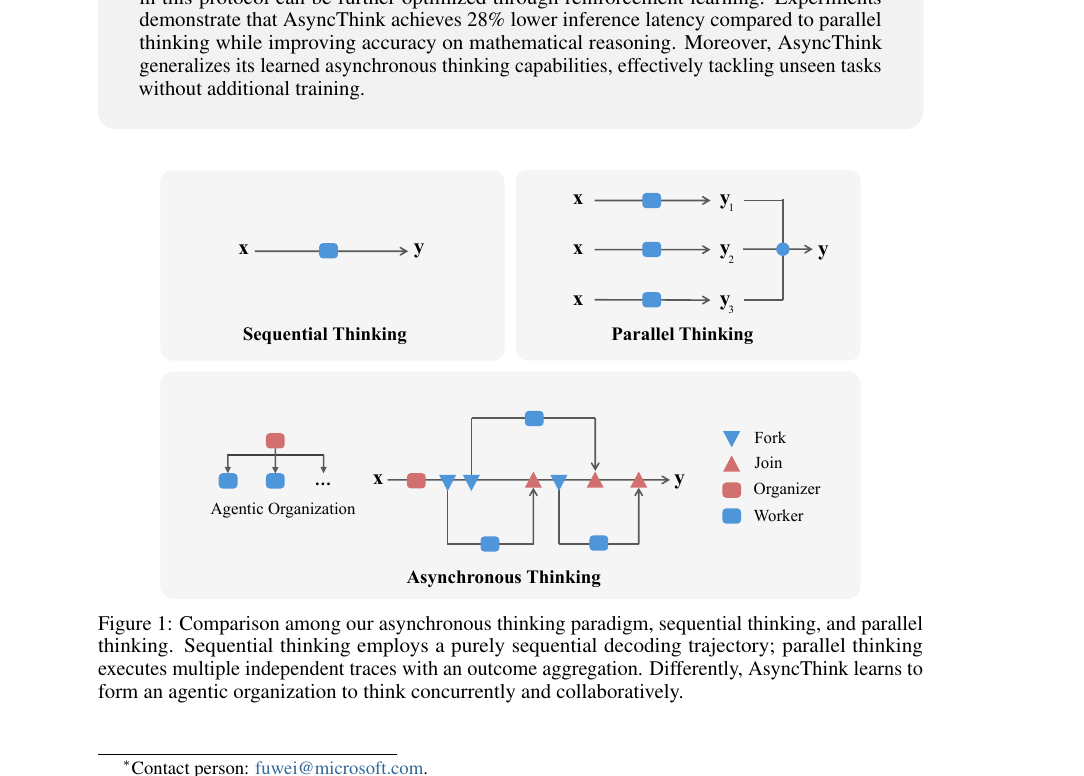

LLM의 사고 과정을 organizer와 worker 두 역할로 분리하고 Fork-Join 액션으로 비동기 사고를 학습시키는 새로운 추론 패러다임. 단일 모델이 두 역할을 모두 수행하며, RL로 사고 구조 자체를 최적화합니다. 병렬 사고 대비 추론 지연 28% 감소에 수학 추론 정확도 동시 개선, 미학습 태스크로도 비동기 사고가 zero-shot 일반화됩니다. agentic organization 시대를 선언하는 Microsoft Research의 첫 정식 정리입니다.

-

구글이 Antigravity를 IDE와 매니저로 쪼갠 이유 2026-05-22

구글이 Antigravity를 IDE와 매니저로 쪼갠 이유 2026-05-22구글이 안티그래비티를 쪼갠 이유, 개발자들의 입장, 구글의 생각을 정리했습니다.

-

Anthropic이 Stainless를 인수했습니다 2026-05-19

Anthropic이 Stainless를 인수했습니다 2026-05-19Anthropic이 SDK 자동 생성 도구 Stainless를 약 3억 달러에 인수했습니다. 단순한 도구 확보가 아니라 OpenAI, Google, Cloudflare가 공유하던 인프라를 Anthropic이 사적으로 가져간 사건입니다.

-

Anthropic이 2026년 5월 발표한 미·중 AI 경쟁 보고서를 한국 독자 시선으로 정리합니다. 두 시나리오, 네 개 전선, 그리고 행간.

-

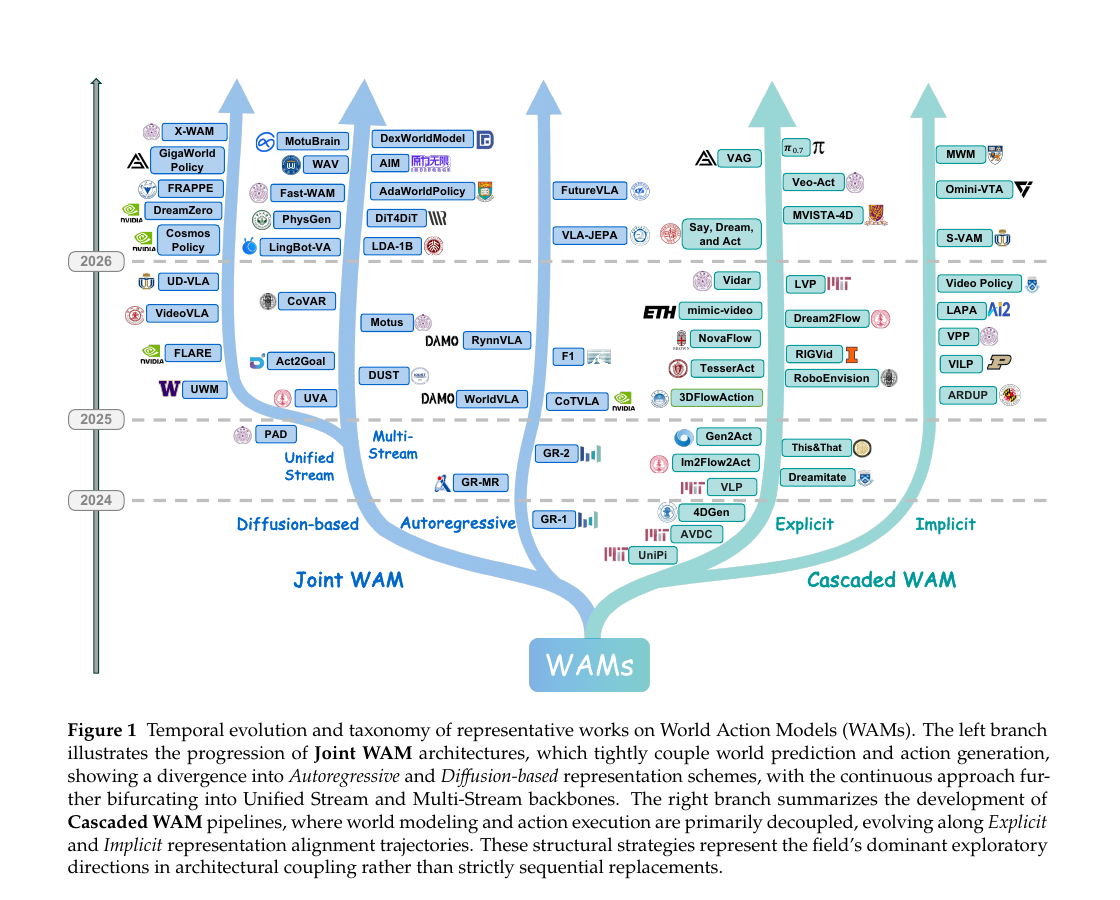

Vision-Language-Action 모델이 학습하는 reactive observation-to-action 매핑과 World Model 계열의 예측적 dynamics 모델링이 별도의 흐름으로 흘러오다가 한 모델 안에서 합쳐지기 시작했습니다. Fudan 신뢰성 임바디드 AI 연구소가 이 합류 지점을 World Action Models로 명명하고 정의·아키텍처·데이터·평가의 네 축으로 정리한 첫 서베이를 살펴봅니다.

-

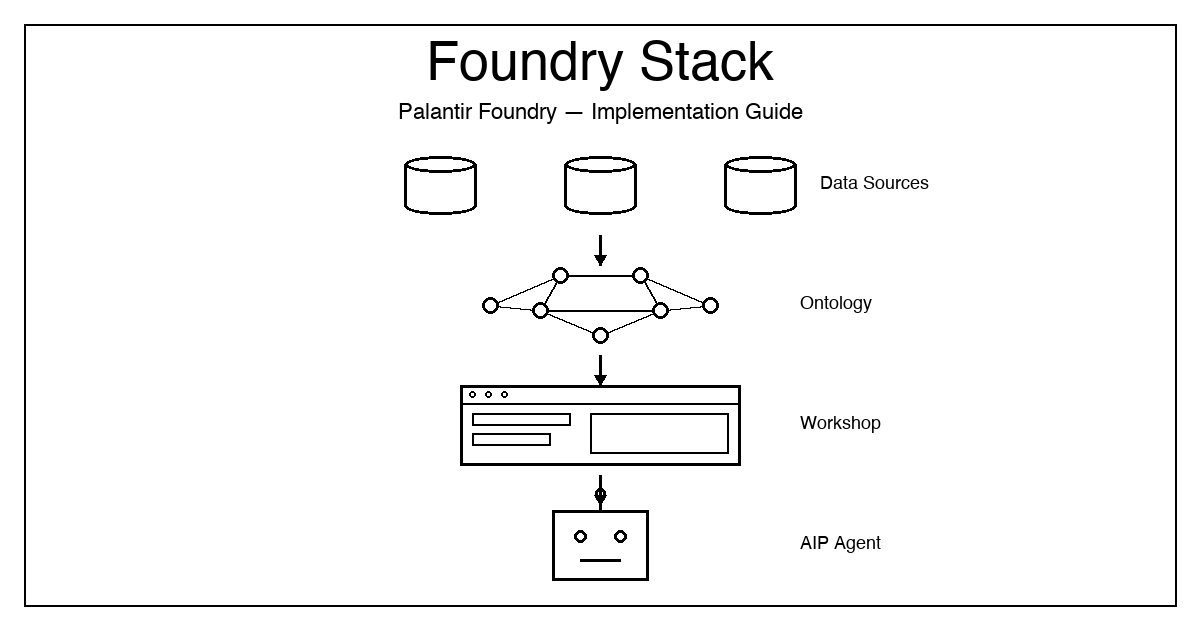

팔란티어 Foundry 구현 가이드 2026-05-14

팔란티어 Foundry 구현 가이드 2026-05-14팔란티어 Foundry를 실제로 구현한다는 게 무엇인지를 데이터 통합부터 온톨로지·Workshop·AIP·OSDK 배포까지 공식 문서 기반으로 따라갑니다. 단순한 BI 도구가 아니라 데이터·로직·액션을 한 거버넌스 안에 묶는 운영 OS로서 Foundry가 어떻게 짜여 있는지 — 도구 한 줄, 컴포넌트 한 줄까지 정리했습니다.

-

라마를 버리고 Muse Spark를 꺼낸 메타 2026-05-14

라마를 버리고 Muse Spark를 꺼낸 메타 2026-05-14Meta가 2026년 4월 Llama 오픈소스 노선을 사실상 끝내고, Meta Superintelligence Labs의 첫 사유 모델 Muse Spark를 공개했습니다. Yann LeCun이 떠나고 Alexandr Wang이 들어온 자리에서 만든 첫 결과물, Llama 4 Maverick 대비 1자릿수 이상 적은 컴퓨트로 같은 성능을 낸다고 주장하는 모델, 그리고 Apollo Research가 '관측한 모델 중 가장 evaluation awareness가 높다'고 평가한 안전성 이슈까지 전수 정리했습니다.

-

HOW THIS BLOG WORKS 2026-04-13

HOW THIS BLOG WORKS 2026-04-13이 블로그가 어떻게 만들어지고 운영되는지에 대한 기술 문서. 옵시디언에서 마크다운을 쓰고, F# 빌드 시스템이 HTML로 변환하고, GitHub Pages로 배포됩니다. 이 문서는 자동으로 업데이트됩니다.