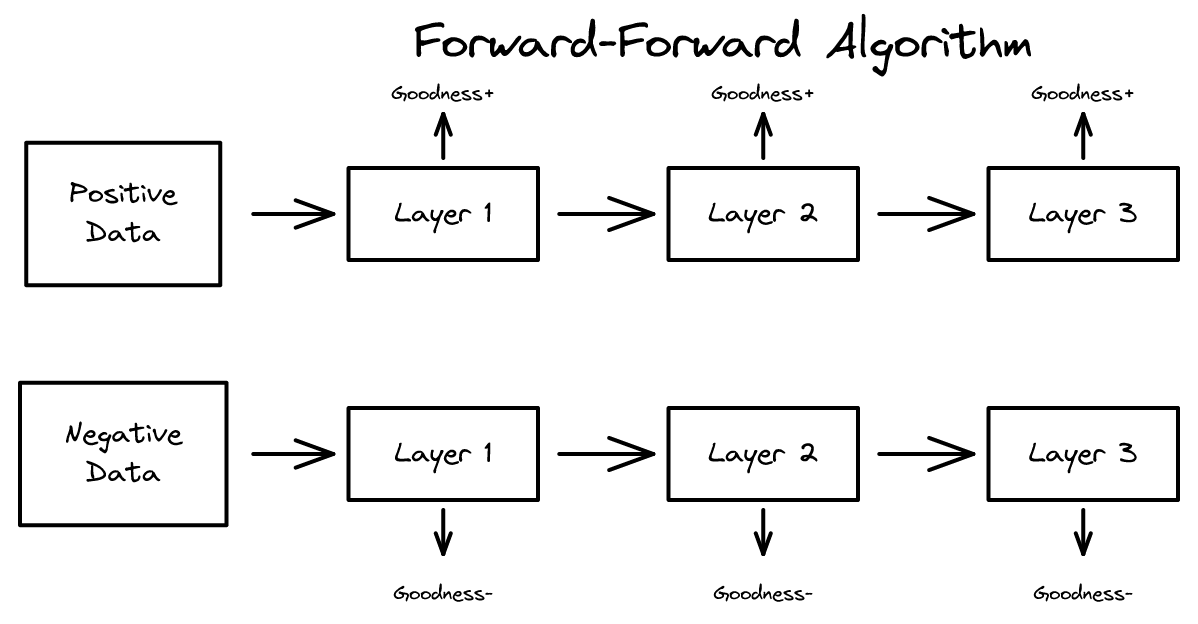

역전파를 두 번의 순전파로 대체하는 Forward-Forward 알고리즘. 각 층이 자체 목적함수로 학습하며 생물학적 타당성 향상

태그: 제프리힌턴

25개의 게시물

-

-

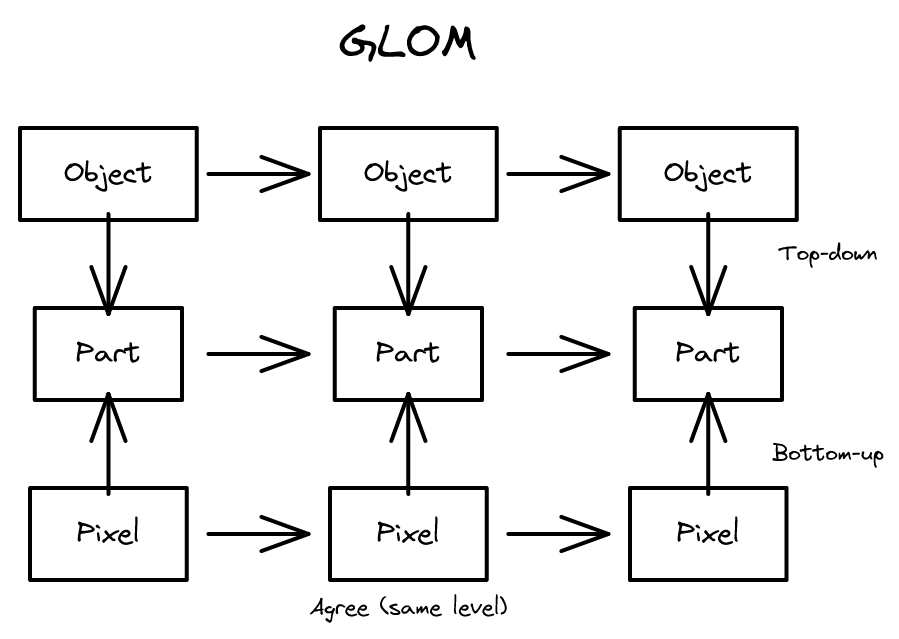

부분-전체 계층 구조를 신경망으로 표현하는 GLOM 모델 제안. 동일 벡터들의 '섬'으로 구문 구조를 인코딩하는 사변적 아키텍처

-

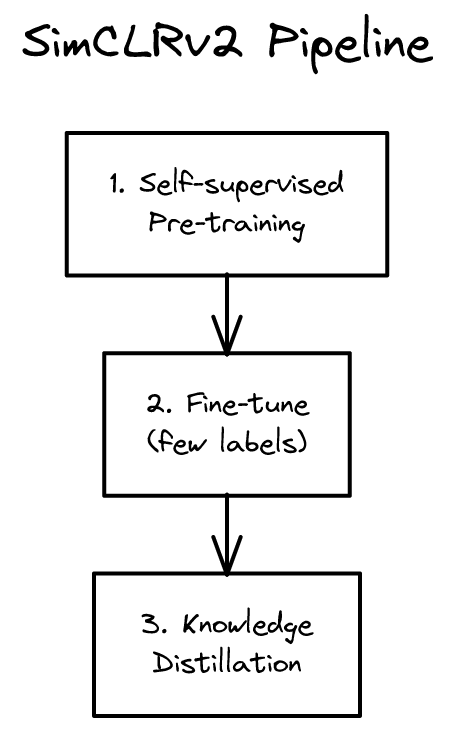

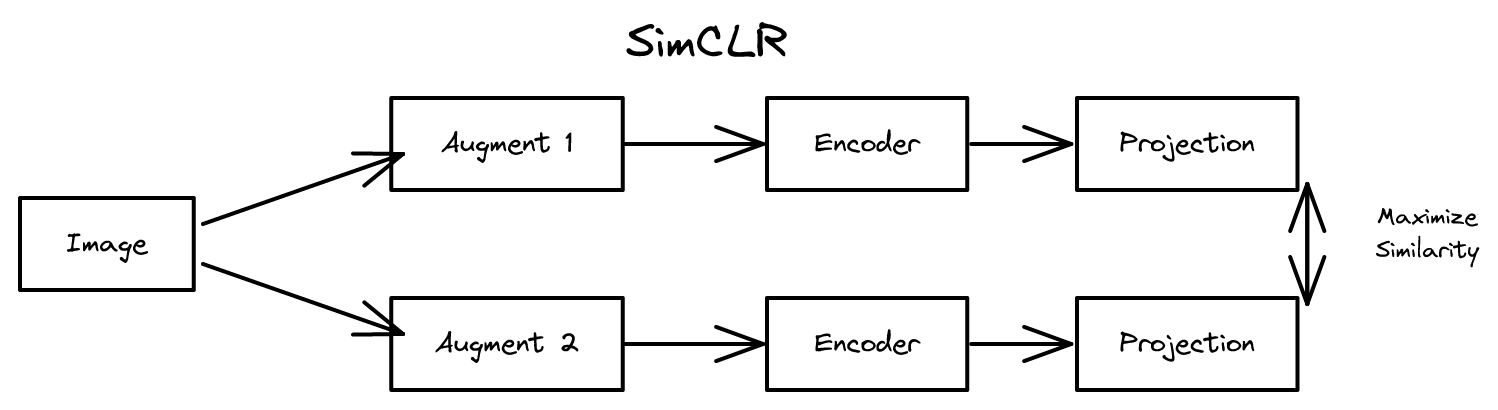

SimCLR 개선판. 자기지도 사전훈련 + 소량 라벨 미세조정의 강력함을 대규모로 검증. 반지도 학습의 새 기준

-

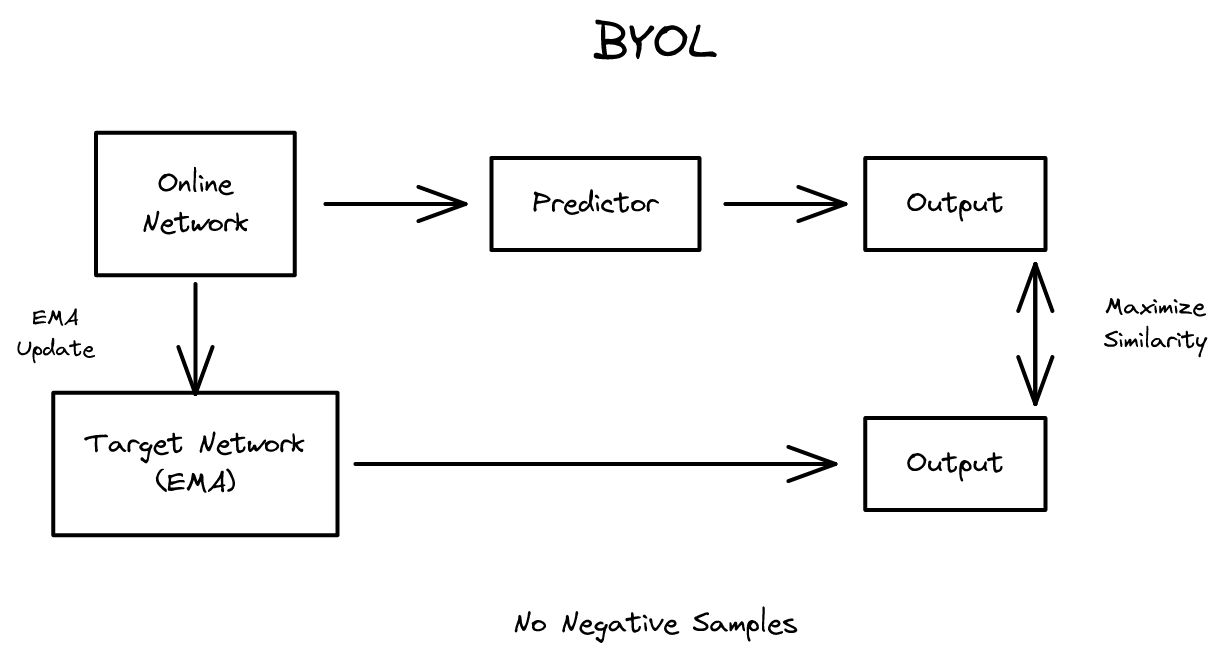

부정 샘플 없이 자기지도 학습하는 방법. SimCLR과 달리 음의 예가 필요 없으며, 온라인-타겟 네트워크 구조로 표현 학습 수행

-

자기지도 대조 학습(contrastive learning) 프레임워크. 데이터 증강과 대조 손실로 라벨 없이 강력한 표현 학습. 10,000+ 인용

-

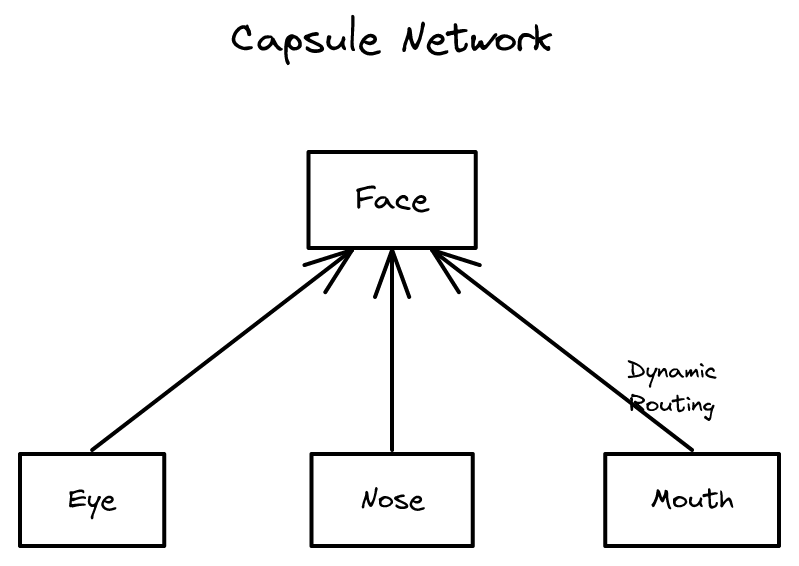

Dynamic Routing Between Capsules 2026-04-18

Dynamic Routing Between Capsules 2026-04-18CNN의 공간 계층 무시 문제를 캡슐 네트워크와 동적 라우팅으로 해결하는 접근. 구조 정보 기반 신경망 설계

-

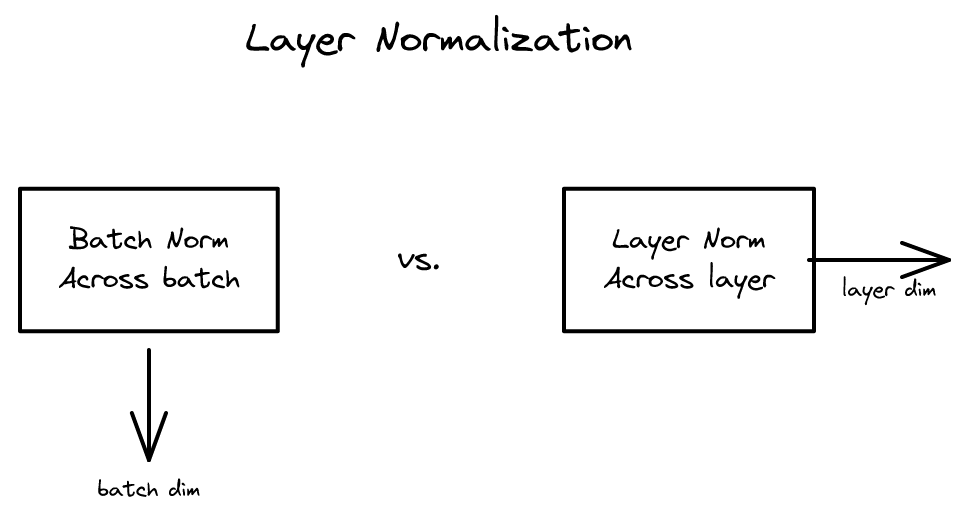

Layer Normalization 2026-04-17

Layer Normalization 2026-04-17배치 대신 레이어 단위로 정규화하는 방법. RNN과 Transformer에서 핵심 구성요소가 된 기법

-

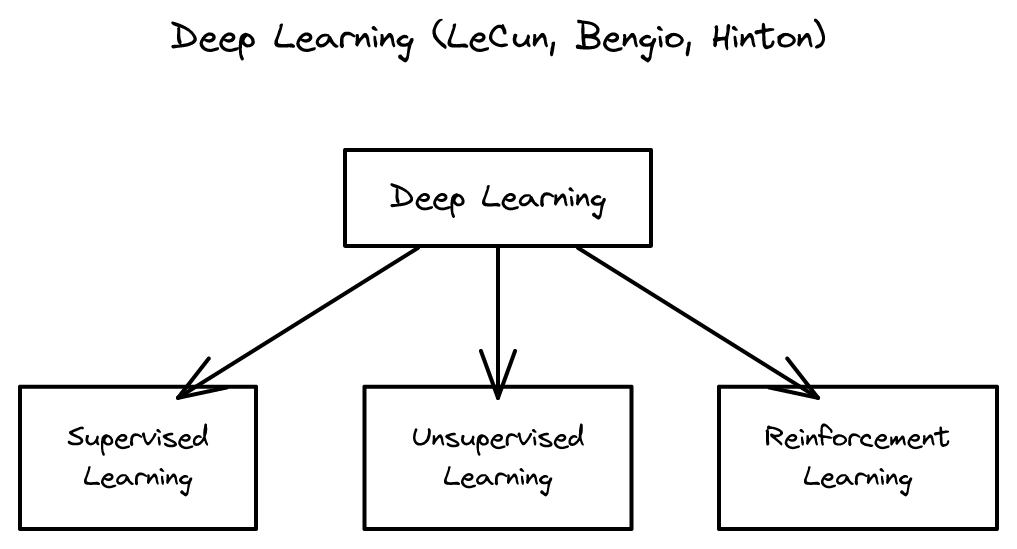

Deep Learning (Nature 2015) 2026-04-16

Deep Learning (Nature 2015) 2026-04-16LeCun, Bengio, Hinton 3대 거장이 함께 쓴 딥러닝 분야 정의 논문으로, 이 분야의 핵심 개념과 이전 60년의 발전사를 종합한 이정표입니다.

-

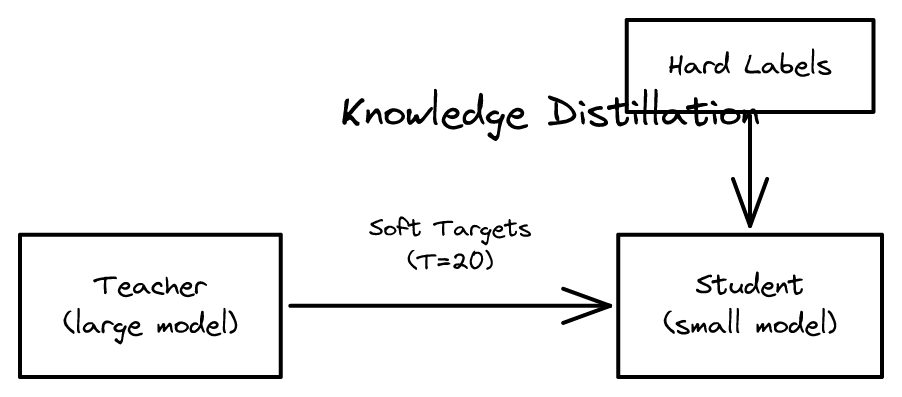

Distilling the Knowledge in a Neural Network 2026-04-15

Distilling the Knowledge in a Neural Network 2026-04-15지식 증류는 큰 모델의 '소프트 타겟'으로 작은 모델을 훈련하는 기법으로, 현대 모델 압축과 배포의 표준이 되었습니다.

-

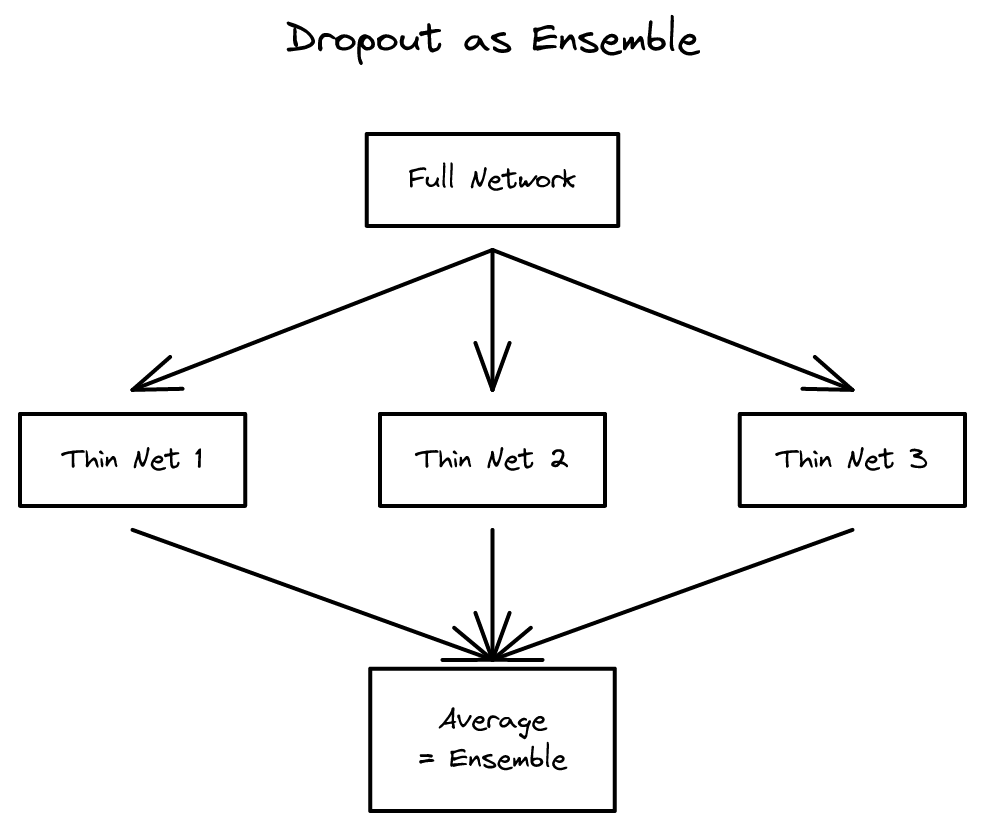

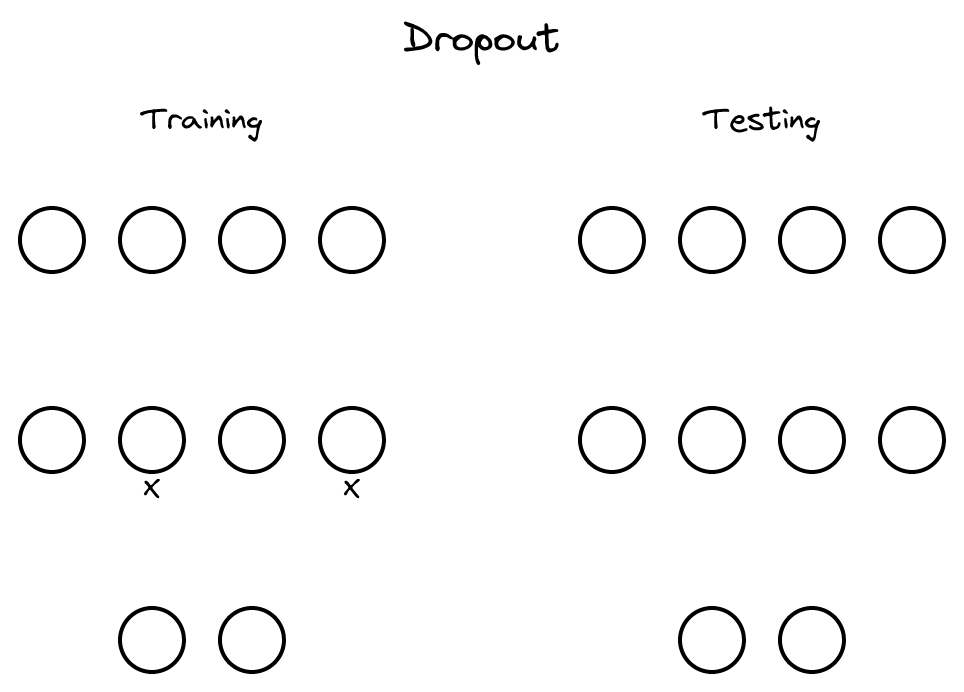

훈련 시 뉴런을 확률적으로 끄는 Dropout은 단순하면서도 강력한 정규화 기법으로, 딥러닝의 표준 도구가 되었습니다.

-

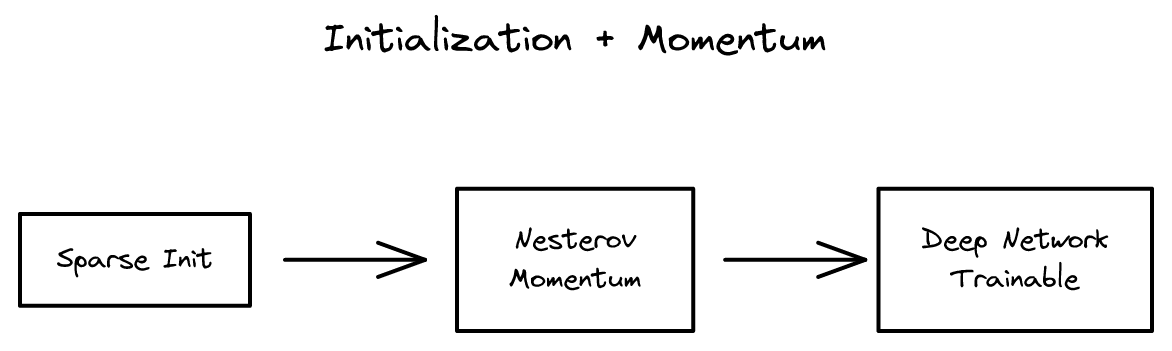

모멘텀 기반 최적화의 중요성을 입증. Nesterov 모멘텀과 적절한 초기화의 조합이 SGD를 크게 개선함을 보인 논문.

-

Dropout의 원조 논문. 특징 탐지기의 공동적응을 방지하여 일반화 성능 개선. 2014 JMLR 논문의 전신

-

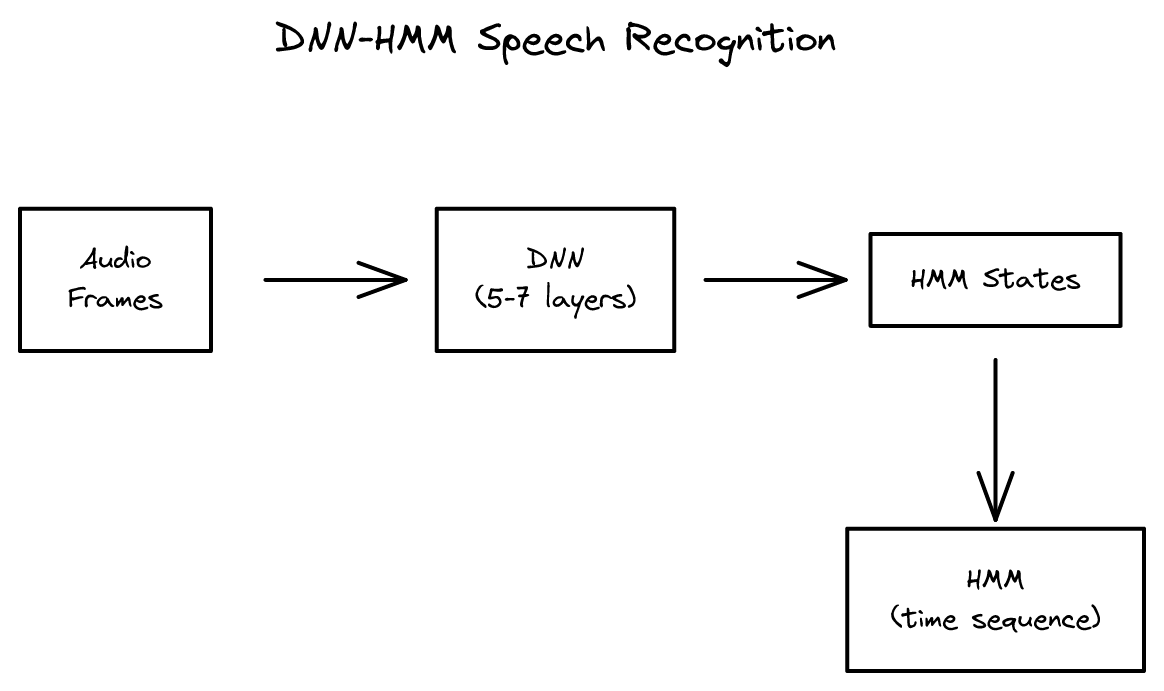

Google, Microsoft, IBM, Toronto 4개 연구팀의 공동 논문으로, 딥러닝을 음성인식 산업에 처음 성공적으로 적용한 기념비적 논문입니다.

-

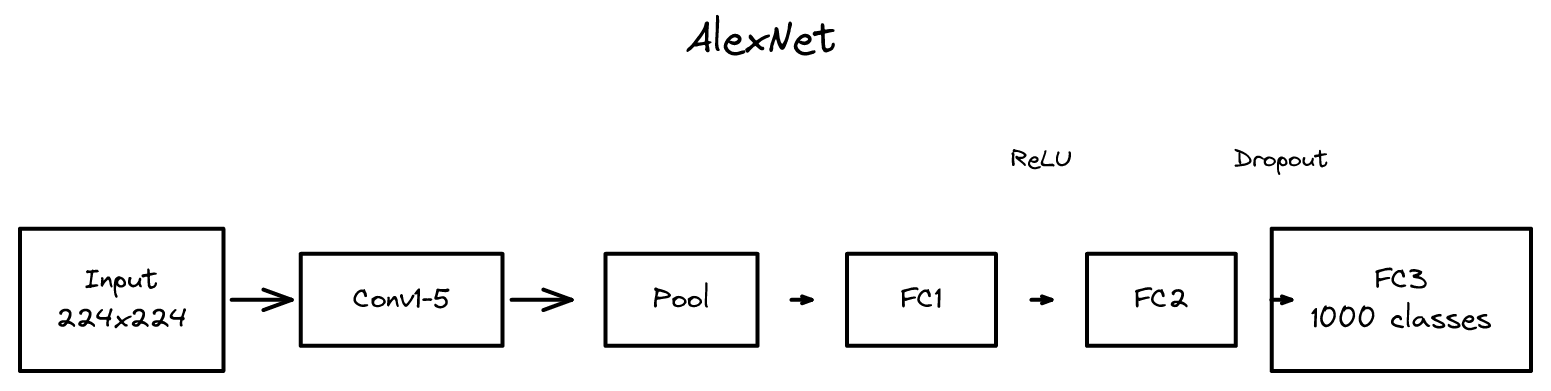

ImageNet 대회에서 압도적으로 우승한 AlexNet은 GPU 활용, ReLU, Dropout을 결합하여 딥러닝의 실용성을 처음 증명한 논문입니다.

-

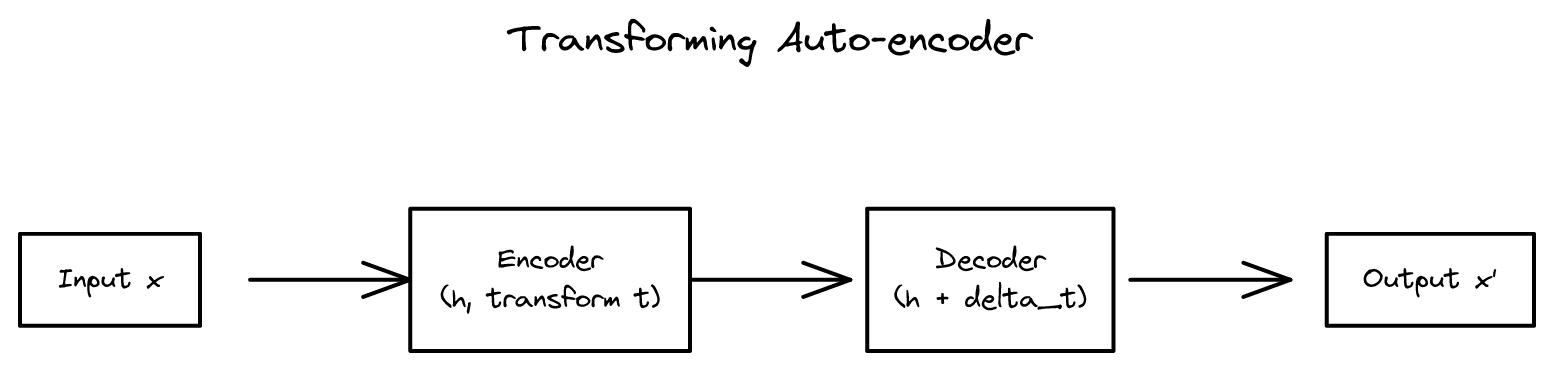

Transforming Auto-encoders 2026-04-09

Transforming Auto-encoders 2026-04-09캡슐 신경망 아이디어의 첫 등장. 변환에 등변(equivariant)한 표현을 학습하여 기하학적 불변성 추구

-

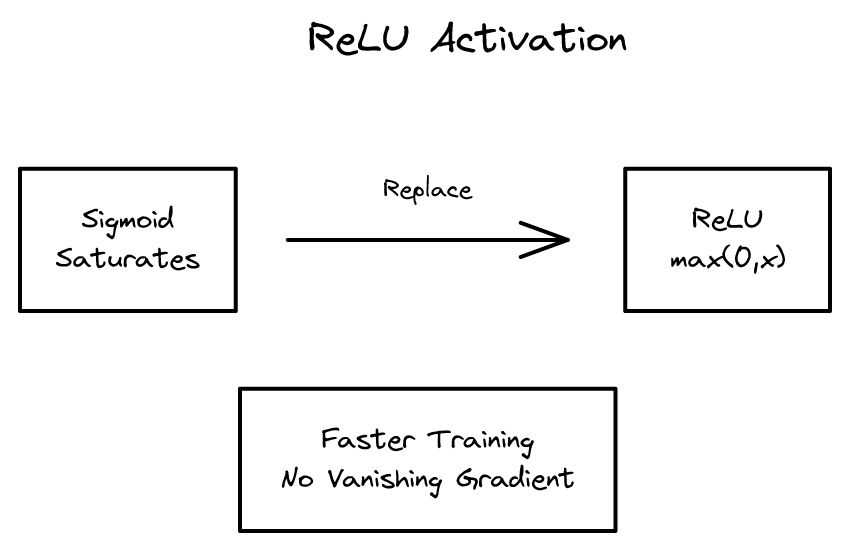

ReLU 활성화 함수를 RBM에 도입. 이후 거의 모든 딥러닝의 표준 활성화 함수가 되어 신경망 실무를 크게 단순화한 논문.

-

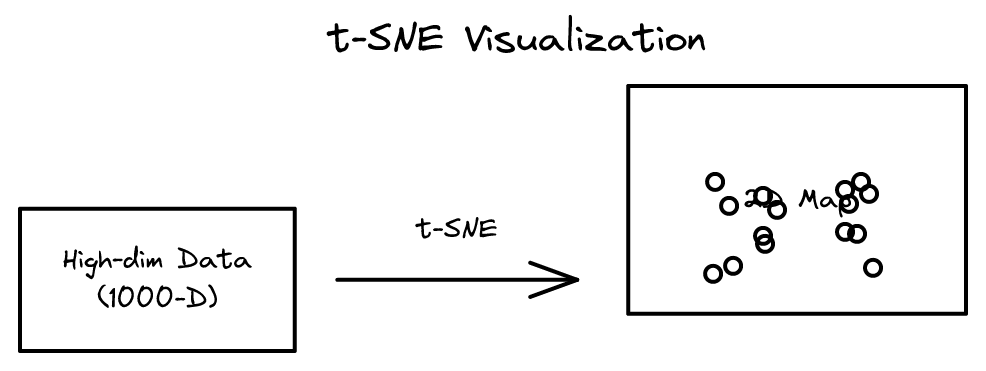

Visualizing Data using t-SNE 2026-04-07

Visualizing Data using t-SNE 2026-04-07확률적 근이웃 임베딩의 개선된 버전 t-SNE. 고차원 데이터의 시각화에 특화된 알고리즘으로 ML 연구에서 가장 널리 사용되는 방법.

-

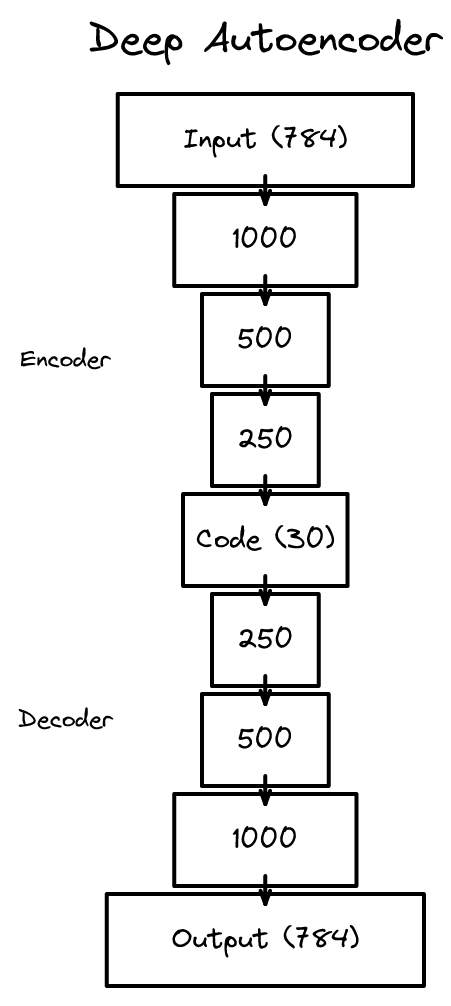

깊은 오토인코더로 비선형 차원 축소를 수행. PCA보다 우수한 성능을 보여 신경망 기반 차원 축소의 실용성을 입증한 논문.

-

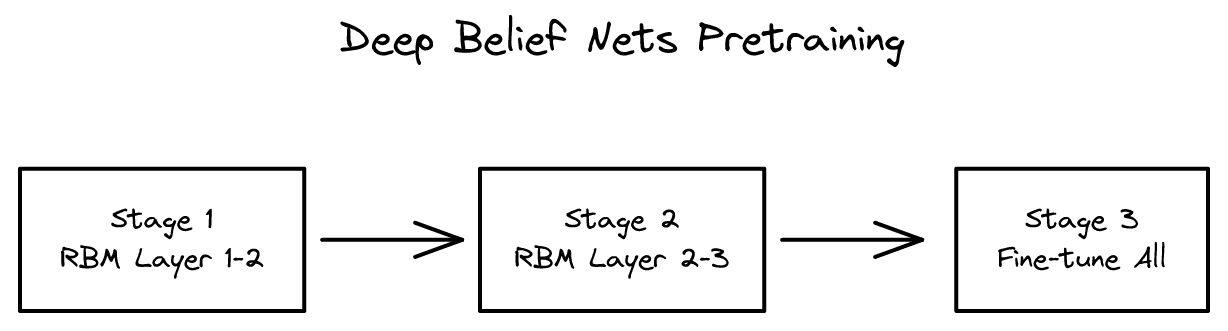

층별 사전훈련으로 심층 신경망 학습을 가능하게 한 논문. 깊은 신경망 학습의 문제를 해결하고 '딥러닝'이라는 용어를 탄생시킨 획기적 연구.

-

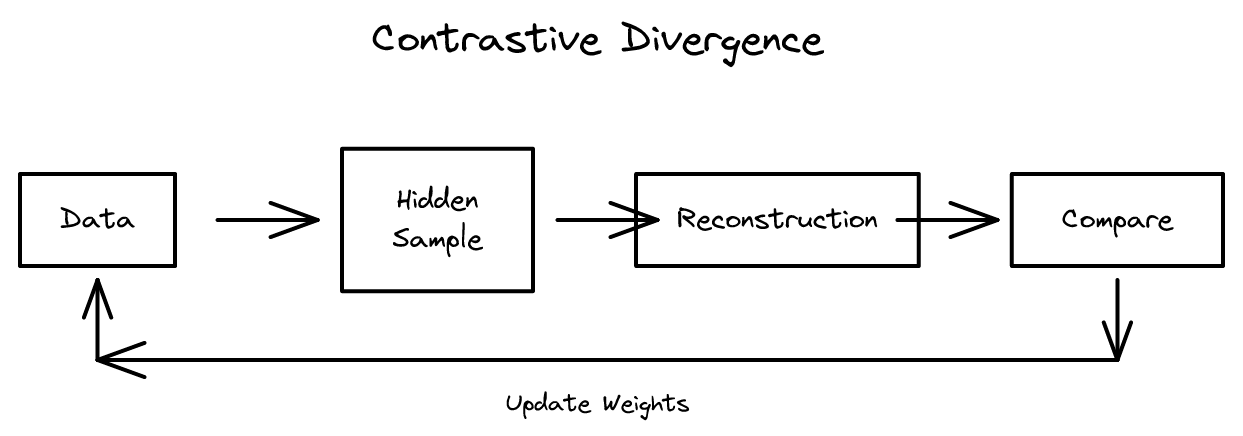

대조 발산 알고리즘으로 전문가 혼합 모델을 훈련하는 실용적 방법, RBM 훈련의 핵심 기법

-

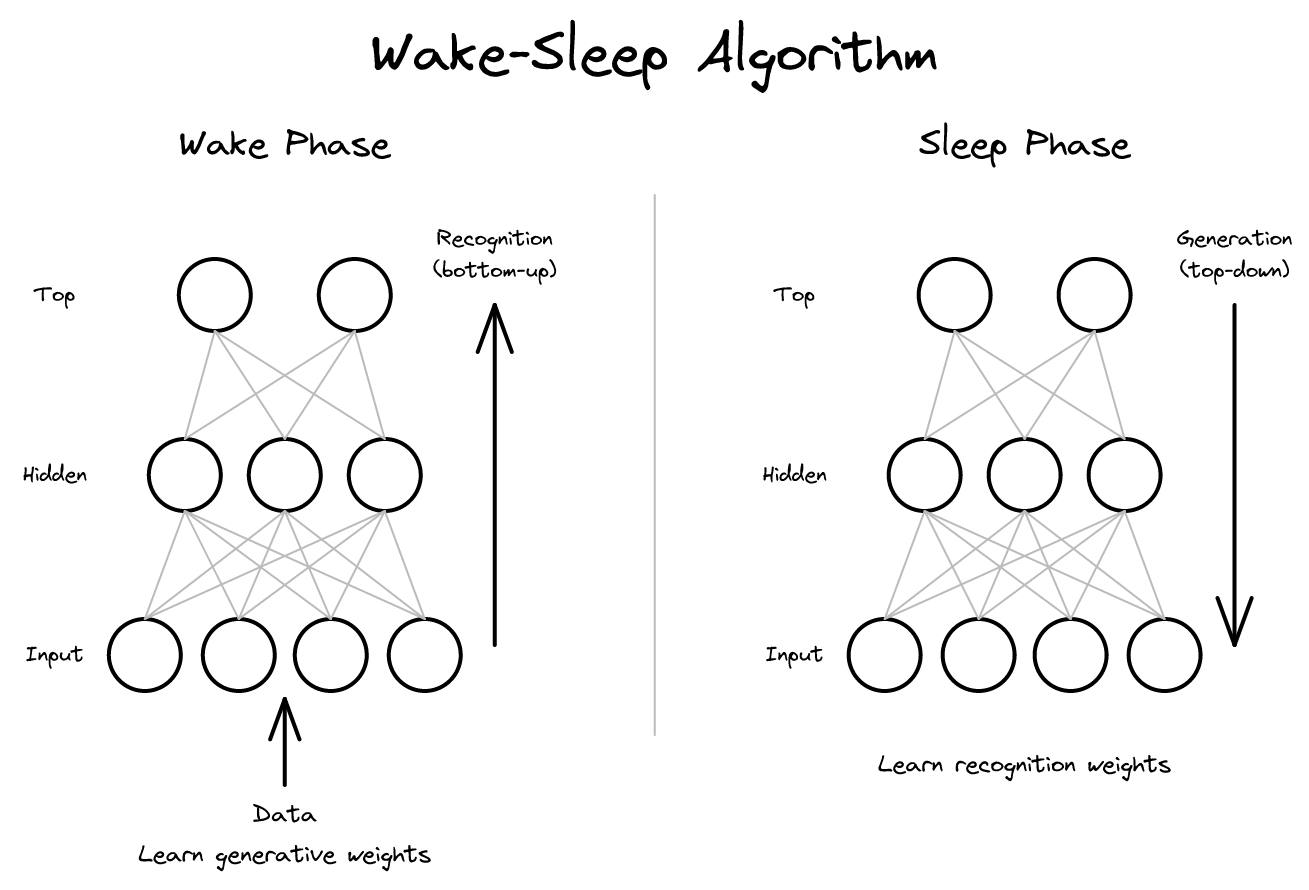

계층적 생성 모델을 비지도 학습하는 구체적 방법: 깨어 있을 때는 인식을 배우고 자는 동안 생성을 배운다

-

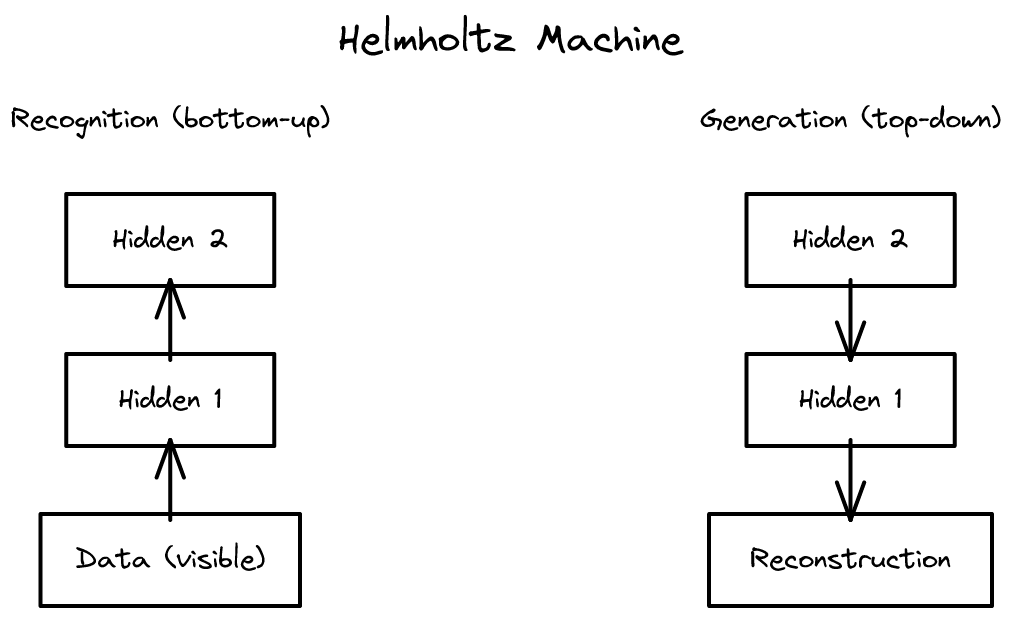

The Helmholtz Machine 2026-04-02

The Helmholtz Machine 2026-04-02생성 모델과 인식 모델을 분리하고, 변분 추론의 신경망 구현을 제시한 선구적 작업

-

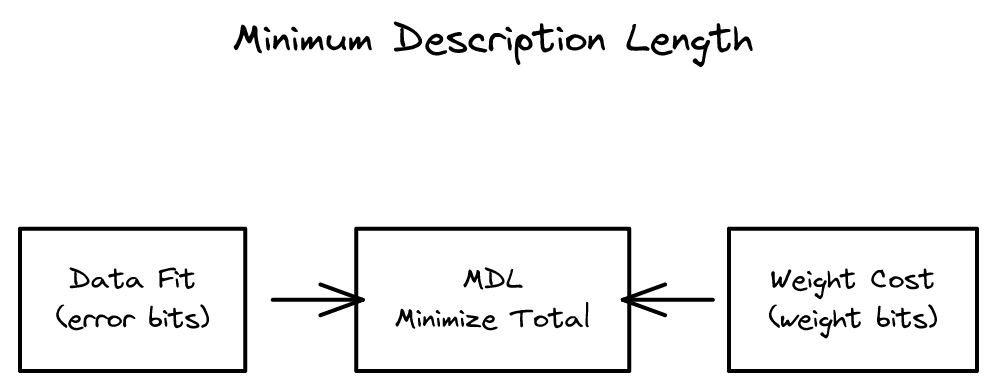

최소 설명 길이(MDL) 원칙으로 신경망의 가중치 복잡도를 줄여 과적합을 방지. 베이지안 딥러닝의 초기 연구

-

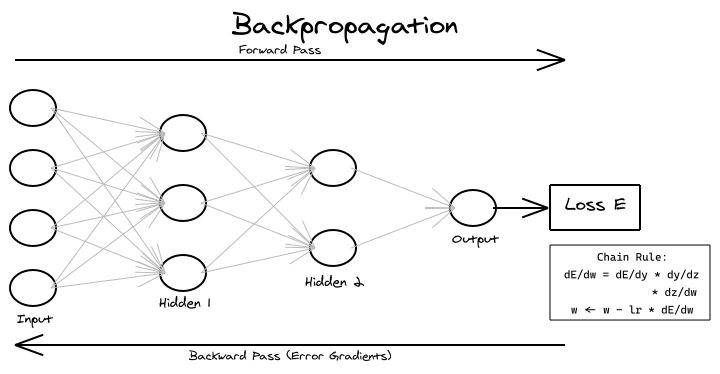

다층 신경망을 훈련하는 오차역전파 알고리즘을 대중화하고 내부 표현 학습의 가능성을 입증

-

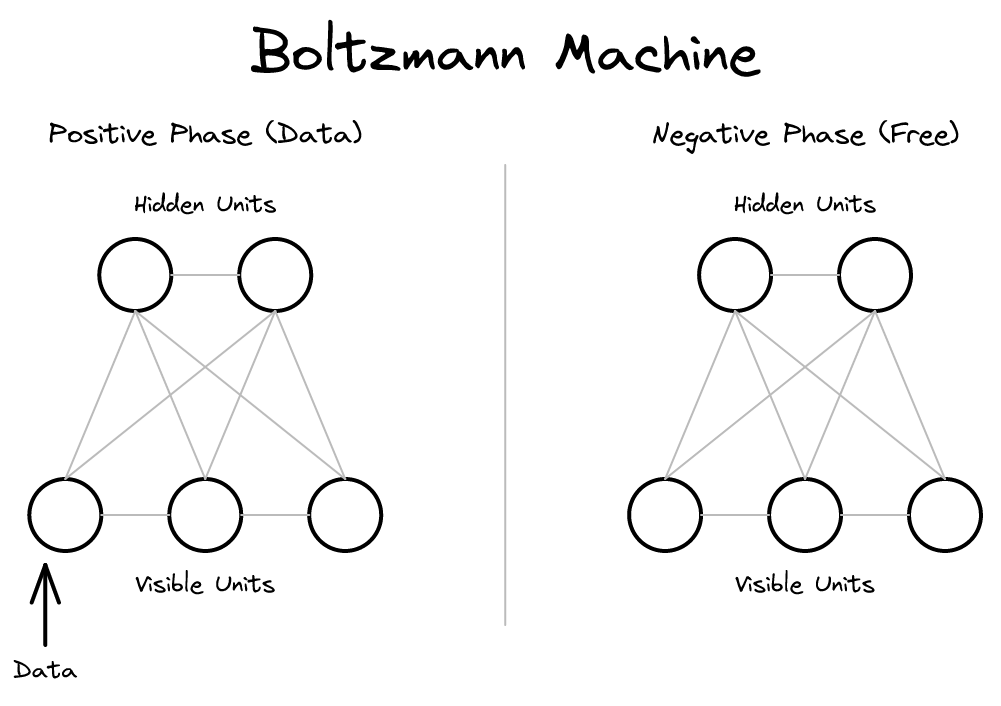

A Learning Algorithm for Boltzmann Machines 2026-03-30

A Learning Algorithm for Boltzmann Machines 2026-03-30병렬 신경망이 제약 만족 문제를 어떻게 해결하는지 보여준 에너지 기반 모델의 시작