Visualizing Data using t-SNE

Visualizing Data using t-SNE

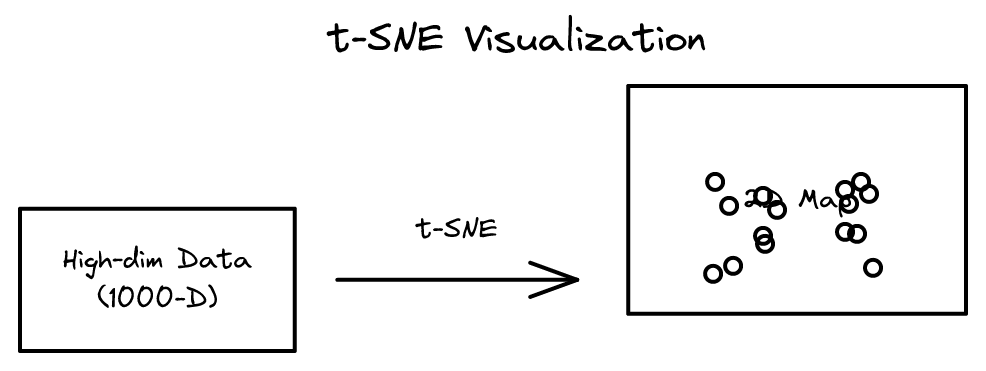

고차원 데이터를 2차원이나 3차원으로 시각화하는 것은 데이터의 구조를 이해하는 데 필수적입니다. t-SNE(t-distributed Stochastic Neighbor Embedding)는 이를 위한 표준 방법이 되었습니다.

[1] L. van der Maaten and G. E. Hinton, "Visualizing data using t-SNE," Journal of Machine Learning Research, vol. 9, pp. 2579–2605, 2008.

배경

2008년, 고차원 데이터 시각화는 머신러닝 연구의 실질적 병목이었습니다. 기존 방법들은 지역 구조와 전역 구조를 동시에 보존하기 어려웠으며, 특히 crowding problem이 심각했습니다. JMLR에 발표된 이 논문은 Student-t 분포를 활용하여 고차원 데이터의 지역 구조를 놀랍도록 잘 보존하는 시각화를 가능하게 했습니다.

저자 소개

Laurens van der Maaten은 틸뷔르흐대(네덜란드) 연구자로, 이후 Facebook AI Research에서 활동했습니다. Geoffrey Hinton은 토론토대 교수였습니다.

요약

t-SNE는 고차원 공간의 점들 사이의 유사도를 확률로 모델링합니다. 저차원 공간에서도 그 확률 분포를 최대한 유사하게 유지하도록 점들을 배치합니다. 이렇게 하면 국소 구조(local structure)가 잘 보존되고 시각화가 명확해집니다.

기술 스펙: - 입력: 고차원 데이터(N개 점, D차원) - 출력: 저차원 표현(N개 점, 2-3차원) - 고차원 유사도: 가우시안 커널로 모델링 - 저차원 유사도: t-분포로 모델링 (Student t-distribution with df=1) - 최적화: 경사하강법으로 쿨백-라이블러 발산(KL divergence) 최소화

논문 상세

배경

기존의 차원 축소 방법들(PCA, Sammon mapping, Isomap 등)의 문제점은 다음과 같습니다: - PCA: 선형만 가능 - Isomap: 계산 비용이 큼 - 많은 방법들이 "crowding problem" 발생: 저차원에서 점들이 중앙에 몰려서 구조가 흐려짐

방법론

Step 1: 고차원 유사도 계산

점 i와 j의 유사도 p_ij는 다음과 같습니다:

p_ij ∝ exp(-||x_i - x_j||²/(2σ_i²))

각 점 i마다 σ_i는 perplex(복잡도)가 일정하도록 자동 조정됩니다. perplex는 사용자 지정 하이퍼파라미터입니다 (전형적으로 5-50).

Step 2: 저차원 유사도 계산

저차원 점들 y_i, y_j 사이의 유사도 q_ij는 다음과 같습니다:

q_ij ∝ (1 + ||y_i - y_j||²)^(-1)

t-분포(자유도 1)를 사용합니다. 가우시안 대신 t-분포를 쓰는 이유는 "repulsive force"의 강도 조절 때문입니다.

Step 3: 최적화

목적함수: KL 발산 최소화

C = Σ_i Σ_j p_ij log(p_ij/q_ij)

경사하강법으로 저차원 점들 y_i를 업데이트합니다.

t-분포를 쓰는 이유: - 가우시안: 거리가 커질수록 빠르게 작아집니다 - t-분포 (df=1): 거리가 커져도 천천히 작아집니다 - 이것이 crowding problem을 해결합니다

결과

MNIST (6,000개 랜덤 샘플): - 명확한 클러스터 분리 - 숫자별 그룹이 잘 시각화됨 - 중간 형태(예: 4와 9의 중간 형태) 위치도 직관적

Olivetti 얼굴 데이터: - 각 사람별 클러스터 형성 - 비슷한 표정/각도의 얼굴들이 근처에 위치

스위스 롤(Swiss roll) 데이터: - 논문에서 crowding problem 설명에 개념적으로 언급되었지만, 주요 실험 데이터셋(MNIST, Olivetti 얼굴, COIL-20, 단어 특성, Netflix)에는 포함되지 않았습니다

생각

잘한 점: 이 논문은 실용성과 이론의 좋은 균형을 맞췄습니다. Crowding problem을 t-분포로 우아하게 해결했으며, 매개변수도 직관적입니다(perplex). 무엇보다 실제로 매우 효과적이고 사용하기 쉽습니다.

시각화 결과가 명확하고, 다양한 데이터셋에서 잘 작동합니다. 구현도 간단하여 널리 채택될 수 있었습니다.

한계: - 시간 복잡도: O(N^2) - 매우 큰 데이터셋(N > 100만)에서는 느립니다 (이후 Barnes-Hut t-SNE로 개선) - 초기화 민감성: 무작위 초기화를 사용하므로 실행마다 결과가 약간 다릅니다 - 글로벌 구조 보존이 약합니다: 국소 구조는 잘 보존하지만, 전체 데이터 분포는 왜곡될 수 있습니다 - 3차원 이상의 시각화는 덜 효과적입니다 (2차원이 최적) - 하이퍼파라미터 해석 부족: perplex를 어떻게 선택해야 하는지 명확한 가이드가 부족합니다

의의: 이것은 순수 응용 논문이지만, 학계에 가장 큰 영향을 미친 논문 중 하나입니다. 현재 거의 모든 머신러닝 논문의 시각화 결과 섹션에서 t-SNE를 볼 수 있습니다. 신경망의 중간 층 활성화, 임베딩, 고차원 특성을 시각적으로 이해하는 데 필수적인 도구가 되었습니다.

비록 수학적 깊이는 제한적이지만, 실무적 임팩트와 사용 편의성에서 전무후무한 논문입니다.

후속 연구 링크

이 논문은 시각화 도구로서 독립적인 기여이며, Hinton의 후속 논문에서 직접적으로 한계를 다루지는 않았습니다. Barnes-Hut t-SNE(2014) 등의 개선은 공저자 van der Maaten이 주도했습니다.