World-R1 - Reinforcing 3D Constraints for Text-to-Video Generation

원제: World-R1: Reinforcing 3D Constraints for Text-to-Video Generation

저자: Wang, Weijie et al. (Zhejiang University, Microsoft Research, Independent)

발행: 2026.04.27, arXiv

비디오 생성 모델은 근본적으로 이미지 공간에서 동작합니다. 픽셀 패턴의 상관관계를 학습하지, 세상의 3D 구조를 이해하는 게 아닙니다. 짧고 카메라가 거의 움직이지 않는 클립에서는 이게 문제가 안 됩니다. 그런데 "카메라가 건물을 돌아가며" 또는 "긴 복도를 밀고 들어가는" 장면을 생성하면, 모델은 기하학적 일관성을 지켜야 한다는 제약이 없으니 그냥 그럴듯한 픽셀을 이어붙입니다.

기존 해결책들은 크게 두 갈래였습니다. - 아키텍처에 3D 모듈을 붙이는 것 : 추론 비용이 올라가고 원래 모델의 다양성이 훼손됩니다. - 3D 인식 데이터셋으로 파인튜닝하는 것 : 데이터셋이 정적이고 다양성이 부족해 동적 장면에서 취약합니다.

World-R1은 조금 다른 방식을 시도합니다.

비디오 모델은 이미 내부에 3D 지식을 갖고 있다, 꺼내기만 하면 된다.

방법론

World-R1의 핵심을 간단하게 요약하면 다음과 같습니다.

첫째, 아키텍처를 건드리지 않는다.

Wan 2.1 (1.3B, 14B)을 백본으로 그대로 쓰되, 강화학습으로 모델이 스스로 3D 일관성을 내재화하도록 유도합니다.

둘째, 보상 신호를 3D 재구성으로 만든다.

생성된 영상을 3D Gaussian Splatting으로 재구성해서 "이 영상이 3D적으로 일관되냐?"를 측정합니다. 일관되지 않으면 페널티, 일관되면 보상.

셋째, 텍스트 프롬프트로 카메라를 암묵적으로 제어한다.

별도의 카메라 인코더 없이 프롬프트에서 "push in", "orbit left" 같은 키워드를 감지해 궤적을 생성하고, 이를 잠재 노이즈에 광학 흐름으로 주입합니다.

암묵적 카메라 컨디셔닝

카메라 컨트롤에 보통 쓰는 방식은 별도 네트워크를 학습시켜 카메라 포즈를 인코딩하는 겁니다. World-R1은 이를 완전히 우회합니다.

텍스트 프롬프트에서 동작 키워드(push in, pan left, orbit left 등)를 감지해 카메라 외부 행렬 시퀀스를 생성합니다. 이 3D 궤적을 2D 광학 흐름 필드로 변환한 뒤, 노이즈 래핑(noise wrapping)을 통해 초기 잠재 노이즈에 직접 심어버립니다. Diffusion 모델의 초기 노이즈 분포가 생성 결과에 강하게 영향을 준다는 점을 이용한 거죠. 아무 파라미터도 추가하지 않고, 카메라 의도를 모델에게 전달합니다.

보상 설계

보상은 두 축으로 구성됩니다.

3D 일관성 보상 (R₃D): 1. Smeta: Depth Anything 3으로 생성 영상을 3DGS로 재구성한 뒤, 새로운 시점(메타뷰)에서 렌더링합니다. 이 렌더링을 Qwen3-VL로 평가해 텍스트 충실도와 구조적 신뢰도를 측정합니다. 정면에서는 안 보이던 기하학적 결함이 다른 각도에서는 드러나기 때문에 효과적입니다. 2. Srecon: 생성 영상과 3DGS 재렌더링 사이의 픽셀 수준 유사도를 LPIPS로 측정합니다. 3. Straj: 입력 카메라 궤적과 생성된 영상에서 추정된 궤적 간의 편차를 측정해 제어 정밀도를 평가합니다.

일반 생성 보상 (Rgen): HPSv3 미적 점수로 시각적 품질을 보장합니다. 3D 일관성만 추구하다 영상이 딱딱해지는 것을 막는 역할을 합니다.

최적화는 Flow-GRPO로 수행합니다. GRPO가 비평가 네트워크 없이 그룹 샘플링으로 어드밴티지를 추정하는 방식이라 고차원 영상 데이터에도 적용 가능합니다.

순수 텍스트 데이터셋과 주기적 분리 훈련

데이터는 기존 비디오 데이터셋 대신 Gemini으로 생성한 약 3,000개의 텍스트 장면 설명만 사용합니다. 특정 시각적 편향 없이 물리 법칙 학습을 유도하는 것이 목표입니다. 프롬프트는 단순 이동, 복합 궤적 등 난이도별로 분류됩니다.

훈련 중 3D 보상만 강조하면 동적인 장면(움직이는 인물, 흔들리는 나뭇잎)이 억제되는 문제가 생깁니다. 이를 막기 위해 주기적 분리 훈련 전략을 씁니다. 매 100 스텝마다 3D 보상을 꺼두고, 동적 장면 데이터로 일반 보상만 최적화합니다. 정적 기하학적 일관성과 동적 유동성 사이의 균형을 잡는 정규화 장치입니다.

실험 결과

백본 모델은 Wan 2.1이며, Small(1.3B, H200 48대)과 Large(14B, H200 96대) 두 버전을 실험했습니다.

3D 일관성 (3DGS 재구성 기준):

모델 |

PSNR ↑ |

SSIM ↑ |

LPIPS ↓ |

|---|---|---|---|

Wan2.1-T2V-1.3B |

17.40 |

0.550 |

0.467 |

Wan2.1-T2V-14B |

19.76 |

0.629 |

0.405 |

World-R1-Small |

27.63 |

0.858 |

0.201 |

World-R1-Large |

27.67 |

0.865 |

0.162 |

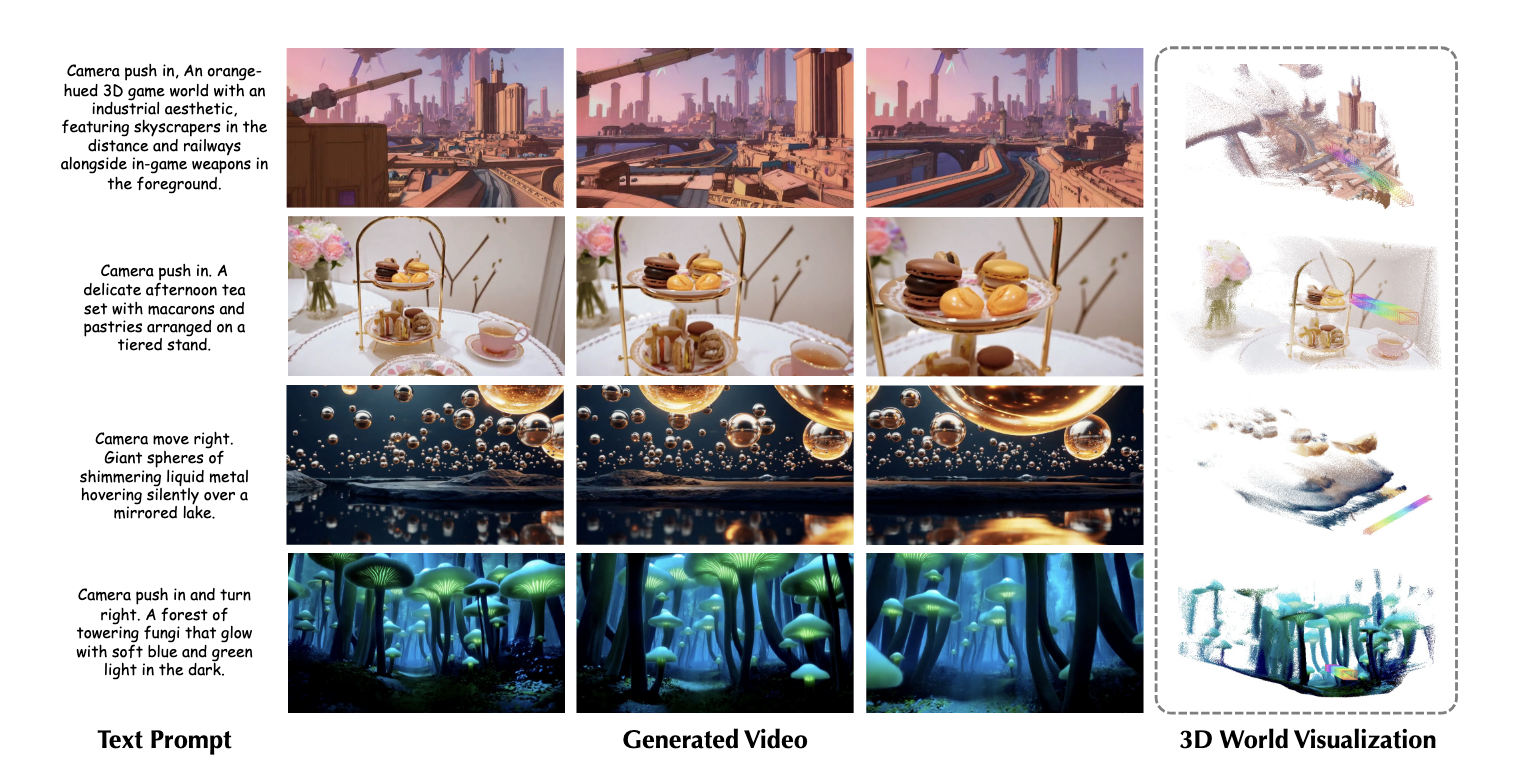

원본 대비 PSNR이 각각 +10.23dB, +7.91dB 향상됐습니다. 단순 수치 개선이 아니라, 육안으로도 건물이나 물체가 카메라 이동 중에 형태를 유지한다는 차이가 보입니다.

일반 영상 품질(VBench): World-R1-Small이 원본 Wan 2.1-1.3B보다 미적 품질, 이미지 품질, 피사체 일관성 모두에서 앞섰습니다. 3D 제약이 시각적 품질을 희생하지 않았다는 뜻입니다.

사용자 연구: 30개 복잡한 프롬프트에 대해 25명이 블라인드 평가. 기하학적 일관성 92%, 카메라 제어 정확도 76%, 전반적 선호도 **86%**로 World-R1이 선택됐습니다.

결론

몇 가지 짚어볼 지점이 있습니다. 훈련 데이터가 3,000개 텍스트 설명으로 비교적 소규모입니다. 훈련 자체는 H200 48~96대가 필요하니 일반적인 연구 환경에서 재현하기는 쉽지 않습니다. 주기적 분리 훈련으로 동적 장면을 보완하지만, 아주 복잡한 동적 요소들이 얼마나 잘 살아남는지는 아직 더 검증이 필요합니다.

3D 데이터셋을 모으거나 아키텍처를 뜯어고치는 대신, 이미 있는 모델에서 3D 지식을 강화학습으로 끌어낸다는 접근은 월드 모델 연구의 한 갈래를 보여줍니다. 자율주행 시뮬레이션이나 로보틱스처럼 물리적 일관성이 중요한 분야에서 텍스트-투-비디오 기반 월드 시뮬레이터가 실용적으로 쓰일 수 있는 가능성을 열어준다는 점에서 주목할 만합니다.